近年来,人工智能(AI)的快速发展引发了全球范围内的广泛关注。英国作为一个经济体,面对生产力增长乏力和经济增长缓慢的困境,部分政策制定者寄希望于人工智能成为激活经济活力的重要引擎。然而,现实情况远比理想复杂。人工智能技术在带来便利和效率提升的同时,也面临着重大的局限性和潜在风险。理解这些问题对于制定可持续的经济政策至关重要。 人工智能技术尤其是大型语言模型(LLM)如ChatGPT在过去几年内获得了公众的广泛热议。

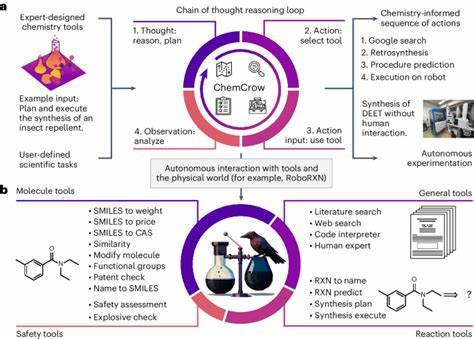

它们能够模拟人类的语言表达,为用户提供灵活多样的文本生成服务。从医疗诊断辅助到教育内容创作,从法律文件起草到企业数据分析,人工智能的应用场景令人眼花缭乱。英国经济中许多领域也开始尝试将这种技术引入工作流程,希望以减少成本、提高效率,并解决一些根深蒂固的生产力瓶颈。 然而,人工智能技术并非“银弹”。尤其是大型语言模型,其核心工作机制基于对海量数据的统计分析,预测最可能出现的词汇组合和语句结构,而非真正具备逻辑推理和事实判断的能力。这导致模型经常出现“幻觉”——即生成似是而非、但事实错误的内容。

在法律领域暴露出的多起案例,便为这一问题敲响了警钟。律师在依赖AI辅助起草诉讼材料时,曾发现模型错误生成了不存在的判例和法规文本,这种虚假信息的出现可能导致严重的法律风险和信誉损失。 不仅是法律领域,艺术创作、新闻报道乃至学术写作也面临类似问题。英国格拉斯哥大学的研究团队将这些现象直言不讳地形容为“胡扯”,表明这种模型并非在“理解”或“推理”,而仅是在模仿人类语言的表面特征。随着模型规模的扩大和应用的广泛,“幻觉”现象非但没有减少,反而变得更加普遍。这对依赖信息准确性极高的商业和公共服务领域提出了严峻挑战。

此外,最新的研究指出,在面对复杂问题时,即使是被称作“大型推理模型”的新型AI结构也会经历“准确性崩溃”,表现出难以保证信息可靠性的困境。这意味着在深度问题解决和决策支持领域,人类专业人员的作用依然不可替代。将人工智能作为辅助工具而非独立替代者,是当前及未来政策调整的关键方向。 这也让学界和业界的权威声音对人工智能对英国经济的实际贡献提出了审慎评估。诺贝尔经济学奖得主达龙·阿西莫格鲁曾明确指出,当前人工智能技术主要影响的岗位集中在数据总结、模式识别、视觉匹配等小范围领域,这部分工作约占经济体的5%。这表明人工智能短期内并不会引发大规模的自动化替代,特别是对于那些需要高度专业知识和判断力的岗位,AI更可能发挥补充和辅助作用。

基于这些现实,政策制定者应认识到,依赖人工智能强行提升英国整体经济生产力是一种缺乏依据的乐观期待。英国自全球金融危机后,生产力增长长期停滞,经济结构调整迟缓,若仅抱希望于AI的技术奇迹而忽视根本性改革,不仅无法实现经济复苏,反而可能因盲目投入带来资源浪费。 从社会成本角度看,人工智能的发展同样伴随着一系列负面因素。庞大的计算需求带来高昂的能源消耗,产生巨大的碳足迹,对环境造成压力。社交媒体和公共信息领域被虚假内容和衍生信息充斥,扰乱公众判断,破坏民主和社会信任机制。牛津互联网研究所的桑德拉·沃赫特曾形象比喻现状为“每个人都把空罐子扔进了森林”,让网络空间变得污染严重,令正常的信息交流环境难以维持。

因而,面向未来,英国政府在拥抱人工智能技术时,必须保持清醒和审慎的态度。支持创新固然重要,但更需科学评估技术能力和风险,明确界定人工智能可发挥作用的领域及其边界。公共服务领域的数字化转型可以借助AI辅助提升效率,但大规模替代人工方式、依赖自动化决策系统尚需时间和技术成熟度保障。 政府已经对数字化转型给予高度重视,这比仅仅聚焦AI更为务实。让公民能够便捷地通过多种通讯渠道与医生、公共机构互动,比依赖自动回复系统可提高服务质量和满意度。大力推动工人对AI工具的适应与使用,开发能够增强员工能力而非完全替代的技术方案,或许才是实现经济长期稳健增长的有效路径。

综上所述,人工智能作为改变世界的重要科技力量,具有不可忽视的潜力和价值,但其局限性和风险不容忽视。对于希望借助AI挽救英国经济衰退的政策制定者而言,唯有基于科学、理性与谨慎的态度,把人工智能视作辅助工具而非万能解药,注重技术与人力的协同发展,才能避免陷入盲目乐观的误区,助力经济实现可持续的复兴。未来的道路依赖于技术与政策的深度融合,也需要社会各界共同努力守护健康的信息生态和经济环境。