随着人工智能技术的迅猛发展,尤其是大型语言模型(LLM)的广泛应用,社会各界开始质疑这些工具是否会影响人类的智力水平。以ChatGPT为代表的智能写作助手和对话机器人正逐渐渗透到教育、办公和生活的方方面面。这些技术极大地提高了信息获取和内容生产的效率,但也引发了关于人类认知能力是否被削弱的忧虑。本篇文章将深入探讨当前科学研究揭示的相关现象,审视其背后的逻辑,并从认知科学和心理学视角剖析“AI是否让人变笨”这一问题的复杂性。近年来,不少媒体报道引用麻省理工学院(MIT)一项引起巨大关注的研究,该研究发现,使用ChatGPT的参与者在写作后,脑电图显示其神经连接大幅减少,尤其是在与记忆、创造力和深度思考相关的alpha和theta波段。此外,83%的用户无法准确回忆几分钟前自己写下的内容,而未使用AI的用户中仅有约10%出现类似状况。

教育工作者也指出,用AI辅助生成的作文缺乏生气,语言平淡无奇,用户常常直接复制粘贴AI输出而不加改动,导致写作热情和个人表达都受到抑制。实验还显示,当切断AI辅助后,这部分用户在无助于AI支撑的写作任务中表现出明显的认知疲劳,思维活跃度下降,表现不如未曾依赖AI的对照组。除了大脑活动的变化,参与者普遍感受到与自己作品的情感距离感增强,自我效能感降低,难以对AI辅助下的成果产生满足感和归属感。这样的心理体验,可能长期累积成所谓的“认知负债”,意味着对某些认知技能的依赖造成潜在的能力退化风险。然而,有观点认为用“让人变笨”直接概括这一现象过于简化,甚至是误读。研究者们强调,实验仅限于短时间内的写作任务,参与者数量有限,且该研究并没有衡量智力的整体表现,而主要聚焦于特定情境下的记忆回忆能力和脑电活动。

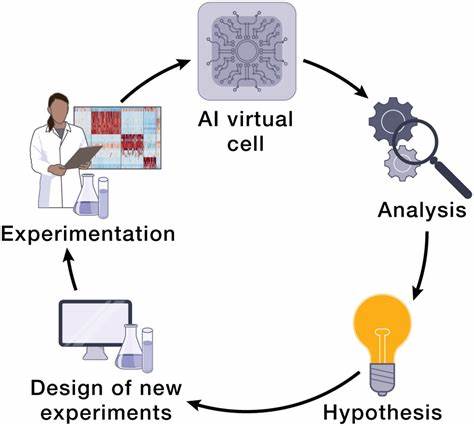

脑活动减少不一定是负面信号,它也可能代表某种认知效率的提升或者思维方式的转变。更重要的是,人工智能提供的辅助实际上是一种工具创新,就像计算器带来的数学计算变革,关键在于人们如何使用这种技术,是成为依赖还是合理利用。科学界也指出,切换使用AI和不使用AI的组别表现并未呈现一致下降,部分使用者在重新切换回无AI条件时表现稳定,提示影响因素可能更为复杂。部分研究还发现,AI辅助写作过程中的脑连接性变化还受到写作内容和个人熟练度的影响,不同使用方式带来的差异显著。与此同时,对AI工具的过度依赖可能带来学习机会的损失,例如减少了主动回忆、推理和语言表达的锻炼,这些都是认知能力形成的关键环节。社会心理学层面,降低主动思考动力可能导致创造力的暂时性削弱,但也有人认为人工智能能解放人类从繁重的信息检索和机械性写作中解放出来,将更多精力投向创新和批判性思维。

人工智能尤其是LLM,在教育场景中的应用争议尤为激烈。老师们担忧,学生借助AI完成作业将弱化学科基本功,使语言表达流于表面,影响深层思考训练。同时教育界也在积极探讨如何将AI纳入教学设计中,充分发挥它提供信息支持和辅助交流的优势,而非单纯禁止或排斥。如何避免“认知负债”或“智能惰化”现象,成为未来AI共存时代教育的重要课题。个人层面,提高数字素养和心理认知意识,培养主动批判和深度参与习惯,能够减缓甚至避免被技术工具过度依赖的风险。更多研究呼吁,应从长期、整体的认知功能角度出发,设计系统性、大样本、跨文化的实证研究,评估AI对人类智力、情商、学习习惯及社会行为的多维度影响,避免因短期观察或片面结果引导公众误解。

时代的发展没有回头路,人工智能技术将深度融入社会之中,关键是人类如何掌握主动权,将科技作为赋能工具,实现人与AI的协同进化。LLM带来的便利不可否认,但也为认知和学习模式带来了新的挑战。正视这些问题,理性利用技术,强化独立思考,是未来现代人类保持智慧活力的必经之路。未来也许能诞生出更加智慧的AI-人类混合智能系统,推动社会文明跨越式发展。总之,大型语言模型是否让人变得更笨,尚无定论。现有研究指出现实中的风险和潜在影响,但也提醒公众避免简单化标签或恐慌心态。

人类应聚焦如何在AI时代优化自身学习和认知策略,实现技术进步与智慧提升的双赢。