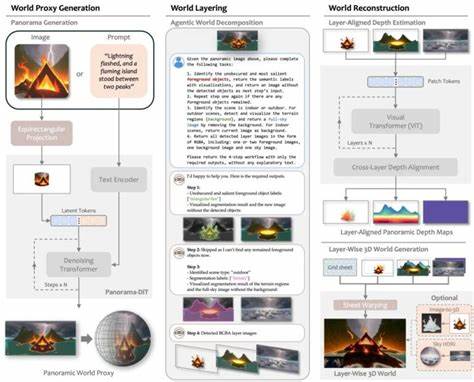

近年来,随着人工智能和计算机视觉技术的迅猛发展,三维场景生成与重建成为科研和工业界关注的热点。传统的三维建模过程往往耗时且依赖昂贵的设备及复杂的数据采集。面对这一瓶颈,腾讯创新推出的HunyuanWorld-Voyager框架,将通过视频扩散技术实现从单张图片到世界一致三维点云序列的转换,极大地简化三维模型生成流程。该开源项目不仅体现了腾讯在人工智能领域的技术实力,也为广大开发者和研究者提供了开放、高效的工具支持,推动三维数字世界的构建不断迈向新高度。HunyuanWorld-Voyager是一种基于视频扩散的新型生成框架,核心在于它能够在保证全局世界一致性的前提下,生成对齐的RGB和深度视频序列。这意味着用户只需提供一张静态图像,再配置自定义的摄像机运动轨迹,即可生成稳定且连贯的三维场景视频。

此功能突破了传统方法需要多视角图像或复杂手工校准的限制,实现了更加灵活且易用的三维探索体验。在架构设计上,Voyager包含世界一致的视频扩散模块和长程世界探索机制。视频扩散部分通过统一的深度学习模型,生成包含RGB与深度信息的对齐视频数据,确保每一帧画面相互关联、内容连贯,提升三维场景的真实感和流畅度。长程世界探索则引入了高效的世界缓存策略,结合点云筛选与自动回归推理技术,支持迭代地延展场景范围,同时保持上下文感知的一致性。这种设计有效避免了传统全场景生成的计算瓶颈,适应更大规模、复杂度更高的三维世界建模需求。为了训练这一复杂模型,腾讯团队开发了可扩展的视频重建数据引擎。

该引擎自动执行摄像机位姿估计及度量深度预测,支持各种视频素材的无人工注解大规模训练数据构建。结合真实拍摄的视频和由Unreal Engine渲染的合成数据,累计制作了超过十万段视频剪辑。这不仅提升了模型泛化能力,也保证了对多样化场景的良好适配。腾讯发布的HunyuanWorld-Voyager在官方的WorldScore基准测试中表现优异,综合评分远超其他竞品,在摄像机控制、物体操控、内容对齐、三维一致性、光度保持以及风格一致性领域均获得第一或第二名。该系统还拥有较高的主观视觉质量,显示出其应用于真实场景生成的潜力。此外,HunyuanWorld-Voyager对于硬件环境有一定要求,至少需配置具有CUDA支持的NVIDIA GPU,推荐使用80GB显存以保证视频生成质量。

其模型在一块80GB GPU上完成了测试,并针对64GB显存的最低门槛做了优化建议。这为专业科研机构或高端业界应用提供了硬核保障。为了方便开发者体验和二次开发,腾讯公开了详细的安装指南及依赖说明。利用conda环境管理和支持CUDA 11.8以上版本,搭建步骤清晰,便于快速上手。配合开源的预训练模型权重,用户可以轻松生成包含多视角深度信息的RGB-D视频,并导出点云数据用于后续三维重建。此外,腾讯还开发了多GPU并行推理方案 - - xDiT,用于提升推理效率,适合处理大规模运算任务,满足工业级实时应用需求。

团队同样提供了基于Gradio框架的交互式Demo,用户通过网页界面上传图片,选择摄像机移动路径,即可实时体验三维场景生成过程,降低尝试门槛,这对于推广三维视觉应用和普及技术知识具备积极作用。HunyuanWorld-Voyager也展现出多样化的应用潜力。其不仅可用于三维世界探索和虚拟现实场景构建,还支持视频重建、深度预测等功能,在游戏开发、电影特效制作、文物数字化保存等领域均有广泛前景。特别是在需要快速生成交互式三维内容的场合,Voyager技术能够节省人力成本,提升内容创作效率。此次开源不仅是腾讯技术创新的体现,也是推动整个AI三维生态健康发展的重要举措。通过开放源代码和预训练模型,腾讯积极构建共享协作平台,吸引来自全球优秀开发者和研究学者的参与。

社区成员可以针对模型结构、训练数据、推理算法等多方面持续优化,促进前沿技术更快转化为实际生产力。未来,伴随软件硬件的持续升级,以及融合大模型与投影技术的可能性,HunyuanWorld-Voyager有望推动三维数字世界进化至更高智能水平。总而言之,腾讯HunyuanWorld-Voyager的问世意味着三维世界构建技术进入了一个新纪元。凭借其创新的视频扩散架构、自动化数据引擎和优异的性能表现,该平台极大地拓宽了三维场景生成的边界,降低了技术门槛,为数字内容创作和虚拟现实体验注入强大动力。对想要探索多维度数字世界的科技爱好者、商业开发者以及科研机构而言,HunyuanWorld-Voyager无疑是最具潜力和实用价值的选择。随着技术的不断迭代,相信它将在未来带来更多惊喜,驱动3D视觉产业迎来更多创新的可能。

。