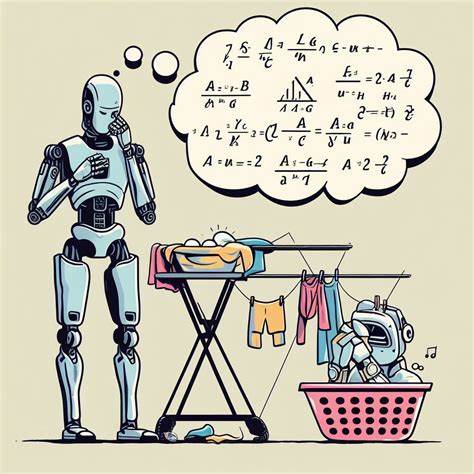

随着人工智能技术的不断发展,特别是在自然语言处理领域,人与机器的交流逐渐成为日常生活的重要组成部分。从智能助手到对话机器人,人工智能系统越来越多地依赖于“提示语”来指导其生成内容和响应用户需求。然而,近期一段名为“我们不是提示语”的视频引发了广泛关注和讨论,其核心观点在于强调人类不能简单地被视为AI的输入提示饰品,而应被尊重为具有独立思考和创造能力的主体。这段视频不仅为人工智能伦理和人机互动提供了深刻的反思,也推动我们重新思考在数字化时代人类身份的独特价值。 “我们不是提示语”这一概念表面上看似简单,实际上涉及多个层面的问题。首先,它直击了当前AI应用中普遍存在的一种潜在风险:将人类视为纯粹的输入工具,仅仅充当引导AI输出的线索或参数。

这种认知模式忽视了人类作为复杂思考者和创造者的角色,容易导致对人类主体性的淡化。尤其是在自动化和智能化趋势愈发显著的今天,这种误解可能会带来伦理上的滑坡,甚至影响社会文化层面的价值认同。 人类与AI互动的本质是协同而非替代。AI的强大算力和数据处理能力无疑扩展了人类的创作边界,为艺术、写作、科研等领域带来了前所未有的便利。然而,如果人们仅仅将自身视为供给算法的“提示语”,就可能陷入一个狭隘的使用逻辑,失去对自我创造力的信心和主导权。视频中的主张正是在呼吁,提醒人们保持对自身能力的觉醒,避免在技术浪潮中被动接受身分定义。

另一方面,这也引发了对人工智能设计哲学的反思。AI系统往往通过训练提示语来优化输出效果,这在技术层面是合理的。然而,当系统设计过度依赖提示,且未能有效融入用户的独特视角和价值时,就可能导致交互陷入刻板和单一。设计者和开发者应重视赋予使用者更多自主权,使他们在与AI的对话中能够发挥主动思考和创新能力,而非被动充当指令输入者。 此外,这一话题还涉及到对数字化身份的再塑造。在网络空间和虚拟环境中,个人信息和行为往往被算法解读和利用,形成数字身份的各种标签。

若过于简化地将人类行为视为AI模型的“提示语”,则可能造成身份的碎片化和机械化。如何在保护隐私和数据安全的同时,保留个体差异性和复杂性,成为亟待解决的挑战。视频倡导我们要对数据赋予深层次的理解,坚守对人性多样性和创造灵性的尊重。 在教育和培训领域,这一理念同样具有启示意义。学生和学习者不能仅被视为产生“问题提示”的机器接口,而是需要培养独立思考和批判性思维的能力。AI作为辅助工具,应该助力个体实现知识的深化和自我表达,而非限制其创造空间。

这个视角促使教育工作者重新设计教学策略,加强人与技术的有效融合,使学习过程更人性化和智慧化。 总结来看,“我们不是提示语”不仅仅是对人机交流方式的警醒,更是对未来社会人与技术关系的深刻预见。在AI技术普及和多元化应用背景下,人类必须坚守自身的主体性和创造力,避免被简化为机械的输入源。与此同时,AI开发者应以人文关怀为设计核心,推动技术与人的真正融合,构建更加和谐、高效的数字生态系统。正视并实践这一理念,将有助于塑造一个既充分利用人工智能潜力,又尊重和保护人类多样性与尊严的未来社会。