人工智能的快速进步已经深刻影响了我们生活的方方面面,尤其在文本生成领域表现得尤为显著。随着语言模型如GPT系列的广泛应用,AI生成的文本质量不断提升,以至于普通人难以分辨出一篇文章究竟是人类还是机器写的。这一现象不仅带来了技术层面的挑战,也引发了伦理、安全及版权保护等多方面的讨论。怎样才能可靠地判断一段文本是否由AI创作,是当前备受关注的问题。首先,我们需要明白何为"AI写作"。AI写作通常指使用自然语言处理(NLP)技术,由机器自动生成文章、故事、新闻稿、评论等文本内容。

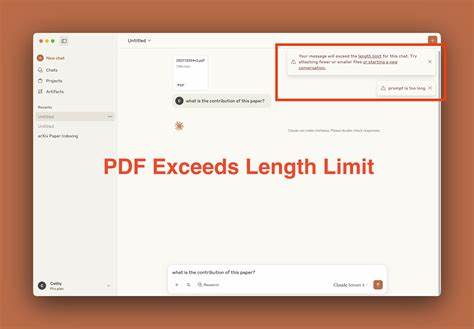

早期AI生成的文本具备语法错误多、表达重复率高、缺少逻辑连贯性等明显缺陷,因此容易被人类识别。而如今的AI文本不仅流畅,语义丰富,且风格多样,鉴别难度随之增加。当前鉴别AI文本的核心难题之一在于AI技术的"拟人化"趋势。现代语言模型经过大规模数据训练,能模仿多种写作风格,并适应不同语境,因此单靠直觉或传统语法检测工具难以辨别其真伪。再者,AI文本生成不依赖固定模板,随机性极高,避免了大量机械式重复,让侦测变得更加复杂。技术层面的解决方案主要包括利用AI识别AI文本和多模态验证手段。

AI检测工具通常基于统计学和机器学习算法,通过分析文章的语言模式、词汇分布、句式结构,以及潜在的"指纹",来判断是否为机器生成。譬如,OpenAI曾推出专门的AI文本识别器,通过比对概率分布寻找生成标记。然而,检测器本身也面临"猫鼠游戏"的困境,随着生成技术进步,检测准确率受到挑战。在应用层面,结合作者身份验证和非文本信息,是判断文本来源的有效路径。比如学术界为防范论文代写,往往辅以现场答辩、小组讨论等形式,要求展示真实创作过程,以降低AI代写风险。此外,利用抄袭检测、写作风格分析工具,比较同一作者过往文本,也可以发现风格突变的异常点,提供间接鉴别依据。

社会层面的人文因素也不能忽视。人工智能生成的内容虽在写作技巧和语义表达上日益接近人类,但依然存在缺乏原创思考、深层情感或独特人生经验的局限。评估文本背后的认知逻辑和价值体系是否契合作者个人经历,也是判断参考方向。面对"AI写作难判"的现实,我们可以采取多层次、多维度的综合策略,包括技术检测、身份校验、内容审查与人机互动等,提升判断可靠性。例如,在内容发布平台,结合机器检测和编辑审核,提升筛查能力;在学术和法律领域,倡导公正透明,明确AI辅助写作的界限和规范。未来,随着AI技术和检测手段的不断进化,这一领域将持续发展。

值得期待的是人工智能本身也能更有效地防伪溯源,甚至实现AI生成内容的加密标识和溯源认证,从根本上解决问题。总之,尽管目前尚无万无一失的判别方法,但通过多方共同努力,结合技术创新与制度建设,我们仍有望在保护知识产权、维护内容真实性和促进创新发展之间找到平衡。了解并意识到人工智能写作的优势与风险,掌握科学判断技巧,是每个内容创作者和使用者必须重视的议题。持续关注这一领域进展,不仅能提升自身信息鉴别能力,也有助于构建健康、诚信的信息生态系统。 。