随着人工智能和深度学习技术的不断进步,光学字符识别(OCR)技术迎来了质的飞跃。近年来,开源OCR模型的崛起为开发者和企业提供了更多灵活高效的解决方案。其中,基于3B参数规模的开源模型凭借先进的架构设计和强大的多模态能力,不仅实现了文本的高准确率识别,更在复杂文档处理、多类型内容智能提取方面展现出极大优势,甚至全面超越了曾经广受欢迎的Mistral OCR模型。 开源3B参数模型的核心优势在于其深度融合了图像和文本的多模态理解能力。传统OCR多聚焦于纯文本的简单提取,而该模型的设计理念则是结合视觉信息和语义理解,从而能够更加准确地识别文档中的各种元素。这包括复杂的数学公式自动转换为标准LaTeX格式,精准识别并结构化输出表格数据,甚至连文档中的水印和签名等特殊元素也能准确检测与标注。

多语言与多格式的支持是这款模型被广泛推崇的另一大因素。它不仅支持英文文档的高精度识别,还可以对其他语言文本做出有效理解和提取。此外,对PDF、图片、扫描文档等多种输入格式的兼容,使得用户能够在不同场景下灵活运用这一技术,无需担心格式限制。 在实际应用中,该模型不仅仅满足简单的文字识别需求,更以智能内容识别为特色。比如,自动为图表、图像生成描述标签,使得后续的自然语言处理或语义搜索更加精准便捷。对于法律和财务文档中经常出现的签名识别及隔离处理,则提供了专业级的解决方案,极大提升了文档管理和审核效率。

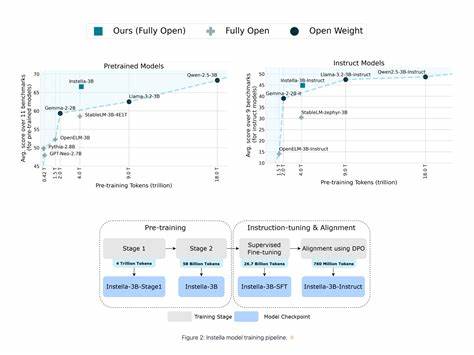

此外,智能表格提取功能的引入,也极大改善了传统OCR在处理表格时的局限。该模型能够将复杂的表格准确转换为Markdown或HTML格式,使得数据后续分析与编辑变得简单高效。结合智能复选框识别,提升了对问卷、表单等文档数字化处理的水平,赋能更多行业自动化场景。 在技术实现层面,模型基于Qwen2.5-VL-3B的强大底层架构,采用bf16张量类型,兼顾性能与算力效率。同时支持flash_attention_2等先进的注意力机制优化,确保推理速度与精度的平衡。用户可以通过Hugging Face平台便捷地下载和部署,支持多种主流框架和硬件环境,极大降低了研发门槛。

对比市场上流行的Mistral OCR,开源3B模型的参数规模虽在3亿左右,但其训练方法和多模态融合策略更为先进,使得识别结果更加精准且鲁棒性更强。在复杂文档处理任务中,Mistral OCR往往难以兼顾内容的结构化与语义理解,而新模型在这方面表现优异,成为实际应用中更受欢迎的选择。 此外,开源模式为用户带来了极大的自定义和扩展可能性。研发者不仅可以基于原模型进行微调和适配,还能将其融入更为复杂的AI流程中,如结合大语言模型进一步增强文本理解和生成能力。Nanonets团队的持续更新和开源生态构建,促进了技术社区的快速迭代和创新发展。 未来,随着跨模态技术的不断演进,基于大规模参数的开源OCR模型将继续突破传统边界,向更智能、更精准、更适应多样化应用场景迈进。

无论是金融报表的自动化处理,还是学术论文中复杂公式的智能识别,亦或是法律文书的签章安全保障,这些先进OCR技术都将为数字化转型注入强大动力。 总体而言,开源3B参数模型以其领先的技术优势和丰富的功能集,已经成为OCR领域的新标杆。它不仅完善了文本提取的准确度和多样性,还通过智能内容识别和结构化输出,极大提升了文档理解的深度和广度。企业和开发者借助这一工具,能够更高效地实现文档智能化管理,推动业务数字化升级进入崭新阶段。随着社区不断壮大与技术持续优化,未来这一模型有望继续刷新OCR技术的行业标准,引领智能文档识别的革新浪潮。