随着区块链技术的不断进步,去中心化金融(DeFi)已经成为金融创新的主力军。DeFi通过智能合约实现了无需中介的金融服务,大幅提升了金融系统的开放性和透明度。而人工智能(AI)技术的迅猛发展为DeFi注入了新的活力,催生了所谓的"DeFAI"生态,即结合AI能力的去中心化金融体系。DeFAI利用人工智能在数据处理、风险管理和自动化决策方面的优势,极大地提高了交易效率和系统智能化水平。然而,去中心化和智能化的深度结合也带来了全新的安全风险,透明安全成为该领域追求的核心目标。 传统的DeFi智能合约多采用明确且可验证的规则执行逻辑,例如"当事件A发生,则执行操作B",这类合约的代码通常公开透明,可以被社区和安全专家全面审计校验。

因此,DeFi体系中的资产和操作具有较高的可追溯性和安全性。然而,当AI技术引入DeFi体系时,情况便更为复杂。AI驱动的智能代理或称AI智能合约,通常基于机器学习模型和大量数据训练形成,其决策过程具有一定的概率性和自适应性。这种特性虽为DeFi带来了更灵活和高效的服务,但也不可避免地增加了系统的不确定性和潜在漏洞。 DeFAI中AI代理能够实时处理不断变化的市场信号,从而在交易中快速做出反应。例如,AI交易机器人能够自动识别跨交易所的套利机会,并快速执行交易以获取利润。

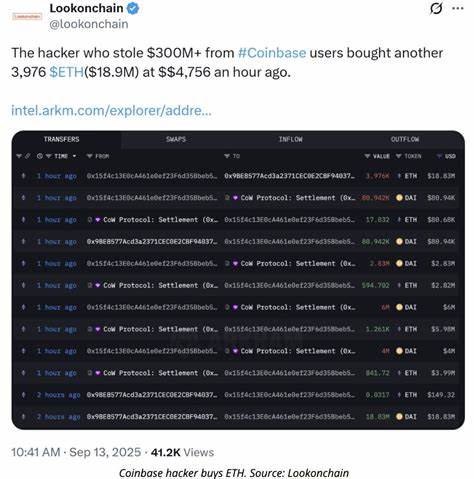

然而,这些代理大多运行在集中式的Web2基础设施中,依赖外部数据输入,存在单点故障和数据被篡改的风险。攻击者可能通过对训练数据进行投毒(data poisoning)或利用对抗性攻击,误导AI代理作出错误决策,从而造成资金损失或系统瘫痪。由于目前多数AI模型的内核如"黑盒"一般,开发者和用户对其决策依据难以完全理解和检验,这与区块链原本倡导的公开透明精神存在根本冲突。 在安全领域,DeFAI的出现促使传统的智能合约安全策略面临巨大挑战。单纯对代码逻辑的审计已经无法满足AI智能合约的复杂性和动态决策机制的需求。DeFAI系统需要采用更为先进和多维度的审查手段,包括对AI模型训练过程与数据源的严格监控、对AI决策链条的追踪溯源以及针对可能的攻击路径进行系统化的模拟演练。

此外,引入跨学科的加密技术,如零知识证明,可以在不泄露敏感逻辑的前提下验证AI决策的正确性,从而提升系统的整体透明度和信任度。 社区和行业层面的合作同样关键。DeFAI安全依赖于开发者、用户到第三方安全审计机构的共同努力。规范化的安全标准和透明度要求应成为未来行业发展的基石。推动AI模型开源或发布详尽的技术文档,能够帮助用户理解AI智能合约的运作原理,降低误用风险。与此同时,设立专门的安全检测平台,对AI驱动的DeFi协议进行持续的风险评估和威胁预警,也是保证体系稳定运行的重要措施。

值得注意的是,DeFAI不仅关乎技术安全,更触及去中心化信任机制的根本。AI代理将逐步具备代表用户持有资产、与智能合约交互、参与治理投票的能力,这意味着治理的信任模式需要超越代码验证,逐步向意图验证转型。如何确保AI代理的行动目标与用户的长远利益相符,成为未来研究和实践的重点。用户可通过设定明确的操作边界和目标约束,加强对代理行为的监督和校正,保障资产安全与治理公正。 总的来看,DeFi与AI的融合为金融领域带来了深刻变革的同时,也将传统安全理念推到了新的风口浪尖。透明安全不仅是DeFAI可持续发展的基石,更是行业赢得用户信赖、推动技术创新的关键保障。

严格的代码和模型审计、多方协作的安全生态构建、创新的加密与验证技术应用,以及基于意图的信任机制设计,共同塑造更加安全、透明、智能的去中心化金融未来。随着DeFAI的快速发展,整个行业必须时刻警醒安全风险,加快构建适应新技术特点的安全标准和实践,确保创新成果能够转化为真实可依赖的价值。最终,只有实现透明、安全和智能的有效融合,去中心化金融与人工智能的结合才能真正造福广大用户,推动区块链生态持续健康成长。 。