生成式建模作为人工智能领域的重要分支,近年来因其在图像合成、文本生成、音频创作等多媒体内容生产中的卓越表现,受到了广泛关注。其中,扩散模型与流匹配模型的出现极大推动了生成技术的进步,尤其在图像质量及生成多样性方面表现优异。然而,当前这些模型在设计空间上的局限,也一定程度上制约了性能和灵活性的进一步提升。与此同时,自回归模型,尤其是连续令牌生成技术,正崭露头角,展现出整合文本与多媒体生成的新潜能。在这一背景下,Transition Matching(简称TM)被提出,作为一种全新的离散时间连续状态生成范式,旨在融合并超越现有技术,实现可扩展且灵活的生成式建模。Transition Matching的核心思想是将复杂的生成任务拆解为多步骤的马尔可夫转移过程,通过学习非确定性的概率转移核,实现对生成流程的精细控制和高效优化。

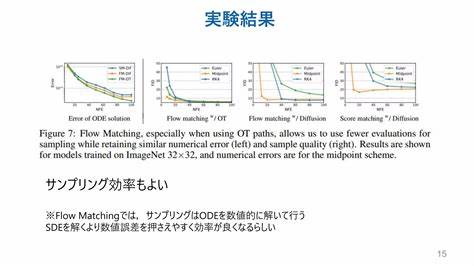

TM不仅支持表达力强的概率转移机制,还允许采用非连续性的监督策略,极大拓展了模型设计的自由度和适用场景。Transition Matching展示了极强的灵活性和扩展性,让生成模型能够更好地适应不同数据结构和任务需求。在TM的多个变体中,差分转移匹配(Difference Transition Matching,DTM)将流匹配方法推广到离散时间领域,通过直接学习转移概率分布,获得了领先的图像生成质量和文本匹配度,同时提升了采样效率。DTM的出现标志着流匹配模型在实际应用中的性能达到了一个新高峰。另一重要变体是自回归转移匹配(Autoregressive Transition Matching,ARTM),它部分采用因果结构,实现了连续的因果自回归生成,且性能媲美非因果方法。ARTM为将强大的自回归技术与深度学习生成模型结合提供了理论与实践基础,为文本生成和多模态融合开辟了新的可能性。

全历史转移匹配(Full History Transition Matching,FHTM)进一步将因果性提升到完全因果的水平,成为首个在连续域中匹配甚至超越流匹配性能的全因果模型。FHTM的突破赋予了生成模型更强的历史信息利用能力,使得文本到图像等复杂的多模态生成任务表现出前所未有的质量和一致性。此外,Transition Matching在训练和推理阶段均表现出强大的鲁棒性与效率优势。其设计允许统一固定架构、训练数据与超参数标准,便于进行大规模对比和性能评估。这种一致性保证为模型进一步迭代和实际部署提供了坚实支持。在技术实现层面,Transition Matching利用概率论和马尔可夫链理论,结合深度神经网络强大的表示能力,实现了对生成过程的精准建模。

通过定制化的转移核与迭代更新策略,模型能够高效捕捉数据内在结构和变化规律,推动生成样本向更真实、更一致的方向演进。Transition Matching的出现,不仅丰富了生成式模型的理论框架,也为多模态生成应用带来了实质性飞跃。在文本生成领域,TM变体可与现有自回归文本生成方法无缝集成,提升模型生成连贯性和上下文理解能力。在图像生成与编辑任务中,TM通过灵活设计转移策略,实现细粒度内容控制与多样性保障,满足个性化和高质量生成需求。此外,TM的可扩展架构使其适合处理大规模数据和复杂任务,有望广泛应用于智能创作、自动内容生成、虚拟现实等多个前沿领域。尽管Transition Matching技术潜力巨大,其研发和应用仍面临挑战。

例如,设计高效且表达力丰富的转移核需要较高的理论和工程投入,如何在保证模型复杂度可控的同时提升性能,是持续探索的重点。同时,多模态融合与跨领域推广也需更多创新性的结构与算法支持。据悉,相关研究团队已开展大规模的对比实验,并公开发布代码和训练资源,助力社区进一步验证TM模型的有效性和通用性。未来,随着计算能力和算法水平的提升,Transition Matching有望成为生成式模型领域的重要标准之一,推动人工智能在内容创作和智能交互等方面实现质的飞跃。总的来看,Transition Matching突破了传统生成模型设计的局限,实现了连续状态与离散时间相融合的统一框架,以其卓越的灵活性和可扩展性,引领了生成式建模的新方向。通过DTM、ARTM与FHTM等多种形式,TM不仅提升了生成质量和速度,也为复杂多模态任务提供了创新方案。

随着相关研究的深入推进,Transition Matching必将在人工智能内容生成领域发挥越来越重要的作用,助力人类探索创作的无限可能。