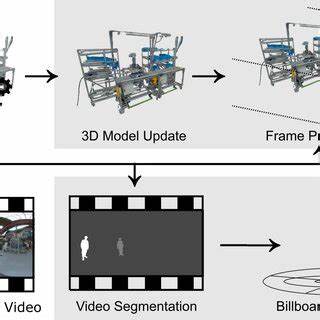

动态三维场景的重建技术近年来取得了显著进展,广泛应用于虚拟现实、增强现实、影视特效及自动驾驶等多个领域。然而,面对复杂且大幅度运动的动态场景,传统三维重建方法往往面临着建模难度大、计算复杂度高和渲染效率低等挑战。FreeTimeGS作为一种创新性的动态场景重建技术,提出了“自由高斯基元”这一全新的4D表示方式,以更灵活和高效的方式捕捉动态场景的变化。传统的动态三维场景重建方法通常依赖于将三维高斯基元定义于一个固定的规范空间(canonical space),并通过变形场(deformation field)映射到观察空间。这种方式虽然实现了动态视图合成的实时性,但其核心缺陷在于对变形场的优化和表示能力有限,难以应对真实场景中复杂的非线性运动与大范围变形。FreeTimeGS创新性地跳出了规范空间的约束,提出了“自由”高斯基元的概念,即高斯基元可在任意时间点和任意空间位置自由出现,使其能够动态适应场景的运动特征。

每个高斯基元不仅拥有传统的几何和颜色属性,还被赋予了运动函数,这使得它能够描述自身随时间变化的运动轨迹和速度,实现了运动的连续且细粒度建模。这种运动函数的引入不仅丰富了高斯基元对动态变化的表达能力,还有效减少了不同时间点之间的信息冗余,通过时间不连续的基元渲染提升了动画的流畅度与真实感。此外,FreeTimeGS为每个高斯基元设计了时间不透明度函数,用以调节其在不同时间段的影响力。这一机制使得高斯基元能在合适的时间窗口内发挥作用,增强了对复杂场景中多样时间动态变化的刻画能力。为保障重建的鲁棒性和准确性,FreeTimeGS还特别设计了4D正则化损失来约束高斯基元在时空上的分布,配合渲染损失优化整体表现。这使得模型在训练过程中更好地平衡拟合细节和避免过拟合,从而提升了动态场景的渲染质量和细节还原度。

实验结果表明,FreeTimeGS在多个公开数据集上均显著领先于现有的4DGS、STGS及Deform-3DGS等方法,尤其在处理复杂背景和大幅度运动时表现出极高的渲染保真度和实时性能。其渲染效果不仅画面细腻,动态运动逼真且无明显伪影,极大地推动了动态场景实时渲染技术的发展。该技术对于虚拟现实和增强现实领域具有重要意义。借助FreeTimeGS,用户可以在VR/AR设备如Apple Vision Pro和Meta Quest 3上,实现对高度动态环境的沉浸式观察,提升沉浸感和交互响应速度,为娱乐、培训和仿真等应用场景带来全新体验。在自动驾驶和智能交通系统中,动态三维场景的实时重建至关重要。FreeTimeGS因其高效且准确的动态建模能力,能够为自动驾驶系统提供高质量的环境感知数据支持,从而增强车辆对周围复杂动态环境的理解,提高行驶安全性。

研究团队还在Waymo数据集等大型真实街景数据上验证了这套方法,证明其具备较强的实用性和推广潜力。FreeTimeGS的创新意义不仅在于技术层面,更在于其提供了一种全新的思路:无需依赖固定的规范空间寄存和复杂变形场优化,而是通过时间和空间自由组合的高斯基元,构建出灵活、高效且适应性强的动态三维表示。这一思想未来有望进一步推广和延展,结合深度学习、图形渲染等技术,为自动内容生成、虚拟内容编辑和智能感知等领域创造更多机遇。随着3D传感技术和多视角视频采集设备的普及,数据量和复杂度急剧攀升,对动态场景重建算法的效率和精度提出了更高要求。FreeTimeGS以其实时渲染能力和较低的计算资源消耗,展现了优秀的扩展潜力,可以更好地应对未来复杂场景的挑战。总之,FreeTimeGS代表了动态三维场景重建技术的新高度,通过自由高斯基元的创新设计,显著提升了动态场景重建的灵活性和渲染质量。

它不仅拓展了学术研究的新方向,也为产业界在虚拟现实、自动驾驶和智能监控等方面提供了强有力的技术支持。随着相关技术的不断完善和推广,有望在更多实际应用中释放巨大价值,推动三维视觉技术迈向新的纪元。更多关于FreeTimeGS的详细信息、源码及演示,可访问其项目主页,体验前沿动态三维重建技术的魅力。