在人类社会的诸多领域,尤其是核能、航空和医疗等安全关键行业,人为错误始终是风险管理中的核心难题。任何一丝看似微不足道的错误都可能引发连锁效应,导致灾难性后果。尽管过去数十年间,学界与业界在减缓人为失误方面取得了丰富的研究成果,然而高质量数据稀缺、算法不透明以及对专家判断的依赖仍然制约着实践的进一步突破。针对这一复杂现状,结合人类可靠性评估、人工智能和认知科学的跨学科融合,正成为深化风险知情决策、进而降低人为错误风险的有效途径。首先,必须明确错误的多种形态及其在复杂社会技术系统中的具体表现。人为错误不仅限于操作失误,还涵盖信息认知偏差、决策失误及沟通不畅等多个方面。

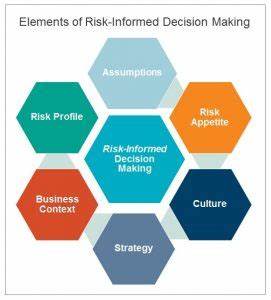

数量化分析显示,这些错误对系统整体可靠性有着显著影响,直接决定了灾难发生的概率与严重程度。风险知情决策框架强调在制定方案时充分整合风险信息和不确定性因素,将人类可靠性评估(HRA)有效嵌入其中尤为关键。通过结合概率模型与数据驱动方法,HRA能够更精准地预测潜在人为失误的可能性和后果。尽管当前已有若干成功案例显示这种方法的有效性,但诸多挑战依然存在,比如数据采集的完整性与真实环境的模拟准确性尚不足,这些都限制了整体预测的可靠度。认知科学和人类绩效模型为错误预测提供了重要补充。通过研究人的感知过程、记忆机制和决策行为,科学家能够解释为何在复杂任务中常发生某类错误,并探索相应的防范策略。

这种介入不仅提升了HRA模型的解释力,还促进了多层次的错误检测手段发展。近年来,人工智能技术的加入为实时错误识别和操作者状态评估带来了革命性变革。基于机器学习的算法能够从大量操作数据中自动挖掘异常模式,实现对潜在错误的早期预警。此外,AI辅助的HRA工作流程正在逐步构建,为风险知情决策提供动态、高效且更具透明度的支持。尽管融合认知模型与AI分析有效提升了预测精度,但其应用还需依赖更丰富的数据集、算法透明度保障及严格的验证程序。未来的研究应致力于跨领域数据共享与合作,以弥补个别行业数据不足的问题,推动形成统一标准和开放平台。

同时,将韧性工程理念与实证理论结合,深入挖掘事故的深层因果关系,有助于从根本上提升系统的整体可靠性。综上所述,人为错误作为风险知情决策中的关键挑战,通过引入多学科视角和先进技术手段,正迎来前所未有的变革机遇。加强数据质量、优化算法设计和深化理论结合,将成为保障生命财产安全不可或缺的重要保障。只有持续推动跨界创新与协同合作,才能在安全关键领域实现真正意义上的人类可靠性提升和风险有效管控。