近年来,随着大型语言模型(LLM)的飞速发展,关于检索增强生成技术(Retrieval-Augmented Generation,简称RAG)是否已经“过时”或者“死了”的争论频繁出现。然而,持此观点的人往往对RAG的发展和潜力存在误解。根据2025年7月Hamel Husain与Ben Clavié联合发布的关于RAG未来的深度系列研究,现实远非如此。RAG不仅没有消亡,反而展现出前所未有的活力与多样化发展路径,尤其是在更精准的检索机制和更智能的生成模型结合方面。传统RAG的局限性及其被误解的根源,主要源于过去流行的单一向量表示方法。2023年流行的RAG营销版本,着重将整篇文档转化为一个向量,再通过余弦相似度进行快速匹配。

短期内这看似便捷,但其实会丢失大量语义和结构信息。将复杂的文本浓缩成单一向量无异于粗暴压缩,因而无法捕捉细节和文档内各种层次的知识关联。随着海量信息需求的增加,单向向量方法显得力不从心。大型语言模型本身在训练完毕后便不再更新知识,因此依赖检索模块补充实时、详实的信息显得尤为重要。大型上下文窗口的兴起让人误以为单次查询加载海量信息是解决问题的钥匙,但事实上,单纯增加上下文长度反而引入“上下文腐蚀”(Context Rot)问题,即随着输入信息量过载,模型表现反而下降,大量干扰信息稀释了相关信号。由此可见,RAG的未来离不开更智慧、精准的检索,而非简单的上下文拼接。

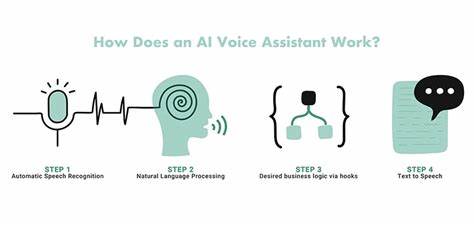

衡量RAG系统表现的指标长期局限于传统信息检索(IR)评估标准,如定位第一个最佳匹配结果。这种单点准确度的评价方法在RAG场景中显得不适用。RAG更需要关注覆盖率、事实多样性和相关性。毕竟,推动生成模型输出真实性和多元视角,是RAG的根本使命。Nandan Thakur等学者提出的“FreshStack”评价体系,专门针对RAG需求设计,打破了传统评价思维的桎梏。现代检索模块正逐渐具备理解指令和推理能力,超越传统基于关键字的检索。

Orion Weller的Rank1系统,是优秀示范之一。它不仅能理解复杂的查询要求,还能生成显式的推理轨迹,提升结果的可解释性和准确率。这意味着未来检索不仅是找到“最匹配”文档,更是找到“最具逻辑关联”和“最有价值”的信息源。传统单向压缩表达的主要弊端在于信息丢失和表达混淆。Antoine Chaffin的研究表明,采用后期交互(Late Interaction)模型,如ColBERT,能够在保持高效检索的同时,完整保存每个词的细粒度信息。这种技术极大提升了检索质量,使体量小得多的模型能超越7亿参数规模模型的推理能力。

这清晰指出,单向大模型并非检索的唯一出路,更重要的是设计合理的信息表示和交互方式。RAG的发展不应只依赖一种嵌入表达。Bryan Bischof和Ayush Chaurasia通过艺术搜索示例,证明多样化专用索引能有效应对不同类型的查询需求。无论是从字面描述、诗意解读还是相似图像的角度,多张“地图”结合传递出更全面的检索信息。未来RAG系统将更加智能化地根据查询类型动态路由至最合适的索引模块。“上下文腐蚀”是另一大挑战。

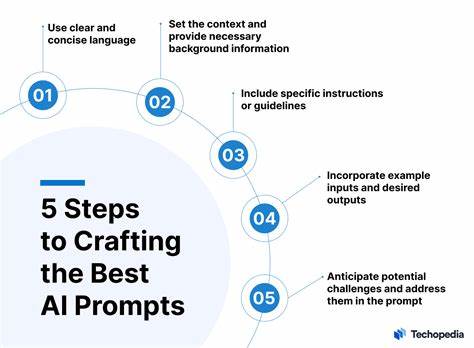

加长上下文反而导致模型信噪比急剧下降,对简单任务的表现尤为明显。Kelly Hong及其团队的研究强调,通过精心设计的上下文工程,合理切分和筛选信息,才能真正提升模型效果。直接填塞所有相关文档入单次输入反而适得其反,这提醒研发者勿再盲目追求更大上下文窗口,而应优化信息的调用与组合方法。综上所述,RAG的未来路径浮现出清晰的五个关键方向。首先,评价方式须紧扣实际使用场景,注重事实覆盖与多样性,而非简单检索精准率。其次,结合推理能力的智能检索模型能更准确地理解复杂查询需求。

第三,采用后期交互和细粒度信息保留技术,避免关键信息压缩丢失。第四,构建多样表示与多个专有索引,通过智能路由使检索结果更贴合上下文。最后,针对输入上下文长度进行科学管理,防范上下文腐蚀带来的性能退化。这些思路的融合必将推动RAG走向更强大的应用领域,从学术研究到实际商业场景均受益。随着大量知识图谱、动态数据源和多模态检索技术的加入,RAG不再是过去简单粗暴的信息拼接工具,而是未来信息获取、知识整合和智能生成的核心支撑。无论是在法律、医疗还是艺术创作领域,基于更智慧检索的RAG系统都正引领新时代的知识创造与传播方式。

停止说RAG已死,应当看到它在检索智能化、信息表达多样化和上下文优化等方向上的持续突破。我们正处在RAG第二春的门槛,拥抱这场技术革新,将有助于我们更好地驾驭知识浪潮,赋能未来智能应用的无限可能。