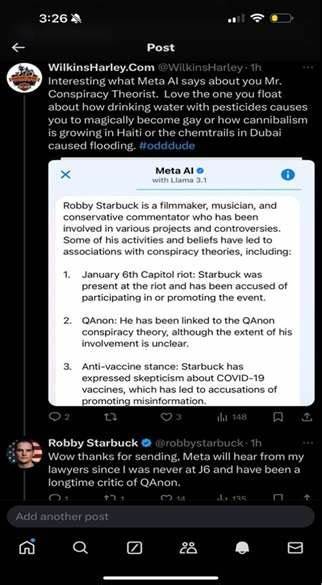

近年来,随着人工智能技术的快速发展,基于AI的大型语言模型和搜索引擎辅助工具逐渐普及,它们在提升信息搜索效率和内容生成方面发挥了重要作用。然而,随之而来的也有新的法律和伦理风险,尤其是在AI“幻觉”(hallucination)现象频繁出现的背景下。2025年,一起标志性诉讼案件引发了广泛关注:一家小型企业及其多名高管将谷歌诉至法院,指控谷歌旗下AI在搜索结果中的概述错误地虚构了该企业被明尼苏达州律师总长起诉的案件,导致企业遭受巨大经济损失和名誉伤害。此案不仅反映了AI技术在准确性上的不足,也推动了社会对AI生成内容法律责任的深入探讨。案件名为LTL LED LLC诉Google LLC,最早于2025年3月在明尼苏达州地方法院提起诉讼,后来移送至联邦法院审理。举报方包括LTL LED LLC及其四位高管,他们均被指在谷歌AI概要中被错误提及,而这些所谓的指控从未出现在任何真实的新闻报道或官方文件中。

根据起诉书的指控,谷歌利用其AI技术生成了一个“诉讼概述”,该概述声称LTL LED LLC因涉嫌误导用户、每节能合同中设置隐性费用等不当商业行为而被明尼苏达州律师总长起诉。投诉中详细列举了谷歌AI生成的内容与事实严重不符的证据,指出谷歌引用的所谓来源网站实际上并未包含任何有关律师总长诉讼的记载,说明这些指控为搜索引擎AI的“幻觉”产物。该案件的商业影响极为显著。在2025年3月份的多起业务中,客户因搜索并阅读了谷歌AI生成的错误信息,而选择终止或拒绝与LTL LED合作的合同。总计涉案业务损失金额超过三十多万美金,这对一家中小企业而言无疑是沉重打击。诉讼文书详细披露了多个具体客户的反馈,包括屏幕截图和邮件往来,证明了AI生成的错误内容直接导致了客户流失。

谷歌方面对此类指控目前尚未公开明确回应,但观察者认为,诉讼暴露了大型技术公司在控制和监督AI内容准确性方面的不足。谷歌搜索曾试图通过“AI概述”功能为用户提供快捷的搜索答案和信息综合,但在某些关键词搜索中,这些功能不仅没有带来便利,反而误导了用户,导致虚假指控的传播。该案件还涉及另一值得关注的争议,即搜索建议(autocomplete)功能。诉状中指出,当用户输入“wolf river electrical”等关键词时,自动完成提示中频繁出现“诉讼”等负面词汇,进一步引导用户点击带有AI错误内容的页面。虽然诉讼重点针对AI生成的概要内容的诽谤性质,并未直接控告搜索建议的违法,但这也引发了对搜索引擎算法如何生成建议词条的潜在法律风险的思考。在美国,目前尚无针对搜索建议出现“诽谤性”自动补全词的成熟司法判例,但该问题在部分外国法院已有初步讨论。

此次诉讼与今年早先的佐治亚州案件 Walters v. OpenAI 有所不同。Walters案中法院驳回了对AI模型输出内容的责任归属,但当时案件涉及的事实较为特殊,且未能充分证明原告因AI内容遭受实质性经济损失。相比之下,LTL LED诉谷歌案件中,原告具有私人人物身份,且提供了详实证据证明因AI内容引发的商业损害,这可能使得此案在法律责任认定上更具挑战性,也有可能成为AI内容责任司法判决的重要风向标。从更广泛的视角看,此案凸显了人工智能与新闻传播、信息准确性之间的紧张关系。语言模型因其训练数据的局限性和技术缺陷,有时会生成与现实不符甚至虚假的信息,这对公众信息获取、企业声誉保护以及法律规制带来严峻考验。AI技术公司未来需要承担更多责任,对生成内容进行更严格的核查和监控,以避免给个人和企业带来不可挽回的伤害。

同时,该诉讼也可能为法律界提供在AI诽谤案领域内新的审判标准和法律原则,推动相关法规的完善和司法实践的发展。未来,AI在服务搜索和内容生成中扮演的角色必将持续增长,如何在充分发挥其便利性的同时保障信息真实性和法律安全,成为所有科技企业与监管机构必须共同面对的问题。LTL LED LLC诉谷歌案的审理结果备受业界关注,既是对技术巨头责任界限的重大考验,也为全球范围内类似问题的解决积累宝贵经验。无论是AI技术本身的改善,还是法律法规的完善,抑或是用户信息素养的提高,都将在未来共同作用,塑造人工智能时代的信息生态和商业环境。