引言 人工智能进入大规模落地的时代,GPT-4成为讨论焦点之一。作为OpenAI推出的第四代生成式预训练变换器,GPT-4在多模态能力、上下文理解与推理表现上较前代有显著提升。理解GPT-4的能力与限制,有助于企业设计合理的AI战略,也能帮助个人更安全高效地使用大型语言模型。 GPT-4的技术轮廓 GPT-4被定义为大型语言模型和多模态模型,能够处理文本与图像输入,并在实际产品中展现语音交互与图像理解能力。OpenAI对具体架构、参数规模与训练细节并未全面公开,但官方披露了模型在上下文窗口、模态支持与接口能力方面的关键改进。GPT-4提供多种上下文长度版本,从8k到32k甚至更大的上下文窗口,这意味着模型能在单次交互中记住更多的对话历史与文档内容,允许更连贯的长期任务执行。

多模态与交互能力 GPT-4的多模态能力允许用户上传图片并基于视觉信息进行问答、说明与创作,结合语音接口则能实现更自然的对话体验。结合插件或外部接口的能力,使GPT-4能够调用搜索、执行API请求或生成与其他系统交互的内容。这些扩展功能把模型从"文本预测工具"转变为集成式智能助手,能够参与代码编写、数据分析、文档总结、图像理解等复杂工作流。 性能与应用场景 在编程、法律、医疗等专业测试上,GPT-4较GPT-3.5表现出更强的推理与应试能力。例如在医学考试和专业认证测评中取得了优异成绩,但研究也指出,尽管模型在测试中能获得高分,它在实际医疗建议中的风险仍然存在,因为模型可能产生虚假的细节或遗漏关键背景信息。企业级应用包括客户服务自动化、文档处理与知识管理、教育辅导与内容生成等,许多公司通过API将GPT-4整合进现有产品以提升效率与用户体验。

GPT-4的变体与演进 OpenAI在GPT-4基础上推出了多种变体,例如支持视觉输入的GPT-4V,以及后续的GPT-4 Turbo和可处理多模态与实时音频的GPT-4o。GPT-4 Turbo在成本与响应速度上进行了优化,适合对延迟和费用敏感的产品;GPT-4o强调多模态实时能力,扩展了语音与图像的即时交互场景。了解这些变体有助于在不同业务场景中做出合适的模型选择。 局限性与风险点 尽管GPT-4提升明显,但其局限性依然不可忽视。模型会出现"幻觉",即生成与事实不符或不存在的信息,尤其在需要精确事实或法律、医疗建议时风险更高。模型的决策机制缺乏完全透明性,解释性的回答往往是事后构建的陈述,无法保证与内部推理过程一致。

偏见问题也仍然存在,训练数据中的偏颇会反映在模型输出中。长期对话或复杂任务中的一致性与可信度问题是实际应用必须重视的风险管理点。 训练与成本考量 关于训练细节,OpenAI选择不公开全部技术参数,理由包括竞争与安全考量。已知的是GPT-4经过大规模数据的预训练,随后采用人类反馈的强化学习(RLHF)进行对齐,使模型在安全与有害内容防护上有更严格的拒绝策略。训练成本高昂,据公开报道训练耗资超过亿级美元,这意味着模型开发与迭代对计算资源与资金投入要求极高,也推动了产业对更高效训练方法与专用硬件的需求。 伦理、监管與社会影响 随着GPT-4被广泛应用,伦理与监管议题日益突出。

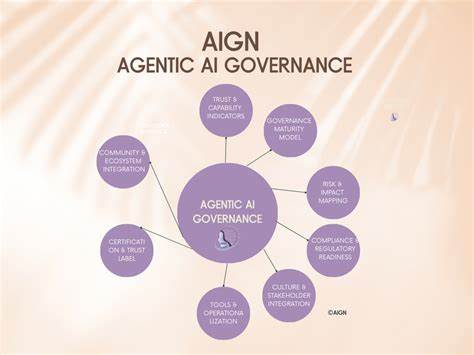

文本生成可能被用于错误信息传播、深度伪造或自动化诈骗;在劳动市场,部分岗位面临自动化替代的风险,但也可能催生新型工作与技能需求。各国监管机构与行业组织正尝试制定AI安全与透明度标准,鼓励模型开发者在发布前进行审慎评估并提供使用限制与溯源机制。 如何在企业中安全落地GPT-4 企业在采用GPT-4时,应从需求端明晰目标,评估模型适配性,并建立多层次的安全策略。首先要定义可接受的风险阈值,对于高风险领域如医疗、法律等,需要结合人类专家审查与模型输出验证。其次,要在产品层面设计回退机制与可解释日志,以便在异常行为时迅速排查并修正。最后,合规性审查、数据隐私保护与用户告知也是关键环节,尤其是在处理敏感用户数据时必须符合当地法律与行业规范。

面向开发者的实用建议 开发者在调用GPT-4 API时,应重视提示工程(prompt engineering)的作用,通过结构化输入、示例化提示与分步推理引导模型生成更可靠的输出。采用链式思维(chain-of-thought)或分解任务的策略,有助于提升多步骤推理任务的准确性。此外,对生成内容进行后处理与校验、结合外部知识库进行事实核验、以及在模型输出层加入置信度评估与人工审查,都是降低错误与幻觉影响的有效手段。 教育与学习领域的机会与挑战 GPT-4在教育领域提供个性化辅导、自动化题目解析与作文批改等功能,能够显著提升学习效率与教师教学辅助能力。然而,教育应用也面临学术诚信、依赖性增强与评估标准适配的问题。教育工作者需要设计能够促进思辨、避免代写并提升学生信息素养的使用策略,同时教育政策层面也应更新考核方式,以适应AI辅助学习环境。

医疗与法律等高风险应用的审慎路径 在医疗、法律等高风险领域,GPT-4的辅助价值明显但不能替代专业判断。临床决策支持、病历摘要与文献检索可以借助模型提升效率,但所有临床建议必须经过有资质医师的审核。法律文档起草与初步法律检索可作为律师助理工具使用,但在法律意见出具、诉讼策略制定等核心任务上仍需律师把关。建立明确的责任边界与合规流程是部署的前提。 公众理解与科普的重要性 公众对GPT-4的认知影响着社会接受度与政策导向。通过科普与透明沟通,企业与研究机构应向公众解释模型能力与局限,示范合规使用场景,避免夸大技术能力或对风险隐瞒不报。

提高全民的数字与AI素养,有助于构建更理性的公共讨论与更稳健的监管环境。 未来展望 未来大型语言模型的发展可能呈现多模态一体化、实时交互与更强的可解释性方向。计算效率提升、微调成本下降与定向对齐技术进步将推动模型在更多垂直场景中落地。同时,模型安全与可验证性研究将成为核心议题,如何在开放创新与风险控制之间取得平衡,将决定技术能否长期为社会创造正向价值。 结语 GPT-4代表了大型语言模型在能力与应用层面的重要跃迁,但它并非完美无缺的万能工具。理解其技术特征、实际应用价值、潜在风险与监管要求,能够帮助组织与个人更明智地利用这一类技术。

未来的关键在于通过合理的工程实践、审慎的政策监管与持续的公众教育,将GPT-4及其后续模型的潜力转化为可持续且值得信赖的社会资产。 。