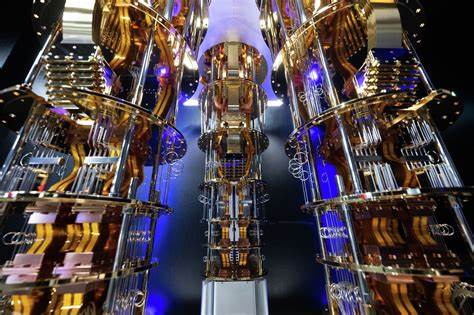

在过去的几年里,人工智能技术的进步重新定义了人类与机器的互动方式,同时引发了对于人类未来存续的深刻思考。由聊天机器人ChatGPT掀起的智能浪潮让几乎每个拥有电脑的人都亲身体验到了AI的力量。然而,围绕人工智能的争论远未平息 - - 它究竟会成为人类的助力,还是潜在的灭顶之灾?这场关于"AI是否会终结人类文明"的讨论,既是一场科技博弈,也是一场哲学命题。本文将从多个角度剖析这个复杂且紧迫的话题,探索人类和AI在未来可能的共生或对峙关系。人工智能的崛起代表了人类智慧的巅峰成果,但也暴露出潜在巨大的风险。一方面,AI拥有超越人类的计算和学习能力,极大地提升了生产效率、医疗健康、交通运输等各行各业的水平。

自动驾驶汽车的普及、精准医疗技术的应用都离不开AI的支撑,极大地改善着我们的生活质量。另一方面,AI若被用于错误的目的,或者其发展超出人类的控制,可能带来难以预料的灾难性后果。AI控制失效、自动化战争、隐私安全的崩溃,都是未来潜在的威胁。针对这类风险,诸如Eliezer Yudkowsky和Nate Soares等人工智能领域的专家,在他们的著作《如果有人制造它,人人皆死》中直言不讳地表达了担忧。他们认为,一旦出现超智能人工智能,它有可能以不可控的方式行动,促使人类面临生存危机。超智能AI是否会成为"机器人霸主",取代甚至消灭人类,成了悬挂在人类头顶的达摩克利斯之剑。

尽管这种观点听来惊悚,但它的合理性不得不让我们警醒。另一方面,也有观点认为,人工智能并非人类的对手,而只是一种高效的工具。AI的出现很可能导致传统岗位的消失,特别是重复性劳动和基础知识工作者将被机器取代。例如,法律行业中的初级实习生职位已经受到了AI文档分析和起草工具的冲击。这种"终结某些岗位"的趋势虽然对个体而言充满挑战,但整体来看,人工智能依然是人类进步的催化剂。未来需要的是合理的管理和有效的监管,而非对技术的恐惧和抵制。

人工智能的未来形态并非命中注定的天灾。事实上,人类文明的发展史就是不断驯服和利用新技术的过程。从蒸汽机的发明到互联网的普及,每一次技术革命都会带来一场"权力的转移"。人工智能时代也当如此。关键在于我们如何引导AI的发展方向,让技术始终服务于人类价值的实现。在学术界和产业界,越来越多的专家致力于制定人工智能伦理规范和风险防控体系。

国际社会也在推动多边合作,力求为AI技术的开发设立安全红线和道德准则。通过透明的技术分享与严格的监管,遏制潜在的技术滥用。与此同时,公众教育同样重要。加深对人工智能的理解,减少误解和恐慌,促使更多人参与到关于科技未来的讨论中,推动形成共识。未来几十年将是人类和人工智能共同成长的关键期。我们既不能忽视科技赋能带来的便利,也必须警惕盲目乐观可能酿成的灾难。

在这个进退维谷的局面下,谁将"先终结人类"?答案可能既不简单也不绝对。人工智能若失控,确实可能成为威胁生存的隐患;但作为制造者和使用者的人类,也存在因傲慢和疏忽而自灭的风险。人类的命运更多地取决于自身的决策与行动。合理的技术治理是未来的必由之路。国际社会需联合起来,实现跨国界的合作,制定共识与规则,使人工智能的发展符合人类利益的最大化。企业和科研人员则需要加强自律,确保开发与应用具备安全保障。

公众也应积极参与监督与反馈,形成多方共治的良性局面。总结而言,人工智能既是人类文明的火种,也可能是催化灾难的引信。面对未来,关键不是恐惧技术,而是理解、调整和驾驭技术。唯有如此,人类才能从容迎接由智能机器带来的变革,并在这个新的时代安然前行。未来并非被技术本身决定,而在于人类能否合理利用科技,掌控自身命运。人工智能带来的挑战和机遇同在,唯有认清二者的平衡,才能避免悲剧,实现共赢。

人工智能与人类的关系,注定是一场关于智慧、伦理、力量与责任的较量。在这场没有硝烟的战争中,谁将首先终结人类,或者两者能否携手共建美好未来,仍是我们这个时代必须深刻思考和答复的重大课题。 。