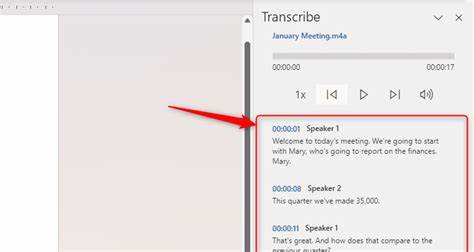

近年来,人工智能技术在各行各业得到广泛应用,尤其是在医疗健康领域,许多人寄希望于AI能帮助提升效率、降低成本。作为监管行业的典范,美国食品和药物管理局(FDA)近年来也投身于AI的革新浪潮,试图通过引入Elsa这一大型生成式AI工具改善员工的工作效率并加速新药审批。然而,一份由CNN独家发布的调查报告揭露了一个令人震惊的事实:Elsa生成的研究报告中存在大量虚假信息和不存在的研究数据,这不仅危及审查流程的严谨性,更对公众健康构成潜在威胁。FDA内部多位现任及前任员工向媒体透露了他们对Elsa的真实看法。这些员工表示,虽然Elsa在协助撰写会议纪要和总结方面提供了一定便利,但其“幻觉”现象尤为严重。所谓“幻觉”是指AI系统在缺乏真实数据支持的情况下,凭空编造不存在的研究、结论甚至数据结果,然而其表达却异常自信且具说服力。

多位知情人员指出,这种虚假生成在FDA这样关键的公共健康监管机构出现,极具风险。如果没有严格审查,每当Elsa反复输出错误或虚构的研究成果时,相关决策者将可能基于错误信息批准药品,进而对患者健康带来灾难性后果。与此同时,FDA内部公开流出的幻灯片显示,部署Elsa仅花费了大约12000美元,远低于预期预算。但低成本似乎带来了低质量输出的问题。FDA院长Marty Makary曾对此AI工具寄予厚望,称其“提前完成且预算充足”,但现实情况却让许多员工质疑当前AI模型的实用性和可靠性。AI工具生成一段摘要用于快速理解数十页长的医学研究报告本应大幅提升效率,然而其摘要的准确性难以保证。

尤其是在新药审批里,细节往往决定成败,一个未察觉的警示信息可能使后续监管失效,甚至出现安全隐患。FDA员工坦言,他们曾多次测试Elsa关于某类药物儿童用药数目的回答,结果却是断然错误的信息,虽然系统会“表现出道歉”,但作为机器的纠正并不能替代人工核实。这种现象暴露出当前AI在医学及监管领域应用中的核心难题:智能并不等于准确,尤其是在需要实证与责任的领域。除了FDA层面的问题之外,罗伯特·F·肯尼迪(Robert F. Kennedy Jr.)担任卫生与公众服务部部长后,积极推进包括FDA在内的各大机构大规模采用生成式AI。其主张用AI系统加快新药审批效率的言论多次引发争议,外界普遍担忧这种“一刀切”的方案忽略了技术本身的局限性及安全隐患。此前,他领导的“Make America Healthy Again”(MAHA)委员会发布的一份报告中,也被发现大量引用了不存在的研究文献,有些报告内容被误解甚至曲解,某些虚假引用来自未公开或根本不存在的论文。

虽然暂时无法确认该报告是否由Elsa生成,但这一事件反映了AI技术介入公共卫生政策过程时的双刃剑效应。另一方面,FDA在回应媒体质疑时态度强硬,有负责人直接否认所谓AI“幻觉”问题,甚至批评CNN报道失实。在声音立场上,FDA似乎在平衡AI工具的推广与维护公信力之间举棋不定。此类争议的背后折射出更深层的技术治理难题。现代AI,特别是大型语言模型(LLM),虽具备强大生成能力,但其缺乏原创性信息和事实核查机制,容易造成“自信式错误”,在卫生监管领域须格外小心。FDA作为医疗监管的权威机构,若不能建立完善的AI输出核验体系,将难以保证监管质量,甚至影响药品安全与公众信任。

同时,公众对AI的盲目信任亦可能使监管失误的后果更加严重。因此,科学界与监管界需共同努力,加强AI工具在医疗领域的实证验证和透明监管,确保其辅助而非代替人类专家判断。未来,如何权衡效率与安全,如何建立可信的AI辅助审批体系,将成为FDA及全球监管机构必须面对的核心挑战。此外,推广AI健康设备和可穿戴技术的趋势也引发业界讨论。如卫生部长所述,希望未来普及健康监测设备,但其医疗价值和必要性需专家深入考量,避免被商业利益过度驱动而影响科学决策。整体来看,FDA引入Elsa事件不仅引发了公众对AI在新药审批中安全性的担忧,也提醒我们:技术进步固然重要,但唯有严谨核查和负责任的使用,才能真正造福人类。

AI并非万能神话,监管机构需脚踏实地、理性审视,确保科技发展永远以公共利益为先。