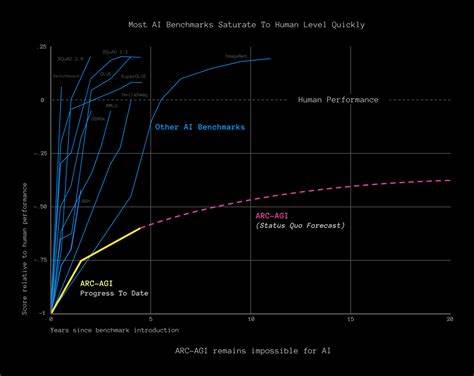

随着人工智能技术的不断进步,越来越多的行业开始依赖AI来提升效率、优化决策和创新服务。然而,在令人惊叹的技术背后,AI系统面临着一个严重且常被忽视的问题 - - "幻觉"。所谓"幻觉",是指人工智能模型在生成信息时,给出错误、虚假甚至完全无关的答案。尽管这些回答往往表现得极具说服力,但其真实性却无法被保证,甚至可能误导用户。正因如此,AI"幻觉"成为制约其大规模安全应用的最大威胁。人工智能幻觉的本质涉及生成式AI模型的工作机制。

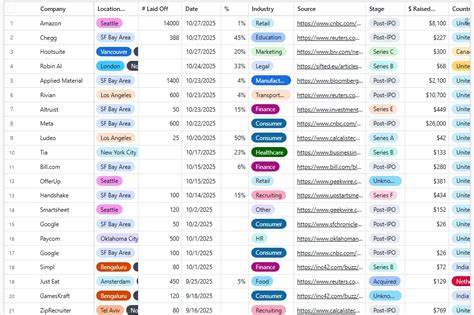

以大型语言模型为例,系统通过在海量文本数据中学习语言模式,进而预测和生成文本。在这个过程中,模型并不是在"理解"信息,而是基于概率估计输出最可能的词语组合。因此,模型可能在缺乏充分真实信息的情况下,凭借训练数据的片段或关联,生成错误内容。这一现象在处理专业领域、复杂推理或实时更新信息时尤为明显。幻觉的存在不仅影响用户体验,更可能对商业和社会造成深远影响。在医疗、法律、金融等关键领域,错误的AI建议可能导致严重后果。

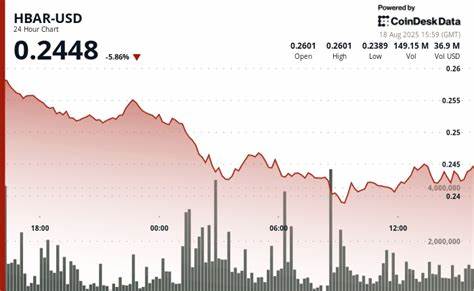

例如,医疗诊断中的错误信息可能影响患者的治疗方案,法律咨询中的错误判定可能引发法律风险,金融建议中的虚假数据则可能导致经济损失。除此之外,幻觉还会损害公众对人工智能的信任,这是推动AI广泛应用不可忽视的软性障碍。针对幻觉问题,学术界和工业界正在积极寻找解决方案。提升模型训练数据的质量和多样性是基础,通过引入更多权威、结构化和最新的知识库,帮助模型获得更准确的信息支持。此外,开发辅助验证机制,例如结合检索技术与生成模型,让AI在生成内容时能够访问外部知识源,从而减少虚假内容的产生。同时,研究人员还致力于设计更有效的模型结构和算法,优化模型对上下文的理解和逻辑推理能力,这些都旨在提升生成内容的准确性和可信度。

用户在面对AI生成的信息时,也应保持批判性思维。教育公众识别和质疑潜在错误,配合专业人士对AI输出进行二次验证,构建人机协作的信任生态同样至关重要。企业在部署AI解决方案时,必须制定严格的质量监控标准和风险管理流程。结合技术手段和流程管理,有效预防由于幻觉导致的错误传播,确保AI系统在实际应用中的安全稳定运行。未来,随着技术的不断进步和研究的深入,人工智能"幻觉"现象有望得到显著缓解。多模态AI、结合自然语言理解与知识图谱的混合模型、以及更智能的监督学习方式,可能成为突破的关键。

总而言之,幻觉作为人工智能发展的双刃剑,既反映出技术的复杂性,也提醒我们必须对AI的局限性保持警觉。唯有通过技术革新与合理监管相结合,才能实现AI的健康发展,推动其真正惠及社会各个层面。 。