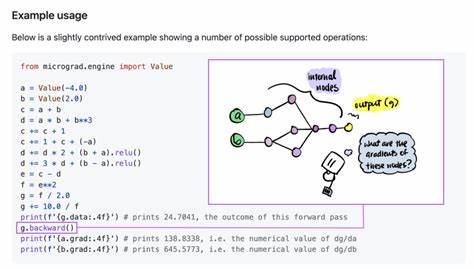

随着人工智能和机器学习的广泛应用,自动微分技术变得日益重要。自动微分使得计算复杂函数的导数变得简便快捷,极大地推动了神经网络和深度学习算法的发展。而在众多自动微分框架中,Micrograd以其极简而纯粹的设计理念吸引了大量开发者关注。现在,Scala版的Micrograd应运而生,为追求函数式编程和高效性能的工程师们带来了新的选择。Scala语言本身融合了面向对象和函数式编程的优势,拥有强大的类型系统和丰富的库生态,这为实现类似Micrograd这样兼具纯函数式设计和自动微分能力的工具提供了良好的基础。Scala版本的Micrograd采用了纯函数式的编码方式,通过定义变量、构建数学表达式以及进行自动求导,成功打造了一个轻量但功能完善的自动微分引擎。

它不仅支持标量运算的微分,还为多层感知机(MLP)的训练提供了基础设施。对于机器学习初学者而言,Scala版Micrograd是理解神经网络反向传播和梯度计算的极佳实践范本。该项目还自带了友好的领域专用语言(DSL),让用户能够自然地定义权重、偏置和运算表达式,从而直观地构建模型。这种设计不仅方便表达复杂的数学结构,也便于调试和可视化。Scala版Micrograd提供了丰富的可视化功能,通过Graphviz等工具,将数学表达式图形化展示,帮助开发者更好地理解计算图的构成与依赖关系。尤其是在神经网络模型训练过程中,动态图形化能有效辅助用户观察参数更新和学习状态,提升调试效率。

项目中包含了一些精彩的示例,比如用单层神经网络拟合正弦函数。通过随机采样0到2π之间的数据点,然后以梯度下降法不断调整权重,网络最终成功捕捉到sin函数的波动趋势。这不仅证明了自动微分引擎的实用价值,也显示了函数式设计在机器学习中的潜力。另一个经典示例是月亮形状数据集(Moon Dataset)的二分类问题。该数据集以其曲线形状的决策边界著称,对于网络的泛化能力是很好的考验。Scala版Micrograd实现的多层感知机在训练后能够准确分辨数据类别,进一步验证了其作为神经网络引擎的可靠性。

自动微分和神经网络模型训练历来具有高计算复杂度,但基于Scala的纯函数式设计,使得代码更加简洁、可维护且具备良好扩展性。Scala生态中成熟的构建工具SBT和图形渲染工具Graphviz的支持,为工程化应用和可视化分析提供了坚实保障。特别是在当前机器学习向通用编程语言融合的趋势下,Scala版Micrograd呈现了独特优势。它不仅方便进行数学建模和函数微分,而且天然支持并行处理和数据流编程,满足现代复杂应用需求。此外,项目的开源特质使得开发者能够深入阅读源代码、参与改进以及进行个性化定制。这种透明开放的环境催生了活跃的社区讨论,推动了Scala在机器学习领域的影响力。

对于希望深入掌握自动微分原理的学习者来说,Scala版Micrograd以纯函数式范式为核心,帮助他们厘清计算图、链式法则和梯度传播之间的联系。得益于其简洁直观的API,用户无需过多环境配置,即可动手进行模型搭建与训练。与此同时,工业界也可以借助该工具快速验证新算法概念,或者开发小规模神经网络原型,降低研发门槛。Scala版Micrograd并非追求极致性能优化,而是在确保准确性的前提下,突出代码的优雅与易用。它用轻量化理念避免了冗余复杂设计,强调表达性和学习成本的平衡,适合教育、实验和原型开发场景。未来,随着机器学习算法的不断演进,Scala社区有望围绕Micrograd构建更丰富的模型库和功能组件,促进自动微分与函数式编程的深度融合。

结合Scala强大的类型推断以及Akka等分布式框架,微分引擎有潜力扩展为支持大规模分布式训练的生态系统。总结而言,Scala实现的Micrograd为自动微分和神经网络建模提供了一个纯粹且轻量的解决方案。它完美融合了函数式编程的优势与现代机器学习的需求,有助于开发者快速入门并深入理解自动微分核心机制。无论是学术研究、教育教学还是小规模工业应用,该引擎均展现出广泛的适用性和强大的生命力。未来持续完善和社区协作,将使其成为Scala机器学习生态中的重要里程碑。Scala版Micrograd的出现,代表了自动微分技术在多样化编程语言中的深入开花,彰显了函数式思维在人工智能领域不可忽视的价值。

。