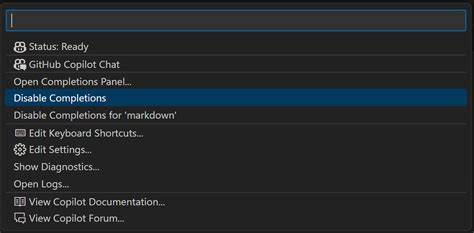

近年来,随着人工智能技术的高速发展,智能代码补全工具逐渐成为开发者编程过程中的得力助手。GitHub Copilot作为业界领先的代码智能生成工具,凭借深厚的模型能力和微软的强大资源支持,迅速获得了广大开发者的关注和青睐。作为VSCode集成的重要组件,Copilot的自动补全功能极大提高了代码编写效率。然而,近期有用户反映,VSCode中GitHub Copilot的补全功能在未经明确通知的情况下被自动激活,这一现象引发了业界及社区的广泛关注与讨论。用户发现,在未提供任何GitHub账户信息的情况下,Copilot突然开始生成智能提示,甚至伴随弹窗告知"GitHub Copilot应用现代化"信息请求账户授权,这不仅令用户措手不及,也引发了关于数据隐私保护、用户知情权和软件透明度的重重疑问。VSCode作为开源且自由度极高的编辑器,其插件及扩展机制一直以来备受推崇。

用户对安装扩展时的权限管理和隐私保护有着较高的期待,而Copilot作为微软旗下服务,自动激活且无显著通知的行为似乎背离了开放且负责任软件开发的原则。许多开发者表示,未经明确告知而开启的自动补全功能不仅令使用体验大打折扣,更可能导致商业秘密代码外泄风险,毕竟Copilot依赖云端的AI模型进行推断,用户源代码在传输和处理过程中是否得到充分保护成为非常敏感的话题。此事件引发了软件行业关于用户控制权和隐私保护的深刻反思。智能辅助工具的便利性和性能提升毋庸置疑,但技术的快速迭代必须建立在尊重用户意愿和充分告知的基础上。软件开发商应珍视用户信任,明确告知任何可能影响体验和隐私的功能变更,同时提供简单切换和关闭机制,保障用户自主选择权。此外,用户也需要增强自身的数字素养,及时关注所使用工具的更新日志与隐私条款,合理配置权限和账户绑定,避免潜在风险扩大。

针对Copilot此次自动启用争议,专家建议微软及GitHub应公开透明说明相关设计逻辑和后续改进计划。改进用户界面交互提示,确保任何功能升级变更都具备显著告知环节,同时加强用户数据加密处理和访问控制,提升安全防护等级。同时,社区也应积极发声,促进标准化的隐私保护规范落地,推动人工智能辅助软件行业健康可持续发展。在当下大模型AI逐渐渗透到软件开发全流程的背景下,如何平衡技术创新和用户权益成为亟待解决的议题。VSCode Copilot自动补全未经通知即启用事件为业界敲响了警钟,提醒所有参与方共同建立起开放、透明且高效的沟通机制,护航技术与人文的和谐共生。展望未来,智能代码助手必将持续优化迭代,助力开发者释放更多创造力,但前提应是尊重每一位使用者的选择和隐私,营造更加信赖的数字生态环境。

最终,只有在坚守用户优先和隐私保护的原则下,AI驱动的软件开发工具才能真正发挥最大价值,助推整个行业迈向新高度。 。