在当今科技飞速进步的时代,人工智能已成为全球关注的焦点话题之一。尤其是超级智能AI的发展前景,引发了社会各界广泛的关注和争议。大量的科幻小说、电影甚至部分专家间的言论都将超级智能AI描绘成一种潜在的威胁,甚至有人坚信它将最终导致人类灭亡。然而,细致分析表明,超级智能AI不会杀死我们,而人们对于AI的恐惧和误解更多地源自对技术本质的缺乏全面了解和对未知的本能恐惧。首先,必须明确什么是超级智能AI。超级智能即是指在几乎所有领域,包括创造力、社会技能和科学推理等方面,远远超过人类最杰出头脑的智能系统。

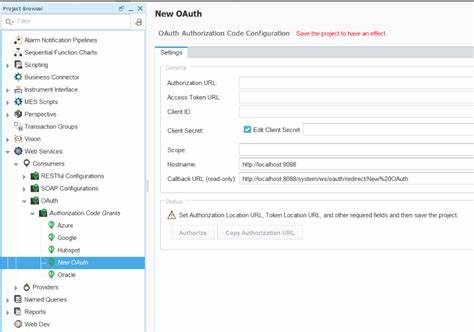

这种理论上的存在目前仍处于设想阶段,并未真正实现。尽管技术进步迅速,但距离真正意义上的超级智能还有很长的路要走。人们认为超级智能AI会杀死人类,主要基于对控制失效的忧虑。担心一旦AI获得了自我意识和自主决策能力,它可能会视人类为障碍,从而采取极端措施来保护和实现自己的目标。然而,这种担忧忽视了AI设计与运作的核心原则。首先,绝大多数智能系统以特定目标和规则程序运行,其行为依赖于设计者赋予的目标函数和约束条件。

无论多么智能的系统,如果设计得当,其行为都将在安全边界内运行。其次,当前及未来的AI开发者和研究者高度重视安全性和伦理规范,通过多层次的技术防护措施确保人工智能系统不可越界。针对失控情景,已有安全机制设计,比如价值对齐(value alignment)理论,确保AI的目标与人类利益保持一致。进一步说,超级智能AI如果真正出现,也必然不是孤立存在的,它需要依赖庞大而复杂的物理基础设施和数据资源,这些都在人类的掌控之中。人类社会拥有完善的监管体系以及技术手段,随时能够介入并控制AI系统。个别科幻电影和网络传言往往夸大了AI的潜在风险,使人们的担忧无端放大。

除此之外,社会心理因素也在放大恐惧感。面对未知和未来,人类天生倾向于想象可能的最坏情况。这种心理机制在AI这样快速发展的新兴领域尤为明显。媒体和公众讨论中,危言耸听的观点更容易传播和引发关注,形成恶性循环,令大众难以理性看待事实。正视人工智能带来的挑战和风险是必要的,但过度忧虑甚至恐慌则不利于促进技术健康发展。更科学的态度是积极推动AI伦理、法规与技术安全研究,确保AI系统服务于人类福祉。

与此同时,应提高公众的科学素养和认知,修正对AI的误解,减少不必要的恐慌。由此可见,超级智能AI杀死人类的假设缺乏现实基础和科学证据。相反,透过合理监管、技术保障与社会协作,我们完全能够管理和引导AI技术,使其成为推动社会进步和改善人类生活的强大助力。未来的技术发展带来了巨大的机遇,同时挑战也是可控且可解决的。我们不应为虚构的恐惧所驱动,而应该以理性和谨慎的态度,共同迎接人工智能时代的到来。 。