随着人工智能技术的迅速发展,基础模型(Foundation Models)作为推动智能应用革新的关键力量,备受业界关注。基础模型借助大规模数据预训练,具备强大的泛化能力和迁移学习潜力,成为智能助手、图像处理、语音识别等多领域应用的核心。然而,令人关注的是最新的iOS 26系统在实际测试中,基础模型尚未达到理想的可用状态,影响了开发者与用户的体验和期望。本文将深入解析iOS 26中基础模型不可用的多重原因,探讨相关技术障碍和生态系统现状,并展望未来解决方案与发展趋势。首先,iOS系统的封闭性及安全策略为基础模型的集成带来不小挑战。苹果一直秉持严格的隐私保护与数据安全理念,其操作系统设计使得大规模模型运行和权重加载面临不少限制。

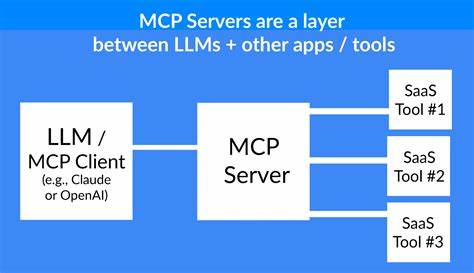

基础模型通常需要庞大计算资源及内存支持,而iOS设备的硬件配置虽不断提升,但依然难以匹配云端训练后台的强大能力。此外,基础模型的模型文件较大,加载时间长,对存储和启动速度产生压力。iOS 26未能提供足够的本地硬件加速方案和内存扩展机制,致使基础模型运行效率不佳,难以实现流畅交互体验。其次,软件层面的兼容性问题也不容忽视。基础模型通常借助深度学习框架如TensorFlow、PyTorch等树立训练及推理环境,而苹果的原生机器学习框架Core ML与这些生态存在接口适配差距。尽管苹果不断优化Core ML,但对某些复杂基础模型的支持仍有限,导致在iOS 26系统中无法高效执行或影响模型的完整性。

此外,基础模型的不断变化和升级也对系统的适配能力提出较高要求,iOS 26在支持动态更新和热插拔模型方面尚未形成成熟机制。再者,基础模型的计算资源消耗及能效限制也是关键瓶颈。移动设备受制于电池容量和散热设计,无法长时间支撑高强度的神经网络推理任务。iOS 26即使搭载了最新芯片,也难以实现基础模型连续在线运行,避免发热引发的性能下降或设备过热。此种硬件限制使得基础模型在移动端的实际应用处于受控状态,难以完全释放其潜能。第四,生态环境和应用推广策略也影响基础模型的普及。

苹果生态系统中应用开发受限于App Store政策和审核机制,加载大模型可能在上架和版本更新中遇到合规问题。同时,开发者需付出更多精力进行模型迁移和压缩优化,增加了技术门槛和时间成本。iOS 26尚未提供完善的工具链和文档支持,进一步延缓了基础模型在该平台的有效落地。面向未来,解决iOS 26上基础模型不可用问题需从软硬结合及生态协同两方面着手。硬件方面,期待苹果加大在神经引擎和面向AI的芯片架构升级力度,提升本地推理性能与能源效率。软件层面,应完善Core ML支持,增强其对多种基础模型的兼容性及动态调整能力。

同时,开放更多API接口,方便开发者灵活管理和部署模型。此外,通过云边协同计算优化策略,结合云端强劲算力与本地快速响应优势,有望缓解设备资源受限的困境。苹果若能推动生态建设,提供统一标准和分享机制,将促进基础模型快速集成入应用层,提升用户体验和应用丰富度。总之,iOS 26当前基础模型不可用,反映了移动端AI技术与硬件能力间仍存在的鸿沟。用户和开发者应保持理性期待,关注苹果未来对于AI支持的迭代更新。通过持续优化系统架构、加强生态赋能,基础模型在iOS上的应用前景依然广阔。

作为新兴智能技术的重要组成部分,基础模型的国产化与国际合作也将加速推动其成熟与普及,为智能移动设备带来跨时代的变革机会。未来随着硬件性能的提升、软件兼容性的完善以及开发者社区的壮大,iOS系统中基础模型的应用必将迎来质的飞跃,推动移动人工智能迈向新的高度。