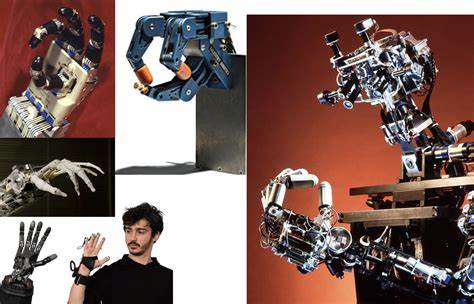

近年来仿人机器人话题热度暴涨,从媒体头条到风投资本的资金流向,仿佛只要复制人的外形与关节就能复制人的能力。但现实并不如想象那般简单,尤其是在手部与全身的灵巧操控能力上。要理解为何当下主流仿人机器人在短期内难以具备人类级别的灵巧性,需要从传感、执行机构、数据与学习范式以及物理安全等多维度来审视。本文将系统梳理这些障碍,帮助研发者、投资者和政策制定者更理性评估仿人机器人前景。 人类灵巧性的根源远不止于视线追踪或关节角度。我们的手、前臂乃至全身配备着复杂的触觉与力觉系统,皮肤中密布多种类型的机械感受器,肌腱与肌肉里有长度与张力的反馈回路,人类在抓取、翻动、抚触和操控物品时,靠的是多通道的即时传感与高度耦合的控制策略。

触觉信息不仅提供接触位置和压力大小,更包含微振动、滑动摩擦和材料属性等时变信息,这些是实现稳定抓取、调整握力以及在接触异常时立刻反应的关键。缺乏这一层次的数据,任何仅依赖视觉的学习方法都只能学会视觉上"像样"的动作,而无法在现实物理世界中稳健地完成任务。 当下许多仿人机器人公司与研究团队热衷端到端学习,试图用大规模视频或模仿演示去训练控制策略。端到端方法在语音识别、图像分类和自然语言模型上取得突破,部分原因在于这些任务有可靠的前端表示或长期积累的传输标准,如声学特征、像素网格或文本标记化。语音与图像的成功也依赖于人类长期建立的采集、压缩与传输技术,使得训练数据在形式上便于学习模型利用。然而触觉与力觉信息没有被类似地标准化保存、远程传输或大规模采集的长期传统。

换言之,机器学习能够高效利用已有的输入表示,但如果关键的感觉通道根本没有被捕捉或编码,那么学习系统无论规模多大都难以弥补这一结构性缺口。 再看现在常见的数据收集策略。有些团队用多摄像头头盔或背包记录第一人称或多角度视频,试图从人类动作中直接学习操作步骤。但视频只反映外显的运动轨迹与视觉接触关系,无法捕捉到手指与物体微小接触时产生的力学反馈与滑动摩擦。还有团队采用遥操作(teleoperation)让人类通过操纵复制器来驱动机器人,这能获取更贴近机器人本体的轨迹数据,但遥操作往往缺乏精细的触觉回传,手指多自由度难以完整映射,人类操作者也无法通过视觉完全替代真实接触感受。因此,现有大规模演示数据依旧无法提供支撑通向泛化灵巧性的必要信息。

触觉数据的采集本身面临工程与生物学挑战。高密度触觉传感器需要覆盖手掌与指尖,既要灵敏又要耐用,还必须低功耗和易于制造。即使实现了高分辨率的皮肤式传感阵列,还需要将这些原始信号转换为可供学习的表示,并与关节角度、力矩、加速度及视觉信息同步记录。时间对齐、噪声处理、标注触觉事件等都远比单纯视频数据复杂。目前没有类似ImageNet或LibriSpeech级别的公开触觉大数据集,这直接限制了基于数据驱动方法的进展。 除传感器与数据问题外,应该学习什么也非常关键。

强化学习的主流框架通常以状态到动作的策略映射为目标,期望在大量试错中学会完成任务。然而人类在执行复杂操控任务时,往往采用分层的计划机制:先形成高层次的任务分解与动作序列,再在低层利用触觉反馈做即时微调。单纯训练端到端的策略在样本效率、可解释性与鲁棒性上都存在局限。更现实的道路可能是结合分层学习、模型预测控制与物理知识注入,让系统既能规划任务步骤,又能通过触觉进行局部修正。 物理世界的严苛性也是关键制约因素。不同于数据世界中容许错误的结果,现实中的错误会带来破坏性后果。

仿人机器人在操控时若无法可靠估计接触力与物体状态,就可能压碎脆弱物品或造成安全事故。在一些设想中,像特斯拉和Figure这样的公司寄希望于仅凭视觉就能解决手部灵巧问题,这不仅低估了触觉信息的价值,还忽视了现实接触中的不可观测变量。视觉加上丰富的触觉与力觉输入,才有可能实现在多变环境中的高鲁棒性操控。 行走与安全性是另一个常被忽略的问题。许多宣传视频展示的为小型或有限速度的仿人样机,这些在受控环境中看起来"安全可亲"。但当机器人放大到人类体型并在真实环境中行走时,动力学与标度法则让风险大幅上升。

体积放大导致质量以三次方增长,而结构强度只以二次方增长,关节与连杆的惯性能量也随之增加。电机与控制器为维持稳定需要在瞬时注入大量能量,一旦失稳或跌倒,快速运动的重型肢体会产生致命撞击。相比之下,轮式或履带式机器人在可预见范围内更容易保证安全。要让双足仿人机器人在人群中自由移动并被批准部署,需要在被动动态、能量回收、软体防护与故障模式下的安全释放机制上取得根本突破。 这些技术与安全上的挑战带来了经济与工程优先级的重新思考。制造一个真正"通用"的仿人机器人既昂贵又耗时,且很可能在多数场景下不如专用机器人高效。

仓储、分拣、清洁、护理等服务领域,许多工作可以通过专用移动平台或半人形设计的机器人以更低的成本和更高的可靠性实现。未来十五年内我们更可能看到的是"拟人化"而非严格仿真人形的机器人:它们可能在腰部拥有轮或履带移动系统,手部采用夹持器或模块化末端执行器,视觉系统结合主动光学传感器,整体形态与人类相似以便融入环境,但并非完全复制人体结构。 那么研究与投资应当如何调整?首先是把资源更多投向触觉传感与力觉数据标准化的建设,包括硬件传感平台、同步数据采集协议和统一的触觉标注体系。只有建立起可共享的大规模触觉数据集,学术与产业界才能在学习方法上开展纵深攻关。其次,重视分层控制架构与可解释的物理模型,将模型预测与即时触觉闭环结合,提高样本效率与安全可控性。再者,从工程角度推进软体机器人、可压缩防护材料与能量缓释机制,这些能显著降低跌倒与碰撞时的伤害风险,为仿人机器人在共存环境里赢得更多批准与接受度。

在策略选择上,遥操作与半自动化仍有重要位置。遥操作不仅是数据收集手段,也是现实部署的桥梁。在高风险或高度多变的场景,让人类远程介入可大幅降低事故风险并提升系统可靠性。长期来看,自动化水平会逐步提高,但短期实现有价值的商业化部署,遥操作与人机混合控制是现实可行的路径。 科技演进往往伴随语义的迁移。正如"自动驾驶汽车"与"飞行汽车"这类词汇在定义上逐渐偏离最初的含义,仿人机器人未来十五年的形态也会不断被重新定义。

那些今天还在强调严格人形外观的项目,可能会演化出更多非人形却功能强劲的变体。最终的赢家并非外观最像人类的机械,而是能在指定任务场景中以最低成本与最高安全性交付价值的系统。 综上所述,当下仿人机器人无法在短期内学会人类级别的灵巧操控,既有数据与传感短板,也有学习范式与控制架构的限制,更有物理尺度带来的安全挑战。解决这些问题需要跨学科协作、长期投入和务实的工程策略。对于研究者而言,触觉感知、分层控制与安全规范是未来攻关的核心方向。对于投资者而言,应当警惕过度乐观的时间表,优先支持能在短期内带来实际价值与安全保证的技术路线。

对于社会与监管机构,则需要尽早制定针对移动仿人机器人的安全认证与运行规范,以免技术快速部署带来不可控的风险。 仿人机器人是一个伟大的技术愿景,但实现它需要比光鲜的视频短片更多的基础研究、更稳健的工程设计和更谨慎的伦理与安全审查。那些真正理解触觉、物理交互和现实世界复杂性的团队,才有可能在未来把"像人一样工作的机器人"这一宏大承诺,逐步变成可以被人们信赖并广泛采纳的现实工具。 。