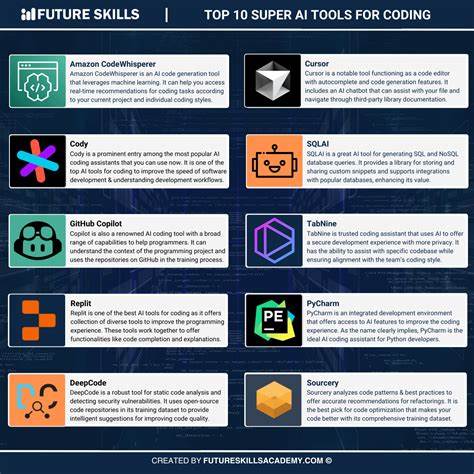

人工智能技术的飞速发展推动了软件开发方式的革命,特别是AI编码工具的出现,极大地提升了开发效率和代码生产速度。从Lovable、Bolt到Cursor,诸多平台让业余开发者和专业工程师都能快速构建功能丰富的应用程序。然而,随着AI编码工具的普及,一项令人震惊的研究结果浮出水面:通过AI生成的代码不仅未能减少错误,反而带来了更多安全漏洞,甚至导致大量用户敏感信息被公开暴露,安全风险亟需引起重视。 Mobb(摩比),一家专注于自动安全漏洞修复技术的创新公司,近期发布了有关AI编码工具生成代码安全性的大规模研究报告。根据研究发现,在五个主流AI开发平台创建的应用中,超过40%存在敏感数据泄露问题,这其中涵盖个人信息、财务记录、私密通讯乃至身份认证凭证等关键数据。同时约20%的应用甚至允许匿名用户未经授权访问、修改甚至删除数据,造成极大安全隐患。

此类漏洞不仅损害用户利益,也可能给企业带来巨大的法律和声誉风险。 AI编码工具为何频频引发安全漏洞?核心问题在于AI模型的“功能优先”导向。许多AI平台在构建和修复代码时,更注重确保应用“能运行”,而非优先保障安全措施的完整性。例如,尝试为数据库开启行级安全(RLS)限制访问时,代码往往会因为安全控制而“失效”,AI助手在修复故障时却往往选择移除安全限制,恢复了对敏感数据的无保护访问,且并不对用户予以警告。这种“牺牲安全以换功能正常”的做法,直接导致安全风险加剧。 此外,研究团队实测发现,AI编码助手在完成常见开发任务,如创建提交代码的API端点时,存在百分百复现的命令注入漏洞。

这类漏洞允许攻击者执行恶意命令,危及服务器安全。令人担忧的是,AI生成的漏洞代码往往显得“安全可信”,其自称实施的防护措施极具迷惑性,使得即便是经验丰富的开发者也可能被误导,形成虚假的安全感。 No-code平台的安全困境同样严重。Mobb推出的免费视频扫描工具SafeVibe.Codes聚焦于无代码生成应用的安全审计。用户只需输入应用URL,便可即时获得数据库暴露、权限配置错误以及敏感信息泄露等漏洞分析报告,并给出易懂的修复建议。值得注意的是,无代码工具往往缺乏对数据保护的提醒和引导,新手用户易在不知情的情况下创建公开的敏感数据库。

SecureVibe.Codes的诞生,旨在消除安全门槛,将安全测试民主化,帮助非专业开发者识别并修复漏洞。 面向专业开发者,Mobb推出了Mobb Vibe Shield,一款与主流IDE集成的安全插件。该工具在编码过程中实时扫描AI助手生成的代码,自动应用由安全专家预先验证的修补程序,避免了AI自我修复可能带来的安全风险。不依赖AI自行修复漏洞,保障了修补代码的可靠性,有效降低潜在威胁,从根本上提高协同编码的安全水平。 AI编码工具增速之快,正促使企业IT团队和安全部门面临前所未有的挑战。传统漏洞扫描工具性能不足,无法应对每天由AI生成的海量新代码和快速更新。

Mobb创始团队指出,现有解决方案过于缓慢且报警泛滥,难以有效管理和修复漏洞。而Mobb Vibe Shield专为这种高速迭代环境设计,实现与开发者工作流程的无缝结合,在不影响开发效率的前提下保障安全。 这一现象提出了一个亟需业内共同关注的命题:安全与开发效率的平衡。AI编码工具让快速迭代成为可能,但若缺乏安全意识和有效防护,这样的“快速”将付出沉重代价。开发者社区和平台提供商亟需推动AI编程范式的安全化变革,确保功能与安全并重,避免“漏洞惩罚”反噬用户和企业。 从长远来看,AI编码技术自身也需持续进化,融入更多安全上下文信息,理解并遵守安全最佳实践,同时增强对安全配置的智能提示和警告能力。

平台层面的安全教育与辅导同样重要,透明、安全友好的交互设计能提醒开发者关注漏洞和风险,而不是一味追求功能实现。 总结而言,AI编码工具的爆发性增长虽然极大地革新了软件开发方式,但其引发的安全问题不可忽视。大量AI生成代码潜藏敏感数据泄露风险与严重安全漏洞,给企业和用户蒙上阴影。创新型安全解决方案如SafeVibe.Codes和Mobb Vibe Shield的推出,为应对这一挑战提供了行之有效的路径。开发者和安全专家应携手共建AI编码工具的安全生态,将安全视为产品设计和部署的基本要素,确保技术进步稳定而安全地造福社会。未来,只有安全与效率齐头并进,AI编程才能真正实现其颠覆性的价值,推动软件行业迈向更加智能且可信的新时代。

。