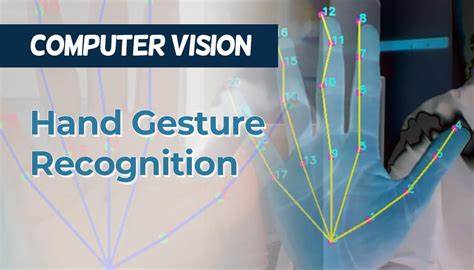

随着现代科技的快速发展,人机交互方式正在经历一场深刻变革。传统的鼠标和键盘操作逐渐暴露出限制,尤其在3D模型的查看和操作上,操作的直观性和效率亟需提升。近日,一项创新技术引起了广泛关注,即通过手势识别和语音控制来操纵3D模型。这种自然交互方式为空间操作提供了更高的灵活性和沉浸感,成为数字设计、游戏开发、教育培训等领域的潜力焦点。 手势控制技术的发展基础是计算机视觉和传感器技术的融合。从最早的基于硬件的手柄到如今依靠深度摄像头和人工智能算法识别复杂动作,手势控制的准确性和反应速度均有显著提升。

通过手势,人们可以如同在现实世界中操作物体般,旋转、缩放或者移动3D模型,极大增强了交互的直观性和效率。更重要的是,这种无触碰的操作方式符合当前无接触交互的趋势,尤其在公共场所和多人共享环境中具有重要意义。 与手势控制相辅相成的是语音识别技术的快速进步。借助自然语言处理和深度学习算法,系统能够准确理解用户的语音指令,实现对3D模型的更复杂操作,比如切换视角、触发动画效果或查询模型属性。语音交互降低了操作门槛,使非专业用户也能轻松掌握3D模型的操作,推动数字内容的普及与民主化。此外,结合语音和手势的复合交互模式进一步丰富了人与机器的沟通方式,提升了用户体验。

具体应用方面,建筑设计和工程领域是该技术的重要试验场。设计师能够通过自然的手势轻松调整建筑模型的结构细节,并借助语音指令快速切换不同设计方案,提高设计效率和客户沟通质量。教育行业亦受益匪浅,学习者通过互动式3D内容,以更直观和生动的方式掌握复杂概念,提升学习效果和兴趣。游戏和虚拟现实中,玩家可通过肢体动作和语音指令直接影响虚拟世界的变化,增加沉浸感和互动深度。 尽管前景广阔,手势和语音控制在3D模型操作领域仍面临诸多挑战。首先,环境光线变化、遮挡等因素对手势识别精度影响较大,需求更鲁棒的算法和传感设备。

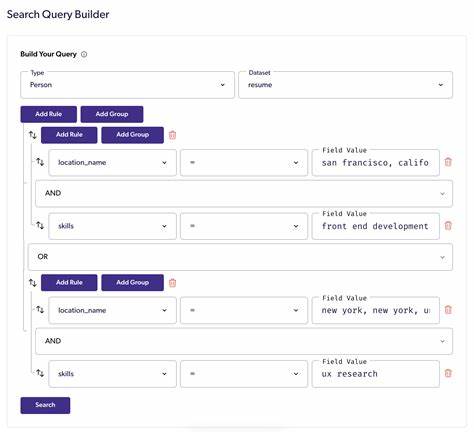

语音识别需要适应不同口音、语速及背景噪音,确保识别的准确性和响应速度。此外,多模态交互时如何协调手势与语音指令,避免冲突和误触成为研究重点。界面设计也需符合人体工程学原理,确保长时间使用的舒适性和健康性。 面对这些技术障碍,产业界和学术界正在积极合作。深度学习与神经网络技术为多模态识别带来了创新突破,实时处理能力的提升使交互更流畅。新型传感器如微波雷达、红外深度摄像头等的融合应用,进一步提升了环境适应性和识别精度。

与此同时,用户体验设计团队深入理解用户操作习惯,不断优化交互流程,使技术真正服务于用户需求。 未来,随着虚拟现实(VR)、增强现实(AR)和混合现实(MR)技术的成熟,基于手势和语音的3D模型控制技术将更加普及。智能家居、远程协作、医疗康复等多个领域都将受益于这种自然交互方式的引入。它不仅重塑了数字内容的创造和分享,还推动了人类与数字世界的融合,开启了更为便捷、智能的交互新时代。 总结来看,利用手势与语音控制3D模型技术代表了人机交互的一次重要飞跃。通过解除传统输入设备的束缚,实现更符合人类自然行为的操作方式,该技术为设计行业、教育培训、娱乐体验等多个领域带来了革新动力。

未来随着算法优化和硬件升级,其应用范围和性能必将进一步提升,为用户带来更加沉浸和智能的数字互动体验。持续关注和投身于这一领域的研究与应用,将有助于把握数字时代的创新机遇,推动技术进步与社会发展。