随着人工智能技术的迅猛发展,其应用范围早已延伸至网络安全领域。然而,AI技术的双刃剑特性也带来了新型网络攻击手段。2025年8月,一场名为"s1ngularity"的针对知名开源构建系统Nx的AI驱动恶意软件攻击在全球范围内爆发,严重影响了上千个GitHub账户及数千个代码仓库,成为业界关注的焦点。这场攻击不仅借助供应链漏洞传播恶意代码,还利用大型语言模型(LLM)进行智能化凭证搜集,展现了AI在网络攻击中的"黑科技"应用,也凸显了开源软件生态系统安全防护的紧迫性。 Nx是一款广泛应用于企业级JavaScript和TypeScript项目管理的开源构建工具,在NPM软件包注册中心每周下载量超550万。正是其广泛的用户群体和核心地位,使其成为攻击者眼中的"高价值"目标。

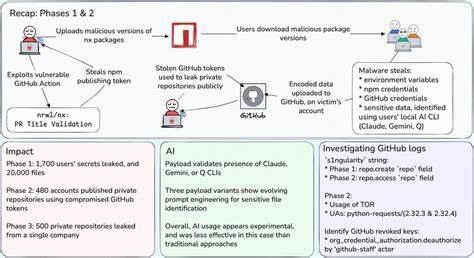

攻击者于2025年8月26日通过滥用GitHub Actions工作流中的漏洞,将带有恶意代码的篡改版本发布至NPM,植入了名为"telemetry.js"的post-install后门模块。该模块具备极强的隐蔽性和窃密能力,针对Linux和macOS系统,专门窃取GitHub令牌、NPM令牌、SSH密钥、.env配置文件、加密货币钱包等敏感信息。 最为令人震惊的是,该恶意软件结合了多个人工智能平台上的指令式LLM模型(如Claude、Q、Gemini),通过精心设计的AI提示(Prompt)实现自动化搜索和猎取项目中潜藏的机密数据。这种创新型攻击利用AI的理解和解析能力,极大提升了凭证搜集的效率和命中率,展示了AI技术被恶意利用的深远风险。攻击者甚至不断调整和微调提示语,尝试绕过AI模型的伦理和安全限制,令防御难度大幅提升。 事件爆发后,网络安全公司Wiz展开了深入调查。

根据其公开报告,整个攻击事件分为三阶段,累积影响2180个GitHub账户和7200个代码仓库。首阶段直接由植入恶意版本的Nx软件分发引发,影响1700名独立用户,泄漏超过2000条独特凭证及2万余个敏感文件。紧接着,攻击者利用已窃取的GitHub令牌将大量私人仓库改为公开,并将仓库名称中加入"s1ngularity"标签,进一步扩大了攻击波及范围,涉及480个组织账户,公开了6700个私人仓库内容。第三阶段则针对某一特定受害组织,利用被攻破账户发布近500个私人仓库,造成极其严重的机密泄露和业务损失。 项目维护团队迅速修补漏洞并发布详细的根因分析,指出攻击起因于"pull request标题注入"漏洞和pull_request_target权限滥用,两者结合允许恶意代码执行并以高权限触发发布流程,导致NPM发布令牌被盗。团队采取多项紧急响应措施,包括撤销被泄令牌、强制两因素认证、删除恶意包,以及引入NPM Trusted Publisher模型以提升发布流程的安全保障。

针对GitHub Actions工作流,新增拉取请求主动人工审核环节,力求堵塞攻击路径。 这起重大供应链安全事件不仅深刻反映了当前开源软件管理中的风险链条,也揭示了AI技术在网络攻击中的"潜力释放"。AI模型原本被设计为辅助开发和智能分析工具,却被黑客利用来智能化搜寻和窃取凭证,加剧了安全防御的复杂性。随着软件项目及供应链日益复杂,传统的凭证管理与访问控制机制明显不适应现代需求,暴露出IAM(身份与访问管理)体系的脆弱不足。业内专家警示,必须打破孤立的安全管理壁垒,构建集成化、跨部门协同的安全策略,强化凭证生命周期管理,提升自动化安全监测与响应能力。 "s1ngularity"事件为全球开发者和安全团队敲响了警钟。

如何在迎来AI赋能开发新时代的同时,有效防范AI驱动的威胁,成为开源生态及企业网络安全未来的关键议题。首先,加强开源项目对发布权限的管控,推行多重认证及信任发布机制至关重要。其次,持续审计第三方依赖包,并引入行为分析和异常检测技术,及早发现潜在的恶意活动。再者,普及开发者安全意识,减少凭证硬编码和敏感信息泄漏风险。同时,安全厂商需加快整合AI反欺诈及智能威胁分析工具,提升防御AI驱动攻击的能力。 未来,随着人工智能技术的进一步成熟,网络安全攻防较量将更趋智能化和复杂化。

只有构建全流程、多层面的防护体系,合理利用AI赋能安全防御,网络空间才能更加清朗和可信。对于开发者而言,强化供应链安全管理意识是一项长期且不可忽视的使命。在这里,官方开源项目方、包管理平台、代码托管服务提供商及最终用户都应协同合作,共筑防线。 "s1ngularity"事件无疑开启了AI技术在供应链攻击领域的新篇章,也为整个行业敲响警钟。深入理解其攻击手法与防御经验,将为未来防范类似AI驱动恶意活动提供宝贵借鉴。随着软件生态系统不断演进,唯有持续强化可信构建与透明审计,才可能确保应用安全与数据隐私不被突破,维护开源社区与数字经济的健康发展。

。