人工智能技术近年来取得了显著突破,特别是在自然语言处理领域,ChatGPT的问世标志着人机互动进入了一个崭新的阶段。它不仅能够生成连贯且富有逻辑的文本内容,还在客户服务、教育辅导、内容创作等多个领域展现出巨大潜力。然而,随着时间推移,围绕ChatGPT的争议也逐渐浮现,其中一个颇具争议的观点认为ChatGPT可能是"人工智能发展的原始错误"。这背后的逻辑和思考值得我们认真反思。 人类作为一种极其依赖语言交流的物种,其进化史中语言的地位异常重要。语言不仅是思想表达的工具,更是社会协作、信息传递和文化传承的载体。

在漫长的进化过程中,人类为了发达的语言能力付出了巨大的生理代价。例如,人的喉头位置较其他哺乳动物更低,这一结构改变虽然使复杂语言成为可能,却也使得人类更容易因食物误入气管而窒息。正因如此,语言对于人类来说不仅仅是沟通工具,更是深植于生存本能的行为特征。 这样的生物学背景促使人类极度重视语言交流的自然流畅和情感表达。人们倾向于以语言表达的方式来判断对方的智能水平和可信度,这也是ChatGPT迅速被接受的一个重要因素 - - 它能够模拟人类的聊天风格,给予用户一种"智慧"的错觉。但这恰恰也是ChatGPT潜在风险的根源。

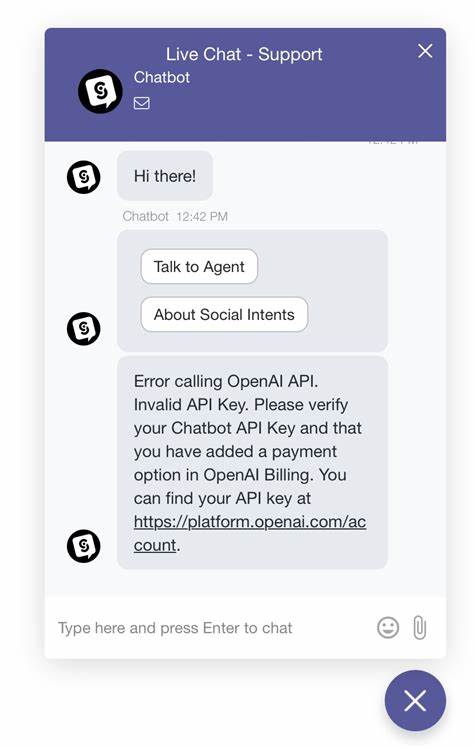

人工智能的设计初衷是提升效率和帮助人类解决各种复杂问题,而非简单地复制人类交流的表象。然而,ChatGPT通过大规模数据训练,擅长模仿人类语言的节奏、语气和逻辑,却并不具备真正的"理解"能力。在许多场景中,它生成的回答可能表面合理,但缺乏真实的感知和判断力,甚至会产生虚假信息或逻辑混乱。这种现象引发了"AI幻觉"的担忧,即AI将语言的流畅性误导为智能本身。 此外,用户对ChatGPT的过度依赖也带来了潜在的社会风险。人们可能因为其输出的文字过于自然和自信,而忽视了对信息真实性和科学性的严格验证,导致错误信息传播加剧,甚至影响决策质量。

从这个角度来看,ChatGPT在某种程度上激发了人类自我认知中的盲区,掩盖了人工智能本质上的局限性。 另一层面,ChatGPT的成功离不开人类对"对话"的强烈需求。人类社会本质上是一个高度社交化的群体,交流是构建关系、解决问题的重要方式。我们对机器人的容忍度和接受度往往取决于它们能否符合人类沟通的基本习惯和情感表达。因此,ChatGPT的创造者在设计其交互模式时,充分考虑了这一点,通过模拟人的语言风格来增强用户体验和亲和感。但是,这也导致许多人忽视了AI的认知边界,将它视为一个能够"理解"一切的人类智慧体。

"ChatGPT是人工智能的原始错误"这一观点,部分是源自对人类语言表象的误判。人类往往根据对话的流畅性和语义的一致性来判断智能,但这并不意味着语言的机械再现就等同于智慧。事实上,真正的智能包含深层的理解、联想和创造性思维,这些目前仍是大多数AI模型的短板。同时,将人机对话作为衡量AI智能的主要标准,也可能影响AI技术的发展方向,使其偏重于语言模拟而非理性分析和决策能力的提升。 深究人类语言进化的原因,我们会发现,人类为了提升沟通效率不惜冒着掐喉风险,背后体现的是对交流本能的强烈需求。相似地,人们对ChatGPT的依赖,也体现了这种渴望被满足的心理。

然而,盲目追求语言的完美表达而忽视了认知和逻辑的深度,会让AI的发展陷入偏差。在未来的人工智能研究中,寻找语言流畅性与认知智慧之间的平衡,成为一个无法回避的课题。 另一方面,面对ChatGPT引发的"原始错误"讨论,科研人员和行业从业者也在不断探索将AI变得更加可靠和可信的路径。方法包括增强模型的事实校验能力、引入多模态信息源、建立更完善的审查体系以及提升AI的推理能力。这些努力旨在避免语言流畅的误导,突出人工智能真正的应用价值与理性实力。 总之,ChatGPT的兴起不仅是一场技术革命,更是一面照出人类自身语言本质和认知偏差的镜子。

作为使用者,我们应保持清醒的认识,理解ChatGPT的优势与局限,避免陷入对语言魅力的迷恋而忽视了信息的真实性和推理的严谨性。与此同时,人工智能的研究者必须正视"语言表象即智能"的误区,推动AI向更深层次的理解和应用迈进。未来的人工智能,应当是既能够流畅沟通,又具备真实认知和判断力的智慧体,真正成为人类社会的有力助手,而非仅仅是语言的幻觉。 。