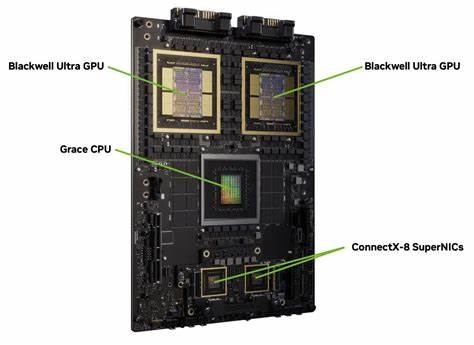

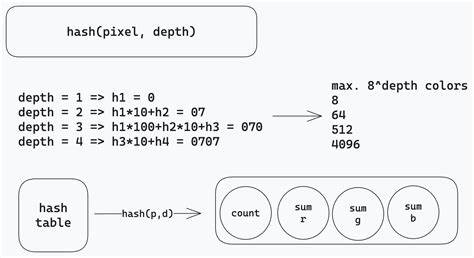

随着人工智能技术的飞速发展,模型规模和复杂度不断提升,AI推理面临着计算资源瓶颈和功耗限制的双重挑战。为应对这一趋势,NVIDIA最新推出的Blackwell GPU架构带来了对NVFP4全新4位浮点推理格式的原生支持,有效解决了传统量化过程中精度损失与推理性能的矛盾,推动AI推理进入高效节能的新时代。推理优化一直是AI开发者关注的重点,模型压缩技术如量化、蒸馏、剪枝等层出不穷,量化尤为广泛应用。传统FP32精度向低位深转换时,模型准确度往往会出现明显下降,特别是在切换到最新的FP4格式时难度更大。NVIDIA Blackwell架构的核心优势在于它支持从FP64到FP4的多级精度格式,涵盖FP32、TF32、FP16、BF16、INT8、FP8、FP6等,尤其突出了对NVFP4的硬件加速支持,极大提升了4位浮点操作的实用性和准确性。NVFP4是一种革命性的4位浮点格式,采用与传统E2M1类似的结构,包含1位符号位、2位指数位和1位尾数位,数值范围约为-6至6。

其差异化优势在于配备了两级微块比例缩放:每16个值为单位的FP8(E4M3)高精度缩放因子,以及每个张量对应的FP32二级缩放因子。这种设计消除了低精度浮点数表示的动态范围限制,使得量化误差显著降低。相较于其他4位浮点格式如FP4和MXFP4,NVFP4以更小的微块规模(16值块对比32值块)实现更细粒度的量化适配,因而能够更精确地匹配局部动态范围的数值变化,有效保留在权重和激活中的细微信息。这不仅提高了模型推理准确度,也减少了内存和计算开销。NVFP4的两级缩放策略尤为关键。一级缩放因子采用了FP8中的E4M3格式,其支持非2的幂的分数缩放,带来更灵活和精确的数值编码。

二级缩放则在张量级别用FP32浮点数调整整体分布,从而补偿FP8缩放因子有效范围较小的缺陷。通过这种分层缩放体系,NVFP4在保持较低位深的同时,最大限度降低了均方误差,对比传统的E8M0幂次缩放方案,量化误差降低至0.08的平均水平,显著提升了整体推理质量和模型智能保留。Blackwell GPU内部的第五代Tensor Core架构能够自动管理NVFP4格式的微缩放计算,包括分组元素、动态缩放及4位矩阵乘积操作,无需额外软件复杂度,为开发者释放出极大的优化潜力。NVFP4相较于先前FP8格式,在内存占用和计算效率上也展现出卓越优势。其单个4位值加上每16个值一个FP8缩放因子的存储开销总计约4.5位,加上每个张量一个FP32级别的二级缩放,整体模型内存需求同比FP16降约3.5倍,较FP8降低约1.8倍。这种压缩能力允许更大规模的模型部署于有限的GPU内存空间,尤其契合当下大型语言模型和多模态模型推理的存储需求。

同时4位运算相比8位及以上的数据类型不仅降低了带宽压力,也在计算能耗上带来了显著节约。Blackwell和Blackwell Ultra芯片上集成了液冷与FP4支持技术,实现了单令牌推理能效较上一代H100 Tensor Core提升高达25倍至50倍,为可持续AI计算奠定了硬件基础。从推理性能角度看,NVFP4通过保留接近FP8量化精度,确保模型关键指标如语言理解能力、任务准确度最大程度保留。以DeepSeek-R1-0528模型为例,通过后训练量化技术从FP8转至NVFP4后的准确率仅降低1%以内,而在AIME 2024基准测试中,NVFP4甚至较FP8提升了2%的表现。如此优异的结果打破了低位深推理“精度牺牲大”的传统认知,为AI推理开发者提供了新的高效精度平衡方案。针对开发者的生态环境方面,NVIDIA相应推出了完善的工具链支持,包括TensorRT Model Optimizer和LLM Compressor,使得量化至NVFP4更为便捷。

量化技术已涵盖后训练量化(PTQ)、量化感知训练(QAT)等多种手段,且量化后的模型可导出为统一的Hugging Face Checkpoint格式,方便在TensorRT-LLM、vLLM等推理框架中部署。业界领先的开源社区也积极拥抱这一标准,多款热门模型如Llama 3、DeepSeek-R1-0528、FLUX.1-dev均已提供NVFP4预量化版本,推动实际应用落地。展望未来,NVFP4将成为AI推理领域的重要基础设施,持续为模型训练和推理带来更高的能效与性价比。随着芯片技术、软件框架以及生态系统不断完善和协同,4位高精度推理将促使更多复杂、实时和大规模AI应用实现高效运行。从智能推荐、自然语言理解到多模态感知,NVFP4为开发者开启了低功耗、高性能的无限可能。综上所述,NVIDIA Blackwell架构对NVFP4的原生支持标志着低精度浮点推理技术取得了重大突破。

其创新的两级微块比例缩放、FP8高精度缩放因子以及细粒度16值微块设计,有效解决了传统FP4量化带来的精度下降难题。在推理性能、内存压缩和能耗效率上均达到行业领先水平,助力AI应用开发迈向绿色智能新时代。未来,随着更多开发者和企业将NVFP4融入推理流水线,AI推理的能力与规模将呈指数级增长,推动智能时代快速到来。