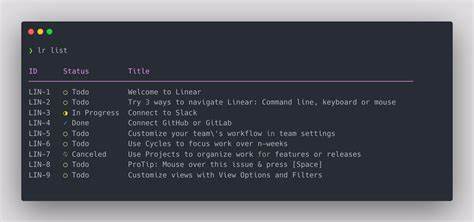

随着人工智能技术的迅猛发展,大规模语言模型(LLMs)在自然语言处理、编程辅助、知识问答等领域展现出强大能力。然而,要实现与这些AI模型的便捷交互,传统的图形界面软件并不总能满足专业用户和开发者的高效需求。Perspt应运而生,作为一款专注于终端环境的快速AI聊天界面应用,凭借其高性能、跨平台、多模型支持以及灵活配置,成为当前AI爱好者与技术人员值得关注的利器。 Perspt(Personal Spectrum Pertaining Thoughts的缩写,意为“个人思维光谱”)由Rust语言开发,强调速度和稳定性,利用genai开源库实现了对多家主流AI服务提供商的统一接入。它支持OpenAI、Anthropic、Google Gemini、Groq、Cohere、XAI、DeepSeek甚至本地模型平台Ollama等多种AI模型,使用户无需频繁切换环境,便能轻松调用最适合的模型资源。 其显著的特点之一是实时流式响应功能。

相比传统的逐条等待回复,Perspt采用智能分块处理与事件驱动架构,使得用户能在终端即时看到AI持续生成的信息流。这不仅提升了交互体验,也让推理复杂度高的模型能够流畅运行,助力快速调试与研究。 在界面表现方面,Perspt基于Ratatui构建现代化终端UI,支持彩色渲染、Markdown格式化以及流畅的动画效果,极大改善了命令行交互的视觉效果和可读性。此外,它还实现了键盘快捷键的全方位支持,包括输入提交流程管理、历史对话滚动、页面快速切换等功能,提升整体操作的流畅与直观。 使用Perspt无需复杂配置,仅需设置对应AI提供商的API密钥即可自动检测并启用相关模型。其智能优先级机制按照OpenAI、Anthropic、Google Gemini等顺序探测环境变量,大幅降低用户上手门槛。

同时,支持通过配置文件或者命令行参数精细调控,可满足多场景使用需求和个性化偏好。 值得一提的是,Perspt新增了“简单CLI模式”,提供极简命令行交互界面,适合脚本自动化、无障碍使用和轻量级查询场景。这一设计契合Unix哲学,支持流水线操作和日志记录,非常适合对性能和兼容性有高要求的开发者与运维人员。 在本地模型方面,Perspt兼容Ollama服务,支持在用户机器上独立部署和调用大语言模型。Ollama不仅免去云端API密钥的限制,还保障了数据隐私,满足对安全和成本敏感的用户需求。借助Perspt,使用者可以无缝切换本地和云端模型,灵活调整交互策略。

从技术架构来看,Perspt依托genai库实现模型统一访问和事件处理,具备完善的错误恢复机制和终端状态还原能力,确保应用在网络波动或异常情况下依然稳定运行。其内置的Markdown解析器针对流式文本做了深度优化,使得终端显示丰富且稳定,避免了传统终端渲染卡顿或格式错乱的问题。 项目配备了详尽的文档和开发指南,包含从环境配置、模型管理到发布流程的全面说明,支持多平台自动化构建与发布。GitHub Actions持续集成确保代码质量与多操作系统兼容性,方便社区贡献和扩展。 用户借助Perspt可以实现多种创新操作,比如实时多任务查询、对话内容自动保存导出、复杂对话历史回溯、不同模型间表现对比等。其丰富的命令支持例如/save导出聊天记录、--list-models查看可用模型、--simple-cli切换简洁模式,为用户带来极致灵活的交互体验。

总结来说,Perspt通过聚焦终端服务,结合现代Rust技术栈和强大的多模型支持,打造了一个轻量、高效、可扩展的AI聊天工具。它有效填补了专业用户对命令行环境中快速、可靠AI对话体验的需求,同时兼顾入门便捷性和高级配置空间,堪称新时代AI开发和体验的理想伴侣。未来,随着更多AI模型的加入及社区持续贡献,Perspt有望持续引领终端AI交互的创新潮流。对于追求速度、隐私及高度可控性的用户来说,Perspt是一款不容错过的选择。