在当今科技迅猛发展的时代,写作作为人类思想表达和信息传递的重要方式,依然扮演着不可替代的角色。尤其是在科学领域,写作不仅仅是记录研究成果的手段,更是推动思维演进、激发创新的关键过程。正如一句老话所说:“写作即思考”(Writing is thinking),通过将纷繁复杂的科学数据和研究洞见转化为条理清晰的文字,科学家能够更深入地理解其工作内容和意义,揭示出新的思路和观点。随着大型语言模型(Large Language Models,简称LLMs)技术的兴起,人工智能在协助甚至生成科学写作方面展现出前所未有的潜力。然而,这种技术带来的便利也引发了关于科学写作本质和科研诚信的深刻讨论。本文将深入探讨科学写作的价值、LLMs的角色及其局限性,强调人类原创写作的重要性和必要性。

科学写作的核心价值在于它不仅仅是传递信息的渠道,更是激发思考的工具。写作过程要求研究者将潜意识中散乱无序的思维梳理成逻辑清晰的文本,通过构建科学故事,明确研究的主旨和贡献。这种思维的结构化过程本身就是认知活动的深化,有助于提升分析力和创造力。科学研究是复杂且多维度的,写作提供了一个反复推敲、重组信息的平台,激励作者洞察全局,发现数据背后未被注意的联系,从而孕育新的假说和理论。人类手写文章甚至被发现能激活大脑的广泛联结,促进学习和记忆功能,这一现象从神经科学角度进一步证明了写作在认知发展中的积极作用。大型语言模型的出现,像ChatGPT、Bard等,给予了科学写作者强有力的辅助工具。

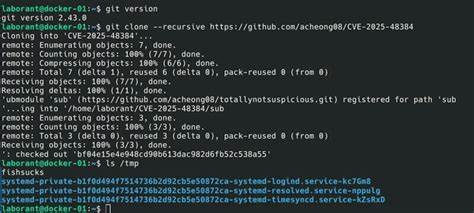

这些模型能够快速生成通顺流畅的文本,帮助改善语言表达,提高文章的可读性,特别对母语非英语的研究人员而言,这是一大福音。同时,LLMs可另辟蹊径,协助文献搜集、资料整合、关键词提炼,以节省文献综述和资料整理的时间。此外,LLMs能激发创作灵感,帮助作者突破写作障碍,提供多种表达方式或对复杂内容进行简明解释。这些应用拓宽了科学写作的边界,使得研究人员有更多时间专注于创新和实验设计。然而,目前LLMs在科学写作中的使用仍存在诸多限制。其生成的内容容易出现所谓的“幻觉”现象,即模型可能无中生有错误信息或捏造引用文献。

这样的错误在科学领域尤为致命,可能导致严重的误导和信息污染。编辑和核实一篇由LLM生成的文本往往比从零开始写作更费时费力,因为需要深入理解内容逻辑才能进行有效修订。此外,LLMs本质上缺乏责任感和原创思想,不能成为作者。他们的知识库依赖于训练数据,缺乏最新的研究洞见和批判性分析能力。因此,完全依赖机器生成的科学论文不仅不可取,也不符合学术伦理。对于科学界来说,继续坚持人类主导的科学写作尤为重要。

写作不仅是信息传递,它也是研究者自我反思和科学创新的重要环节。独立撰写文章的过程促进了科学家的批判性思维和深度理解,同时也是培养学术表达和沟通技巧的重要途径。科研伦理要求作者对所发表内容负全责,确保科学信息的准确性和可信度,这一点是任何人工智能无法代替的。未来,LLMs有望作为辅助工具,与研究者形成良性互动,为科学写作注入效率与创造力。但绝不能成为替代品,更不能成为逃避思考或责任的借口。依托专业的科学数据库训练的专用模型,或能减少内容错误率,提高专业性,这些进步值得期待。

科学写作体现了人类独特的思考和表达能力,是科学方法的有机组成部分。写作过程中的思维梳理、论点构建和数据诠释,都是科学创新不可或缺的环节。人工智能技术的引入是一把双刃剑,一方面提升写作效率,另一方面也带来诚信风险和思考缺失的隐忧。只有确保技术辅助与人类智慧结合,才能推动科学交流和知识传播的真正进步。写作不仅是传递知识的桥梁,更是思维的延伸和升华。未来的科研环境中,必须继续尊重和维护人类科学写作的核心地位,坚守学术诚信和创新精神,让写作真正成为思考和发现的新起点。

这样,科学才能不断积累可靠的知识,不断走向更深刻的认知境界。