近年来,人工智能领域的快速发展不断推动着科技与社会的变革,OpenAI作为行业的领军者,再次带来了重磅更新——全新发布的o3与o4-mini推理模型,为AI的智能化进程注入强劲动力。此次发布不仅提升了AI模型在各类复杂任务上的表现,更是首次实现了视觉信息的深入理解和自主调用各类工具的“代理式”能力,令人期待未来人工智能的更多可能性。 OpenAI的o3模型可以说是迄今为止最先进的推理模型,它通过“先思考再发言”的设计理念,花费更多时间来分析并处理用户的输入,确保输出内容的质量和深度远超以往版本。在多领域问答、数学计算、科学分析等任务中,o3展现出了强大且稳定的表现力。与此同时,o4-mini则强调轻量化与高效率,成为一个价格更低、速度更快的优秀选择,满足用户对成本与响应速度的不同需求。 值得一提的是,这两款模型均具备卓越的视觉理解能力,突破了传统文本处理的限制。

它们不仅能够看懂图片中的信息,更能将视觉内容纳入推理过程,进行多维度分析。即便面对模糊或低质量的图像,模型依然能准确识别并利用其中的关键信息。这对于医学影像分析、工业检测、科研资料解读等场景,具有极大实用价值。 除了提升视觉智能,o3与o4-mini更令人惊喜的是首次集成了对ChatGPT所有工具的自主调用能力。该功能使它们可以像人类一样灵活运用网络浏览、Python编程、图像生成、图像识别等多种工具,协同完成复杂多步骤的任务。举例来说,模型能够针对一份科学研究海报展开详细分析,结合互联网最新信息进行推断和结论生成,乃至调整放大图像细节以获得更精确的解读。

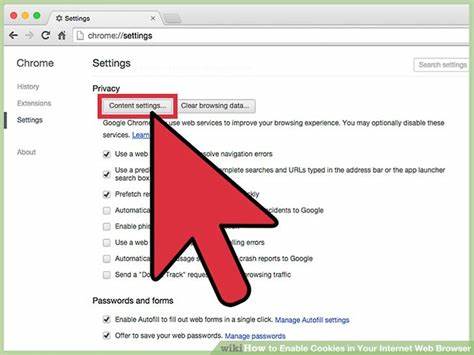

这种“代理式”操作模式标志着AI进入了真正能够自主执行任务的新阶段。 从实际用户体验看,o3和o4-mini在遵循指令和输出内容的可验证性方面也有显著提升。最新基准测试表明,这些模型即便不依赖额外工具,也能超越前几代产品的性能,输出更为准确、实用的答案。多方消息透露,未来这些推理模型或能跨领域综合知识,发起创新实验与研究,助力科学突破,尤其是在核裂变、病原检测等高难度科研领域潜力巨大。 如何体验和应用这些技术?目前,OpenAI向ChatGPT Plus、Pro及团队订阅用户开放了o3和o4-mini模型选择,用户可在模型列表中直接切换体验。同时,这些模型也通过API向开发者开放,支持更多自定义及集成场景。

Pro用户还将迎来o3-pro高阶版本,进一步强化性能表现。 为了保障用户安全,OpenAI对新模型进行了严格的安全压力测试,并发布了详尽的系统安全评估报告,体现其对模型可信性和安全性的高度重视。这一点为企业级应用和更广泛普及提供了信心保障。 此外,OpenAI同步推出了开源的Codex CLI工具。该工具可在用户本地终端中运行,方便开发者将AI推理模型与本地代码环境紧密衔接,提升编码自动化与效率。未来该工具还计划支持即将发布的GPT-4.1版本,扩展功能与兼容性更强,使AI辅助开发更为便捷。

值得关注的是,OpenAI还启动了一项总额达一百万美元的资助计划,鼓励和扶持早期创新项目,通过API积分的方式分发资助。这不仅体现了OpenAI支持创新生态的决心,也有望推动更多前沿AI技术及应用加速诞生。 综合来看,o3和o4-mini推理模型代表了OpenAI在AI智能化道路上的重要突破。它们不仅优化了模型的推理深度与响应效率,还在视觉智能及自主工具调用方面实现了质变。随着这些技术的商用推广,无论是科研机构、企业还是个人开发者,都将获得强大的智能助力,提升工作效率、激发创新潜能。 未来,随着技术的不断进步与生态建设的完善,集成多模态理解与自主代理执行的AI模型将进一步普及,成为各行各业数字化转型的核心驱动力。

OpenAI的新一代推理模型为此奠定了坚实基础,也为全球的AI发展注入了乐观的前景展望。我们有理由期待,在不远的将来,AI不仅是人类的助手,更将成为真正具备自主解决能力的智能合作者,共同推动社会进步与科技革新。