近年来,大型语言模型(LLM)因其卓越的自然语言处理能力和近似人类的对话表现,受到了广泛关注。尽管如此,智能代理系统中越来越多的应用需要完成的是重复性强、任务范围窄的专业化操作,这对模型的性能和资源消耗提出了不同的需求。在此背景下,小型语言模型(SLM)逐渐崭露头角,以其灵活、经济且高效的特点,成为智能代理领域的未来发展方向。小型语言模型不仅在计算资源消耗上远低于大型模型,其部署成本和响应速度方面也具备更强的竞争优势,这使得它们在对实时响应和边缘计算有较高要求的场景中表现出显著优势。智能代理系统的广泛应用场景涵盖了从智能客服、智能助理、自动化办公到机器人技术等多个领域。传统上,LLM因其强大的通用能力被广泛采用,但其庞大的运算需求和高昂的成本限制了大规模应用的可行性。

相比之下,SLM得益于其体量小、专业化定制能力强,能够满足任务特定需求,快速迭代且易于维护。SLM的适应性体现在多方面。首先,对于单一且重复的任务,它们可以通过细粒度调优实现性能最大化,大大提升自动化处理效率。其次,在多模型系统架构中,利用SLM处理基础性和简单任务,可以释放LLM的资源,为复杂推理和综合决策提供支持,从而实现系统整体性能与效率的优化。在当前经济环境下,企业和开发者面临着降低AI部署成本和提高系统响应速度的双重压力。SLM在降低显卡资源消耗、电力消耗及延迟方面具备天然优势,为智能代理技术的普及和可持续发展奠定基础。

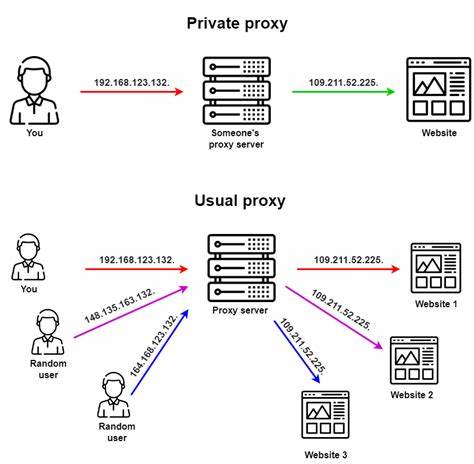

尤其是在需要本地推理的应用中,小型模型极大地降低了对云端依赖,提高了数据隐私性和安全性。尽管SLM在性能上存在一定局限,主要体现在通用对话能力和复杂推理任务上,异构模型协同策略成为解决这一难题的关键。通过构建由多个模型协同工作的智能代理系统,将SLM用于执行具体、专一的任务,而LLM则专注于生成和复杂分析,二者相辅相成,真正发挥各自优势,实现系统的高度灵活与智能。最近的研究进一步提出了将现有大型语言代理系统转换为基于SLM的方案,这种转换算法旨在降低模型规模同时保持必要的功能,帮助企业以更低的资金和技术门槛,完成向SLM驱动代理系统的过渡。此外,团队利用SLM进行快速专业化微调,有助于快速响应产品需求和市场变化,推动智能代理技术的敏捷开发。未来,随着硬件性能的提升和优化算法的发展,小型语言模型的表现将持续加强。

与之配套的软件架构和工具链的完善也将推动SLM在自动驾驶、智能制造、医疗健康等高精度场景中的应用,开拓更广泛的市场空间。智能代理不仅仅是技术堆砌,更是实现人与机器高效协作的重要桥梁。小型语言模型以其经济高效和灵活适应性,推动智能代理从实验室走向现实,使得智能系统能够更贴近用户需求、响应更及时。展望未来,倡导开发者关注小型语言模型的研究和实践,鼓励更多基于SLM的智能代理系统落地,将促进整个AI生态体系的良性发展。产业界与学术界通过公开讨论和协作,加速小型语言模型相关技术的成熟与应用创新,共同推动智能代理AI进入新的发展阶段。 。