在数学与计算科学交汇的边缘,质数既是最古老的研究对象之一,也是最具现代挑战性的谜题之一。传统数论以严格证明与解析手段为主,而随着数据驱动方法的发展,机器学习逐渐成为一种补充性的实验工具。用机器可学习性衡量序列的"有序性"是一种新颖思路:通过训练模型识别序列中潜在模式,衡量模型在不同区域或尺度上的表现差异,从而推断这些区域相对于随机性的偏离程度。最近针对乌拉姆螺旋上不同数域块的研究表明,图像化的机器学习模型能以可测量的方式区分质数分布在不同量级上的可学习性差异,从而为数论提供新的实证视角。乌拉姆螺旋是将自然数按螺旋状排列并标记质数的一种视觉化方式。自发现以来,乌拉姆螺旋就以其显现的对角线和簇状结构吸引了研究者的注意。

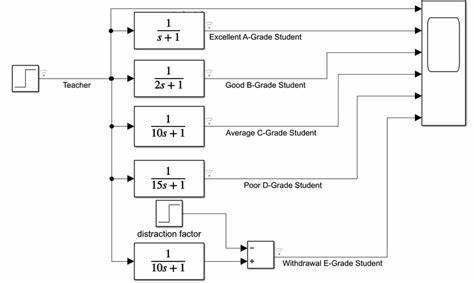

这些图像提供了直观的空间模式,有利于将数论问题转化为计算机视觉问题。研究者将乌拉姆螺旋切分为许多小块,把每个块当作二值图像:质数为1,合数为0。随后使用卷积神经网络等图像模型进行训练,任务可以是二分类(质数与合数)或预测某一区域内质数的分布。模型在不同数值量级区域上的表现差异,被视为该区域"可学习性"的度量。若某一区域的模型准确率显著高于另一区域,便可解释为前者在视觉上或结构上更接近有序,而后者则更接近局部随机性。基于此思路的实证结果呈现出有趣的双重性:质数的定义完全决定性,但局部分布在许多方面呈现随机样式。

经典结果如素数定理告诉我们,当x趋向无穷大时,质数的平均密度约为1 / log x,且在模m算术进制中的分布在很多情况下趋于均匀(在适当的条件下)。这些统计性质意味着在大尺度上质数具有可预测的平均行为,但在小尺度上的个别位置仍难以预测。通过机器学习视角观察,研究者发现模型在表示较大整数范围的乌拉姆螺旋区域上往往表现更好。这一现象看似违反直觉,但可从统计与表示学习的角度解释。较大的数域内,局部噪声被整体平均效应弱化,质数的密度与统计规律更为稳定,因此视觉特征更一致,有助于卷积网络学习到稳定的滤波器与局部模式。相对地,在较小整数范围内,局部波动更显著,个别结构的随机性更容易迷惑模型,使得模型更难建立普适的判别特征。

更精细的指标分解 - - 例如精确率与召回率 - - 还揭示了模型在不同区域采取的不同策略。在低数域,模型倾向于更强调识别质数的正样本特征,换言之提高召回率以捕获尽可能多的质数;在高数域,模型则更倾向于减少误判合数为质数,以提高精确率。这种策略差异反映了训练数据中正负样本比、局部密度与噪声特性对模型学习目标的影响,同时也映射出数论中"平均行为"与"局部异常"的张力。将机器学习作为数论的实验工具带来了若干重要启示。首先,模型并非在发现新的严格证明,而是在为研究者提供数据驱动的观测和猜想。模型表现优异的区域提示了潜在的可解释统计规律,值得用传统分析工具进一步验证。

其次,机器学习可以辅助寻找罕见但结构化的子集,比如对密码学敏感的强素数或具有特定性质的素数簇。通过训练分类器识别这些模式,研究者可以更高效地筛选候选实例,或评估某些构造在实践中是否存在易学性风险。尽管前景诱人,但这一路径也伴随显著限制与风险。模型表现的提升可能源自数据预处理或图像化方法引入的人工特征,而非真实的数学规律。例如,数值编码方式、窗口尺寸、边界处理和数据增强策略都可能影响模型学习到的偏好。若不慎,模型仅是在利用这些人为构造的模式,从而给出误导性的结论。

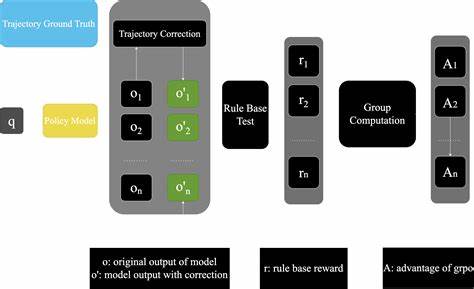

因此在实验设计时必须严谨控制变量,进行对照试验,并用统计假设检验评估结果显著性。可解释性技术在此类研究中非常关键。通过可视化卷积滤波器响应、梯度引导的显著图或特征反演,可以观察模型究竟关注图像中的哪些结构。若模型主要响应于明显的对角线簇、长连续链或特定距离的交替模式,这些发现可以被转化为具体的数论问题,便于理论家进行证明或反驳。此外,跨域泛化能力是检验模型发现是否真含数学内涵的重要手段。若在某一数域上训练的模型能对不同量级或不同排列方式(如替代的螺旋映射)保持良好性能,则更可能表明模型捕获了超越单一区域的普适规律。

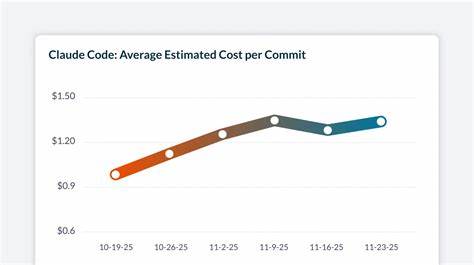

从方法论角度看,研究可以沿多条路径扩展。可以引入更丰富的模型架构,例如自注意力机制或图神经网络,以捕捉超越局部卷积的长程依赖。可以设计生成性模型来模拟"理想化"质数分布与替代随机过程,从而比较可学习性的差异并进行假设检验。可以借鉴统计物理中衡量有序性的工具,结合机器学习指标形成多尺度的复杂性谱。在密码学层面,机器学习度量揭示的可学习性差异具有实际意义。许多公钥密码方案依赖质数的某些难以预测性质。

若机器学习能系统性地识别出某类素数或预测素数的某些局部特征,那么这些发现可能提示需要调整密钥生成策略以避免可学习弱点。需要强调的是,任何机器学习发现都应经过严格的数学分析与安全评估,不能仅凭实验表现调整密码参数。为推动该领域走向成熟,建议建立标准化的数据集与评估协议。将乌拉姆螺旋的不同映射、不同尺度与不同编码方式纳入基准,可以减少因实验设置差异导致的互不兼容结论。公开代码与模型权重有助于复现与交叉验证。长期来看,将机器学习与解析数论相结合可能形成良性循环。

机器学习提出可观测的猜想,解析工具或数值理论检验这些猜想,反过来为机器学习提供更精确的目标与约束,从而提升模型的解释力。通过这种互补路径,既能保持数学证明的严谨性,也能利用数据驱动方法发现难以直觉察觉的模式。总而言之,用机器可学习性衡量非周期序列中的有序性为数论与机器学习搭建了新的桥梁。乌拉姆螺旋上的实验只是开始,它揭示了质数分布在不同量级上可学习性的差异,并提示在尺度变换之后某些统计规律更易被模型捕捉。这一方法既能为理论研究提供新线索,也能为应用领域如密码学提供风险评估的新工具。未来工作的关键在于加强实验设计的可靠性、提升模型可解释性以及将机器发现转化为可验证的数学陈述,从而真正把机器学习变成一种可依赖的"实验仪器"为数论探索服务。

。