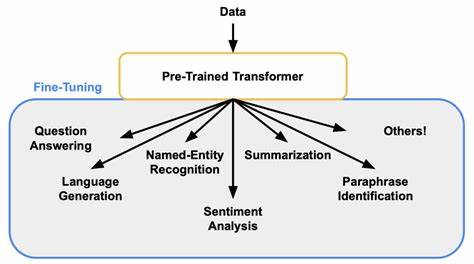

随着人工智能的发展,Transformer架构的大型语言模型在自然语言处理领域掀起了革命性的变革。传统上,提升模型性能的常用方法是监督微调(Supervised Fine-Tuning,简称SFT),即通过对基础模型进行额外训练以优化其特定任务表现。然而,监督微调的过程极为耗费计算资源,尤其随着模型规模的扩大,这一挑战更加突出。近期的研究发现,推理时技术,尤其是上下文学习(In-Context Learning,简称ICL),可以在无需修改模型参数的前提下,近似实现微调后的能力,从而为大规模语言模型的应用开辟了新的路径。本文将全面阐述推理时技术对微调Transformer模型潜力的激发机制,分析其理论基础以及实际应用中的可能性与限制。Transformer模型以其强大的表达能力和灵活的架构设计,已经成为现代自然语言处理的基石。

其理论上具备图灵完备性,即能够模拟任何计算过程。这意味着,采用合适的输入设计策略,基础Transformer模型本身可以通过推理过程实现类似微调后模型的功能。具体而言,上下文学习通过在输入中插入相关示例,使模型能够根据上下文捕捉任务模式并执行相应推断,从而模拟出微调后的行为。最初,这种方法被视为一种临时且不够精准的替代方案,但近年来理论研究和实验验证显示,它在某些条件下具有近乎等效的效果。理论层面,研究证明在理想化的假设下,如计算资源不受限制且可以访问完整的微调数据集,推理时技术能够以可控的误差范围逼近微调模型的表现。对于文本生成等任务,所需的数据集规模与输出文本长度、词汇表大小等因素有关,这些参数共同决定了达到期望精度所需的上下文信息数量。

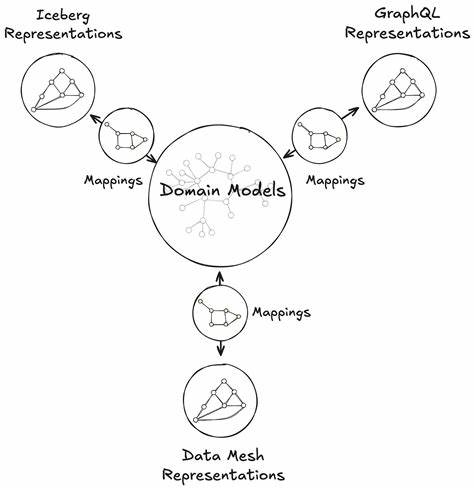

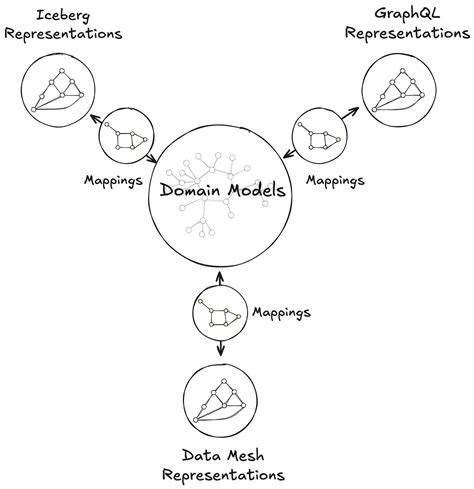

同样,对于线性分类任务,输入维度和误差容忍度也影响所需样本规模。这些理论成果为基于推理的微调逼近提供了坚实的数学支撑,揭示了向无参数更新优化方向发展的可能性。尽管在实际应用中,上述理想条件难以完全满足,现代技术的发展使得推理时技术仍然可行且实用。有限的上下文长度和对数据集的部分访问依然能够有效激发模型中隐藏的能力,尤其是结合检索增强生成技术(Retrieval-Augmented Generation,RAG),可以在推理过程中动态调用外部知识库,进一步提升模型性能并降低微调需求。这样的结合不仅显著节省了计算资源,还增强了模型对实时信息的敏感度和适应性。在工业界,推理时微调逼近技术极具潜力,尤其适合需要快速部署、定制化服务的场景。

企业可以通过设计高质量的上下文示例,灵活调整模型输出,免去重新训练的时间和资金成本。此外,减少对微调数据和计算设备的依赖,也提升了模型的可持续发展性和环保性。未来,推理时技术有望在多模态学习、交互式人工智能助手、智能问答系统等领域发挥更大作用。结合模型结构优化、上下文管理策略和知识库构建,研究者和工程师将不断挖掘Transformer模型内在潜能,实现更智能、更高效的人机交互体验。总之,推理时技术为激发基础Transformer模型能力提供了创新的视角和方法,不仅挑战了传统微调的必然性,也引领了大规模语言模型应用的新方向。通过理论与实际相结合的不断探索,可以预见未来人工智能系统在准确性、灵活性和资源利用率上的全面提升。

对于自然语言处理领域的研究者、开发者以及企业而言,深入理解和应用这一技术具备重要价值,将推动自然语言理解与生成迈向更高水平的智能化时代。