近年来,无人机竞速以其高速、精准和刺激性吸引了全球大量关注。作为既考验飞行员技术水平,又融合尖端科技的竞技项目,无人机竞速不仅推动了飞行器设计与控制技术的革新,也成为人工智能领域的重要应用场景。尤其是在2023年,瑞士苏黎世大学与英特尔联合推出的Swift系统标志着深度强化学习在实际无人机竞速中的里程碑式成就,实现了自主无人机首次在真实比赛中打败世界级人类冠军。Swift的诞生不仅打破了传统无人机自主竞速的技术瓶颈,也为移动机器人和机器智能领域树立了新标杆,预示着无人机技术未来的巨大潜能和应用广度。无人机竞速的特别挑战在于其高速动态环境下的感知与控制。竞速无人机以每小时超过100公里的速度穿越具有复杂空间结构的赛道,承受着自身重量数倍的加速度和强烈气动干扰。

人类飞行员凭借头戴式摄像头获得第一视角进行操控,通过视觉反馈和经验预判行进路线。要让计算机实现同等甚至超越人类的飞行水平,核心挑战在于无人机必须仅依赖机载传感器快速且准确地估计自身状态和位置,同时执行极限飞行动作,完成高难度转弯和加速,且拥有极低的操作延迟。Swift系统巧妙地融合了深度强化学习与物理传感模型。系统主要由两大模块组成:感知模块与控制政策。感知模块结合视觉惯性测量单元(VIO)与卷积神经网络的门架检测器,将高维图像和惯性数据转化为低维空间中的状态估计。通过卡尔曼滤波器将视觉测量与惯性导航融合,提升定位的稳定性与准确性。

控制政策则通过两层前馈神经网络,输入感知模块的状态输出,产生四维控制指令(集体推力和机体角速度),直接驱动飞行器动作。强化学习策略采用基于模型无关的近端策略优化(PPO)算法,在高度逼真的模拟环境中训练。训练过程中,系统通过奖励函数平衡飞行速度与视觉感知的稳定性,尤其鼓励无人机保持下一竞赛门架在摄像头视野中,以优化定位精度和飞行安全性。然而,模拟环境与现实天空之间不可避免存在感知误差和动力学差异,Swift采用了创新的数据驱动力学修正方法。团队先通过实际飞行采集传感数据和精确运动捕捉系统记录的真实状态,使用高斯过程和K近邻回归技术建模感知残差和动态残余,将这些经验模型嵌入模拟器,极大提升了策略的现实适应能力。随后在加入现实残差的增强模拟环境中对策略进行精细调优,实现了从模拟到现实的无缝迁移。

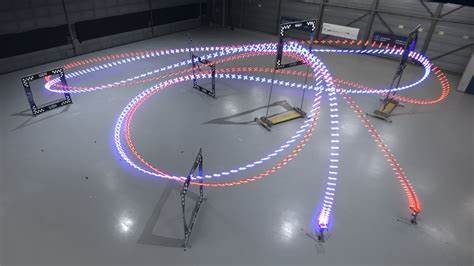

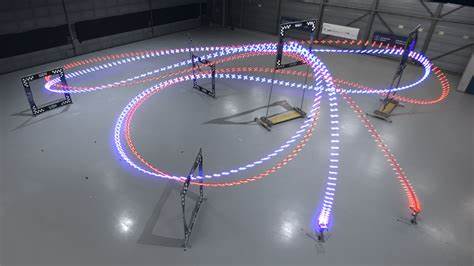

Swift系统所使用的硬件平台与专业人类飞行员相同,包括重约870克的四旋翼机架、具备35牛最大推力的高速马达、以及英特尔RealSense T265相机进行视觉惯性导航。计算采用英伟达Jetson TX2边缘GPU进行视觉模块推理,策略网络实时运行于CPU,保证了低延迟高速反应。人类飞行员佩戴的头显获得实时第一人称画面,实现沉浸式飞行体验。赛事场地由专业飞手设计,由七个连续排列的方形门架组成,轨迹长度75米,体积约30×30×8米。Swift与三位世界级人类冠军在真实环境中进行了多场对抗赛,取得了半数以上胜利,并刷新了赛道最快单圈记录。进一步分析表明,Swift在起飞反应时间和狭窄转弯处的表现尤为突出,其反应时间快于人类飞手约120毫秒。

其柔性轨迹规划能力借助强化学习优化了长期回报,使无人机能够做出更加紧凑的进弯路线和动力分配。人类飞行员更侧重保持下一门架在视野中心,而Swift则通过额外惯性提示和视觉里程计辅助实现部分盲区操作,提高了整体速度和效率。在时间试跑中,Swift表现出更稳定和持续的高速飞行,反映了自主策略对速度-风险权衡的持续优化。尽管目前Swift在环境变化适应和碰撞恢复方面仍有挑战,如对照明变化引起的视觉漂移敏感,且尚没有专门设计应对撞击后的飞行恢复机制,但其整体系统性和性能证明了深度强化学习结合数据驱动力学建模的巨大潜力。相比传统基于轨迹规划和模型预测控制(MPC)的方法,Swift更具鲁棒性,在感知噪声和动力学不确定性条件下仍能保持优异表现。人工智能在无人机竞速中的应用,恰如其分地展现了智能体在高速、动态、不确定环境中的决策与控制能力。

这不仅推动了AI算法的研究边界,更加速了移动机器人在实际复杂环境中的自主能力发展。未来,基于此类深度强化学习框架,更多高性能自主飞行机器人将能应用于运输、勘探、应急响应等领域,同时通过类竞技训练方式强化系统快速适应和优化能力。Swift的成功开启了无人自动竞技时代的新篇章,为全球机器人和人工智能研究者提供了宝贵范例。综上可见,2023年的Swift无人机竞速系统,以其创新的视觉惯性融合感知、深度强化学习策略与数据驱动残差建模,成功实现了人类冠军水平的自主飞行。这一成果展现了人工智能在现实物理环境极限挑战中的突破,奠定了未来无人机技术飞速发展的坚实基础,也激发了更多领域探索智能自主系统无限可能的热情。