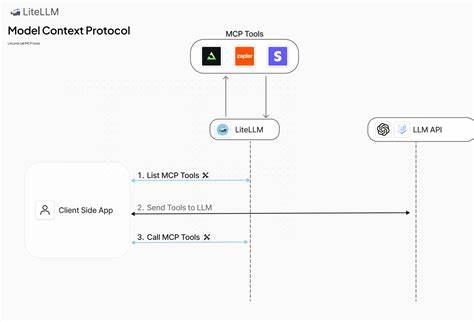

近年来,人工智能领域的突破不断推动音频技术的发展。语音识别、语音合成以及语音翻译等技术已经在多个行业中广泛应用,极大地改变了人们的沟通方式与信息获取途径。随着对低延迟、高准确率语音处理需求的提升,本地化音频模型逐渐成为研究和应用的热点。LiteLLM作为当前市场上一款备受瞩目的本地音频模型,展现出强大的潜力与广泛的应用前景。LiteLLM区别于传统的云端音频模型,它强调在设备端进行实时音频处理,极大降低了数据传输所带来的延迟和隐私风险。它通过对大规模语音数据的深度学习,能够精准识别和生成各种音频信息,从而实现自然流畅的语音交互体验。

LiteLLM采用先进的音频令牌(audio tokens)技术,这一创新使得模型能够直接对音频信号进行编码和解码,绕过了传统基于文字转录的中间步骤,极大提升了处理效率和响应速度。得益于这种设计,LiteLLM能够支持实时的语音到语音转换,适合构建低延迟的对话系统以及智能语音助手。另一个值得关注的特点是LiteLLM在跨模态能力上的表现。该模型不仅支持单一语音任务,还兼容多种音频输入输出形式,包括不同语言、多种音色以及背景噪声环境的动态适应。针对不同的使用场景,LiteLLM能够灵活调整模型参数,从而保证高质量的音频输出。在实际应用中,LiteLLM展现了卓越的适应性和扩展性。

例如在智能家居领域,搭载LiteLLM的设备能够即时响应用户指令,完成复杂的语音交互,且无需依赖云端支持,确保用户隐私安全。教育领域同样受益于此技术,通过实时语音翻译和口语评测,极大地提高远程学习的互动性和效率。商业通信领域则利用LiteLLM实现多语言会议的即时语音转写和翻译,使跨国沟通更加顺畅。从开发者角度而言,LiteLLM的一大优势是其开放且统一的接口设计。该模型支持Python等主流编程语言,配合简洁易用的API,使得集成和调用变得便捷。此设计不仅降低了开发门槛,也加速了各类应用的迭代速度。

伴随着开源社区的不断壮大,LiteLLM生态系统日益丰富,开发者能够共享模型权重、调优策略及定制化插件,形成一个活跃且高效的创新环境。安全性和隐私保护是当今音频技术关注的焦点。LiteLLM凭借本地化处理优势,最大限度减少敏感语音数据上传,从根本上降低数据泄露风险。同时,模型内部集成了多重加密算法与访问控制机制,保障语音信息的安全存储和传输。未来,随着计算力的提升和算法的进步,LiteLLM有望融合更多智能特性,例如情感识别、个性化语音合成以及环境声识别等,使其在更广泛的领域发挥影响力。此外,轻量化设计理念将持续优化,让模型更适配移动设备和边缘计算场景,推动物联网与人工智能的深度结合。

产业链各环节也将因LiteLLM而得到重塑。硬件制造商将加速研发支持本地语音计算的芯片,软件开发者将更多关注模型轻量化和多模态融合,应用层面则不断涌现出创新服务和商业模式。综合来看,LiteLLM不仅代表了音频模型技术的前沿趋势,更是智能交互时代的重要基石。它突破了传统的云端束缚,带来了更高效、更灵活、更安全的音频处理能力,助力打造真正智能、便捷的语音生态系统。随着各方的持续投入和技术演进,LiteLLM及其相关生态必将在未来数年内引领音频人工智能进入一个全新的高度。