近年来,人工智能技术正在彻底改变软件开发的方式。借助GitHub Copilot、ChatGPT等AI辅助工具,开发者能够以前所未有的速度编写代码,极大提升了开发效率。然而,与此同时,新技术的应用也带来了全新的安全风险和挑战。AI辅助代码虽然加快了软件迭代速度,却可能引入隐蔽的漏洞,若未被及时发现和修复,将对企业应用的安全性构成重大威胁。面对这种趋势,应用安全(AppSec)团队正积极调整测试策略,采用现代动态应用安全测试(DAST)技术,以适应AI驱动的开发模式,保障应用程序的安全运行。人工智能重塑了开发过程,开发者在编写代码时越来越依赖自动化工具,这种变化使得传统的安全审查需求和方法都发生了转变。

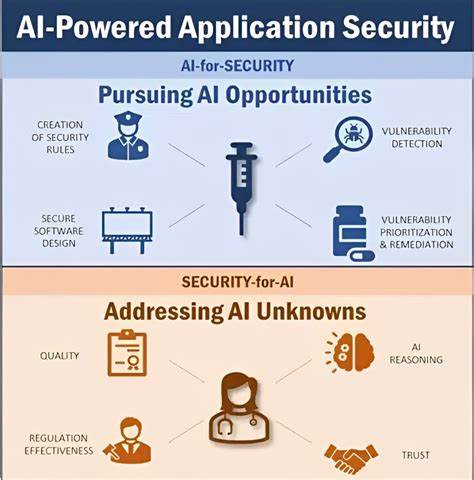

传统的静态代码分析(SAST)虽然仍有价值,但面对由AI生成或辅助生成的代码,其在识别复杂逻辑漏洞及运行时风险方面存在局限。因此,动态应用安全测试逐渐成为检测潜在安全威胁的核心手段。动态测试通过模拟真实攻击场景,在应用程序运行时进行漏洞扫描,覆盖更多复杂的安全威胁和漏洞链,从而大幅提高了安全检测的准确率和覆盖面。结合人工智能技术的动态应用安全测试工具更是显著提升了安全检测的效率和深度。例如,Escape等现代DAST工具能够智能识别和分析AI辅助写出的代码中可能存在的漏洞,及时发出安全警告,并辅助开发团队快速定位和修复漏洞,避免安全事件发生。通过应用这些工具,AppSec团队能够实现“AI护AI”——用智能技术测试和加固由AI写就的代码,形成一套闭环安全防护体系。

与此同时,行业内的安全专家和企业经验分享也为应对AI带来的安全挑战提供了宝贵参考。DoubleVerify、Applied Systems和PandaDoc等公司安全负责人在相关行业网络研讨会上共同探讨了他们面对AI辅助开发所采取的新策略。专家们强调,安全团队需要提前调整安全测试流程,强化自动化工具的集成,确保每次代码提交即刻接受全面的动态安全检测。此外,还需培养跨学科人才,既懂开发又精通安全,以适应快速发展的AI驱动环境。风险管理和前期漏洞预测也变得尤为重要。AI辅助开发带来的新型漏洞模式包括代码生成中的逻辑缺陷、依赖库的安全隐患以及复杂权限配置失误等。

及时识别这些风险不仅依赖先进的测试工具,还包括对开发流程的全面理解和对新兴威胁模式的持续监测。有效的AI驱动应用安全策略还应与持续集成/持续交付(CI/CD)流水线完美结合,实现安全检测与开发流程的无缝对接。通过在流水线中嵌入动态安全测试,一旦检测到风险,立即通知开发团队并阻断潜在风险代码进入生产环境,确保应用安全始终处于受控状态。此外,政策层面和组织文化的变革同样关键。企业应制定明确的AI辅助开发规范和安全治理政策,推动开发者安全意识提升,强化多部门协作,从而形成整体防御体系。面对未来,有专家预测,“AI与AI”对抗将成为常态,即利用AI技术自动发现和修复AI生成的代码漏洞。

这种智能化的安全检测和应对机制,有望进一步提高安全防护效率,减轻人力压力,打造高度自适应、自愈的安全体系。总结来看,AI技术深刻影响软件开发模式,带来了前所未有的安全挑战,但同时也催生了更先进的安全检测工具和策略。企业只有深入理解AI辅助开发带来的新风险,积极引入现代动态应用安全测试技术,配合成熟的安全管理流程,才能真正构筑起坚实的安全防线,保障AI驱动应用程序的稳定和可信赖运行。在数字化转型和智能化浪潮日益加速的今天,应用安全已不再是传统意义上的风险防控,更是企业创新与竞争的保障。通过科学的安全策略和技术投入,打造安全与效率兼顾的开发环境,将成为推动行业持续发展的关键因素。