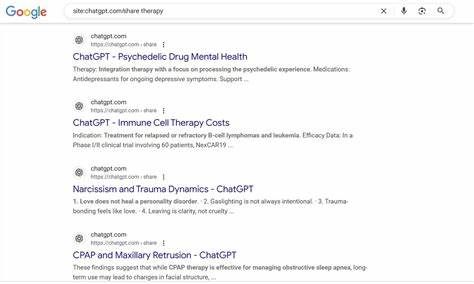

近年来,ChatGPT作为一种先进的人工智能对话工具,逐渐渗透进人们的日常生活和工作场景。其便捷的交互方式和强大的语言生成能力,使得用户能够在多种需求中获得即时且精准的帮助。从求职简历优化到科普知识查询,再到幽默调侃和虚拟聊天,ChatGPT广泛应用于教育、娱乐、职场等领域。然而,随着使用人数的激增,一项关于公开ChatGPT对话被谷歌及其他主流搜索引擎收录的现象浮出水面,引发了行业与公众的高度关注。公开显示的聊天记录竟能通过简单的检索暴露在世界的面前,超出了许多用户的预料和预期。为什么ChatGPT的公共查询链接会被搜索引擎索引?其背后又隐藏着怎样的技术逻辑和用户隐私风险?对普通用户和企业来说,又有哪些值得警惕的点?首先,需要明确的是,ChatGPT默认不会将用户的对话公开。

只有当用户点击“分享”按钮,主动生成公开链接,并选择是否允许该链接被搜索引擎发现时,聊天内容才会对外可见。这意味着公开链接的创建完全出于用户自愿和主动操作。然而问题在于,即使用户选择了公开分享链接,也未必能充分认识到搜索引擎会对这些内容进行抓取和索引。正如新闻报道所指出的,谷歌等搜索引擎基于网页爬虫技术,会自动扫描网络上的开放页面并存入其庞大的数据库中。这其中包括用户公开分享的ChatGPT对话链接。由于这些链接采用公开访问的URL格式,任何人通过搜索特定域名或关键词,都可能轻易访问到这些对话记录。

另一方面,搜索引擎本身并不控制信息是否应被开放,而是依赖网页发布者设置的权限。Google发言人曾强调,网页内容是否能被索引由内容发布者完全掌控,搜索引擎不先天干预。但在实践中,用户往往忽略了隐私设置的细节,导致敏感信息被意外曝光。诸如个人简历、求职细节甚至社交账户信息,有时会在公开对话中无意间披露,增加了个人信息泄露的风险。此外,有些用户因好奇或恶作剧心理,将一些带有攻击性或不当内容的对话链接发布到网络上,甚至形成全文被搜索的现象,带来网络暴露和舆论负面影响。这就反映了公众对人工智能工具与隐私保护关系理解的不足,对平台在开放与安全之间的平衡提出挑战。

值得关注的是,OpenAI在意识到这些风险后,迅速取消了将公开聊天链接自动纳入搜索引擎索引的实验功能,表示此次尝试过于冒进,容易使用户不慎泄露信息。官方表态用户的名字、自定义指令及共享之后的额外信息仍保持私密,进一步做好用户安全保障。尽管如此,此事对于人工智能行业和广大用户来说,都是一次重要的警示。用户在享受AI技术红利的同时,应增强安全意识,谨慎判断何时应将对话公开,避免透露可能被用作个人身份识别的详细信息。平台也应提供更明确的隐私提示与权限管理,避免复杂界面带来误操作。除此之外,这一事件也引发了更广泛的网络隐私和数据保护话题。

相似的情形曾发生在谷歌云盘文件公开设置上,由于“任何拥有链接的用户即可查看”权限存在,部分敏感文件曾被无意间收录进搜索结果,引发网络隐私风险。由此可见,随着云服务与在线分享盛行,数据的公开与保护成为前所未有的挑战,如何确保用户知情及方便管理权限,是所有平台运营者不可忽视的重点。回归到ChatGPT本身,除了用户端谨慎处理公开对话,OpenAI和相关企业从技术层面进一步完善隐私保护方案,设定更加严格的默认隐私参数,有助于构建更安全健康的人工智能生态。部分业内专家也建议引入人工智能生成内容的数字水印或标识机制,方便追踪及管理公开内容范围,提升透明度与安全性。此外,对AI使用者进行教育和普及隐私保护知识,也应成为推动行业健康发展的重要环节。此次事件还让我们看到,虽然人工智能技术日益智能,但其背后的伦理安全问题同样复杂且关键。

用户行为与平台政策相辅相成,任何一环出现疏漏,都可能导致潜在风险爆发。因此,建立合规透明、保护隐私的信息共享环境,是未来AI技术普及进程中的必由之路。总结来看,ChatGPT公开对话被搜索引擎收录事件为我们敲响了数据隐私的警钟。它提醒所有使用者在享用AI便利的同时,需要承担起保护个人信息的责任,不随意公开敏感内容。同时也督促平台加强功能设计与安全监管,避免不必要的隐私泄露。随着技术的不断演进,人工智能应用的伦理和法律框架也必将日趋完善。

只有全民提高风险意识,平台持续优化用户体验,AI生态才能稳健发展,真正赋能社会的数字未来。