苹果公司在2025年WWDC(全球开发者大会)上再次将焦点放在了其人工智能平台Apple Intelligence的深度升级上。尽管过去一年苹果的智能技术表现并未达到外界广泛期待,但此次大会中的多项创新功能展示,证明了苹果在人工智能领域并未停步,而是选择了稳扎稳打、强调体验与隐私并重的路线。本次发布不仅推动了iOS 26和macOS等操作系统的智能化进步,更揭示了苹果基于本地计算的AI模型逐步铺开的战略布局。 Apple Intelligence的最新更新围绕多个应用场景展开,其中Genmoji和Image Playground获得显著增强。Genmoji突破传统表情的单一组合限制,允许用户将两个Unicode表情符号融合,打造全新的个性化表达方式。这意味着用户能够借助创新的视觉符号表达更细腻复杂的情绪和想法,增加社交沟通的趣味性与多样性。

同时,Image Playground在图像生成工具方面加入了与ChatGPT的深度整合,使其不仅能生成多彩背景,也能通过ChatGPT提供独特风格和创意的图片内容,极大丰富了用户在Messages中定制聊天氛围的选择。 本地化的实时翻译功能成了此次更新中的另一亮点。Apple Intelligence的人工智能模型将嵌入Messages、FaceTime和电话应用中,实现多语言无缝转换。如用户在消息中输入文字,系统会自动翻译成对方偏好的语言,对方回复同样会被即时转译为用户母语,极大降低了跨语言沟通的障碍。在FaceTime通话时,屏幕上将同步显示实时字幕,方便用户理解对方发言内容;电话通话中则通过AI生成语音翻译,提升跨语种交流的流畅体验。这一系列“眼见即翻译”和“声声实时”功能,不仅创新了苹果语音交互体验,更为全球用户提供了触手可及的语言桥梁。

苹果也对Visual Intelligence进行了功能升级。此工具不仅可以通过iPhone摄像头扫描现实世界,还新增屏幕内容扫描能力,用户只需通过截图快捷键即可激活。整合了ChatGPT后,Visual Intelligence能够回答用户针对屏幕上内容的疑问,实现智能问答服务,帮助用户快速理解所见信息。除此之外,它还能在支持的应用中,如Google和Etsy,搜索与视觉内容匹配的图片或商品,极大方便在线购物或信息获取。比如当用户盯着某个事件信息时,系统会智能建议添加日历提醒,提高日常事务管理效率。所有这些提升体现了苹果希望通过视觉智能连接数字与现实的设计理念。

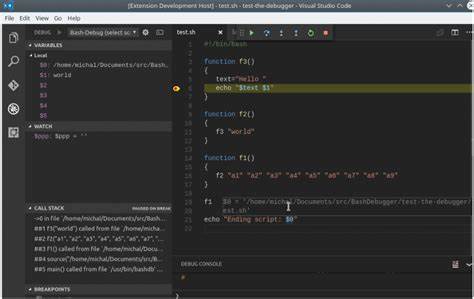

值得注意的是,苹果首次推出可供开发者使用的Foundation Models框架,支持基于其本地AI模型的应用开发。借助这一框架,开发者能够轻松构建无需联网即可运行的智能应用,既提高交互速度,也有效保障用户隐私。该框架全面支持苹果自家的Swift编程语言,简化了代码复杂度,开发者只需编写极少量代码即可集成AI功能。举例来说,教育类软件如Kahoot!或可利用该模型为学生个性化生成测验题,提倡高效且安全的学习体验。 新版Shortcuts(快捷指令)应用也紧贴人工智能发展趋势,扩展了Apple Intelligence的支持,使用户能在跨平台操作中融入智能响应。通过调用本地或私有云端模型,用户可自动完成各种复杂任务,例如对课堂录音文字稿与手写笔记的自动比对,为学习和工作流程注入更多智能元素。

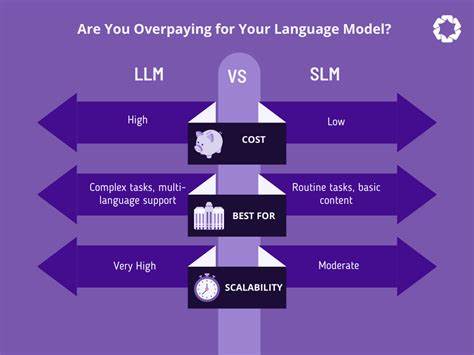

此外,借助ChatGPT的接入,用户能够获得更加丰富的支持和更人性化的定制服务。 苹果此次AI生态升级还伴随着一系列细节优化提升用户体验。苹果钱包应用新增自动汇总在线购物及快递物流信息功能,方便用户集中管理订单和配送动态,体现了人工智能赋能日常生活的实际价值。 回顾Apple Intelligence自WWDC 2024发布起的一年历程,虽然更智能更个性化的Siri助手推迟上市且面临用户质疑,但苹果依然坚持数据隐私优先,选择稳步改善产品服务的策略。此次WWDC 2025系列升级虽未见革命性突破,但通过加强实用性与细节打磨,保持了苹果AI生态的持续进化。与谷歌等竞争对手相比,苹果的AI布局更侧重本地计算与隐私保护,在智能应用场景的深度挖掘与数据安全间寻求平衡,这或将为其在未来市场赢得更多忠实用户和开发者青睐。

未来,苹果如何加速提升Apple Intelligence的识别准确度、内容生成质量及交互便捷性,将是业界及用户持续关注的焦点。同时随着设备性能提高与AI模型多样性扩展,苹果有望通过不断丰富智能功能生态,逐步增强生态系统的竞争力与用户黏性。Apple Intelligence的这次更新虽然仍处于发展中阶段,却为智能设备与服务的结合树立了新标杆,预示了苹果下一代智能交互时代的到来。