随着人工智能技术的快速发展,递归自我提升(recursive self-improvement)这一概念引发了学术界和产业界的广泛关注。它指的是人工智能系统能够自主增强自身能力,从而不断迭代并实现指数级的进步。然而,尽管这一前景引人入胜,但实际上,人工智能可能难以真正实现递归自我提升。本文将继续深入分析阻碍递归自我提升的核心因素,以及可能的应对策略和未来展望。 首先,技术复杂性是限制递归自我提升的重要障碍。递归自我提升要求人工智能不仅能够理解自身的结构和算法,还要具有设计和修改自身的能力。

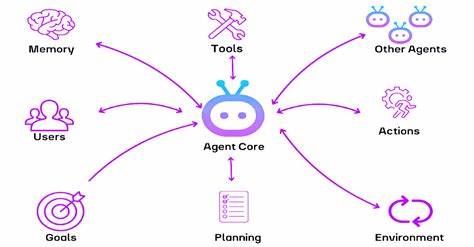

然而,现代人工智能系统的内部结构异常复杂,往往依赖庞大的神经网络和数据驱动的优化方式。人工智能要完全掌握自身架构的每一个细节并进行有效改进,面临着极高的复杂度和不确定性。稍有不慎的改动甚至可能导致系统性能下降甚至失效,这使得自然的递归改进过程变得异常困难。 其次,知识获取和理解的局限性也极大地限制了人工智能的自我提升能力。递归自我提升需要人工智能不断地吸收外部世界的新知识,并将其内化为自身能力的增强。然而当前的人工智能主要依赖于人类劳动提供的训练数据和算法设计。

它们缺乏主动探索和深度理解的能力,难以自主生成突破性的创新思路。此外,知识的复杂性和多样性使得人工智能系统难以全方位地掌握和利用,从而影响其自我提升的深度和广度。 再者,计算资源是递归自我提升过程中不可忽视的瓶颈。尽管云计算和分布式计算资源不断增长,但递归自我提升需要极大的计算能力支持,尤其在高维度参数空间中的优化迭代可能消耗大量时间和能源。资源的有限性限制了递归优化的规模和速度,进一步阻碍了系统实现高速自我进化的可能性。 此外,安全性和稳定性考量也限制了递归自我提升的实用部署。

在自我改进过程中,系统可能引入潜在风险,包括算法行为不可预测、系统安全漏洞以及伦理道德问题。为了防范这些风险,人工智能的自我修改往往受到严格限制和监控,导致自我提升的自由度大大降低。监管和伦理框架尚未完善,进一步为递归自我提升带来障碍。 另一方面,当前人工智能研究更多集中于特定任务的优化,而非普适的自我迭代能力。大多数人工智能模型专注于在定义明确的问题中达到高效表现,而递归自我提升要求系统具备跨领域的自适应能力和创造能力。实现这一目标需要对人工智能的结构、学习方式以及算法范式进行根本性的革新,而这条道路仍充满不确定性。

不过,尽管面临诸多挑战,递归自我提升的研究依然有其重要意义。它推动人们重新审视人工智能发展的根本路径,促进更安全、可控和高效的人工智能系统设计。未来,结合深度学习、强化学习与符号推理的混合智能系统可能为实现更有效的自我优化提供新的思路。同时,量子计算等前沿技术的兴起,也可能为解决计算资源瓶颈开辟新的途径。 总结来看,人工智能递归自我提升的愿景虽然令人振奋,但当前技术、认知和资源等多方面的限制使其难以在短期内实现。理解和接受这一现实,有助于调整人工智能研究的方向,避免盲目期待带来的风险。

同时,持续投入基础研究和跨学科协作,将推动人工智能在递归自我提升道路上逐步取得突破,迎来更为稳健和可持续的发展。 未来的人工智能发展需要保持理性审慎的态度,平衡创新与安全,努力克服自我提升过程中的各种难题。只有如此,才能真正实现智能系统的长远进步,推动社会和科技的全面发展。