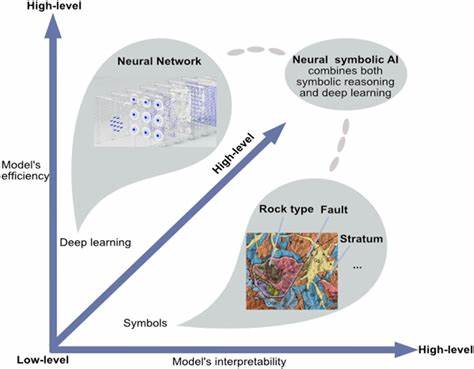

随着人工智能技术的不断进步,深度学习已经成为推动行业革新的核心动力。它在图像识别、语音处理和自然语言生成等方面展现了卓越的能力,带来了诸多前所未有的机遇。然而,随着AI应用领域渗透至医疗诊断、金融决策和法律判例等高风险领域,深度学习所面临的“黑盒”问题、缺乏可解释性和推理能力的局限日益显现。正是在此背景下,一种结合了神经网络与符号逻辑的新兴范式——神经符号人工智能(Neuro-Symbolic AI)崭露头角,被视为解决深度学习痛点的潜在突破口。神经符号人工智能融合了两种长期以来并行发展但各具优势的AI分支。神经网络以其强大的模式识别能力闻名,能够从大量数据中自动提取特征并进行预测,适用于识别复杂图像、理解自然语言、甚至生成逼真的文本内容。

与此同时,符号人工智能则基于逻辑规则和结构化知识,能够进行推理、归纳和演绎,治愈深度学习难以掌控的规则和因果关系领域。二者结合构建的神经符号AI不仅能够从数据中学习,还能利用逻辑推理对推断过程进行监督和解释,使结果更加透明和可信。这种能力正是传统深度学习系统所不具备的。高风险领域对人工智能的要求远超一般应用场景。医疗行业需要准确诊断的同时,还要求医生和患者理解诊断依据;法律领域要求AI能够解释判决的推理过程以符合法律伦理;金融服务需要确保算法决策公平、公正且能够追责。若深度学习依赖的黑盒模型无法满足可解释和可审计的需求,推广应用将受到极大限制。

神经符号人工智能通过将符号逻辑与神经网络无缝整合,实现了透明的因果推断和规则执行,极大提升了AI在此类场景下的适用性和信任度。在医疗诊断中,神经符号AI能够识别医学影像中的症状特征,同时结合临床指南和医学知识图谱进行规则推理,明确指出做出某一诊断的具体依据。这不仅帮助医生核实算法结果,也增强了患者对AI辅助诊断的接受度。在教育科技领域,这种AI模型能够根据学生的学习行为和知识结构规则,实时调整教学方案,解释错误原因并提供针对性的知识点辅导,显著提升个性化教学效果和学生学习体验。机器人及自动化规划是另一个受益领域。机器人需要对环境感知有清晰认知,同时进行多步骤行动计划。

神经符号AI将机器人对周围环境的视觉和声音数据感知与符号推理相结合,使机器人能够“前瞻性”地制定复杂操作流程,提高适应复杂任务的能力。在法律与政策分析领域,神经符号人工智能帮助解析繁复的法律条款,结合大量案例数据进行判例推理和政策解读,促进法律人工智能走向更高水平的智能辅助。此类系统不仅能深度挖掘法律文本,还能提供推理流程和依据说明,助力法律工作者决策。网络安全作为当下热门话题,神经符号AI通过结合深度学习所擅长的异常行为检测和符号逻辑的攻击路径规则,提升对新型网络威胁的识别和分析能力,实现安全事件可解释性,助力安全分析师快速定位攻击源头与防御策略。在推动神经符号AI发展的科研力量中,不乏世界顶尖研究机构和企业。IBM提出的神经符号概念学习器,展示了如何对视觉对象进行识别与解释。

MIT与IBM沃森实验室携手研发将混合推理应用于医学诊断与教育辅导的系统。美国国防高级研究计划局(DARPA)则致力于打造可解释的军事级AI,强调人机协同理解。斯坦福大学与微软也纷纷投入资源,将大型语言模型与符号逻辑相融合,为未来人工智能安全与可信奠定基础。随着大型语言模型的不断演进,如GPT和谷歌的Gemini,神经符号架构为其注入透明度和逻辑性,帮助减少“幻觉”现象和推理错误,增强安全性和责任追踪。未来AI不仅需要给出答案,更将需要展示其思考路径和理由,实现真正意义上的可解释智能。总而言之,神经符号人工智能引领人工智能从单纯强大走向可理解、可信赖,尤其适用于医疗、法律、金融等高风险行业。

它通过融合数据驱动的深度学习与基于规则的符号推理,实现了创新性的突破,满足了现实世界对AI安全性、透明性和责任性的需求。未来,神经符号AI有望成为行业关键基础设施,推动下一代人工智能变革,真正实现让机器不仅做出决策,更能讲清楚背后的“为什么”。