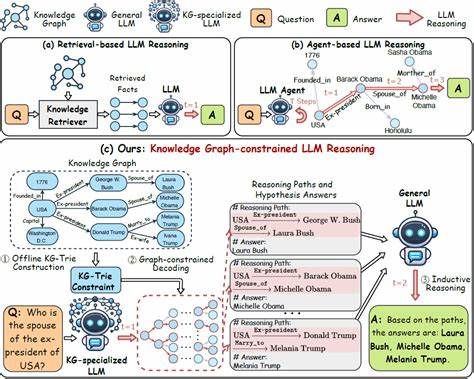

随着人工智能技术的不断发展,语言模型在自然语言处理领域展现出惊人的能力,尤其是大型语言模型(LLM)凭借其强大的语义理解和生成能力,成为解决多样化语言任务的主力军。然而,面对一些结构复杂且计算密集型的问题,单纯依赖语言模型的生成能力往往难以高效且准确地完成任务。为此,将树搜索技术与大型语言模型相结合,创造出一种上下文中学习并解决复杂问题的全新方法,成为当前研究的热点与突破方向。大型语言模型本质上是一种基于深度学习的概率语言生成器,通过对海量文本数据的训练,具备了对语句含义和上下文的理解能力。然而,这种模型在处理需要系统推理、多步决策的复杂问题时表现出局限,因为它们往往依赖于单一步骤的预测,缺乏对搜索空间的全面探索能力。树搜索技术,尤其是蒙特卡洛树搜索(MCTS)和启发式搜索方法,通过构建问题的决策树,逐步展开可能的解空间,结合评估函数对节点进行打分和筛选,从而寻找最优解决路径。

将此策略引入大型语言模型的推理过程中,可以有效弥补纯生成式模型的不足。结合树搜索的大型语言模型在应用中表现出惊人的灵活性和效率。在解决数学题、逻辑推理及编程等领域,其通过在内部构建多步推理路径,结合树状结构展开可能的答案,进而从中挑选最优解,大幅提升了准确率和鲁棒性。这一方法不仅仅是简单的搜索过程,更融入了上下文学习的能力。模型能够根据当前上下文信息动态调整搜索策略,选择更具相关性的解路径,避免无效的扩大搜索范围,从而节省计算资源并增强模型决策的针对性。在实际应用中,结合树搜索的语言模型已被用于自动代码生成、多轮对话管理、复杂问题的公式推导等场景。

这种方法有效融合了语言模型强大的语言理解与生成能力及树搜索在决策优化中的优势,实现了人工智能在复杂问题上更高层次的智能化。未来,随着算力的提升和算法的优化,结合树搜索的LLM有望进一步扩展其应用边界,不仅在学术研究领域展现潜力,更将在工业界引领各种智能化应用革新。预见这种技术类型的发展,能够推动机器理解和人类思维方式的更深层结合,促进智能系统在处理复杂认知任务时表现出更接近人类专家的能力。总结来看,将树搜索策略与大型语言模型进行融合,为解决传统方法难以攻克的复杂问题打开了新思路。借助上下文学习,模型能够更加精准地展开多步推理,在海量解空间中有序导航,最终收敛到高质量的解决方案。此创新方法不仅提升了问题求解的效率和准确度,也为人工智能领域的发展注入强大动力。

随着相关技术的不断成熟,结合树搜索的语言模型必将在各行各业中发挥重要作用,助力人工智能迈向更加智能和自主的未来。 。