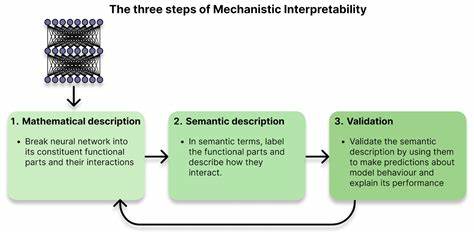

机械解释学(Mechanistic Interpretability)是目前人工智能领域中备受关注的新兴研究方向,聚焦于深入理解和解释语言模型的内部运作机理。随着大型语言模型(LLMs)在社会各个层面的广泛应用,研究其内部机制的重要性日益突出。通过机械解释学,不仅可以提升模型的透明度,也有助于开发更安全、更可控的人工智能系统。许多对人工智能充满热忱的专业人士渴望投身这一领域,但由于其跨学科属性和专业门槛较高,初学者往往面临诸多挑战。了解如何有效进入机械解释学,掌握关键技能和学习资源,成为迈向未来的关键第一步。机械解释学融合了机器学习、神经科学和系统工程等多重知识,要求研究者不仅能够深刻理解语言模型的架构和工作原理,还要具备扎实的数学和编程能力。

工程师、研究人员和学者各自拥有的背景决定了他们进入该领域的切入点和成长路径。对于拥有工程背景的人来说,系统思维和技术深度是极具优势的资本。熟悉分布式系统、GPU编程、复杂代码库管理,以及熟练使用Python和深度学习框架如PyTorch和Jax,能够帮助他们快速理解并参与模型的训练和调试工作。然而,工程师普遍需要加强机器学习基础知识的补充,理解基本算法和训练过程的原理,才能真正把握模型的内部机制。此外,阅读机械解释学领域的基础论文,可以更好地把握前沿趋势和研究目标。研究人员则往往具备扎实的科研方法和理论基础,但有时在与现代大型代码库及工程实践的结合上存在差距。

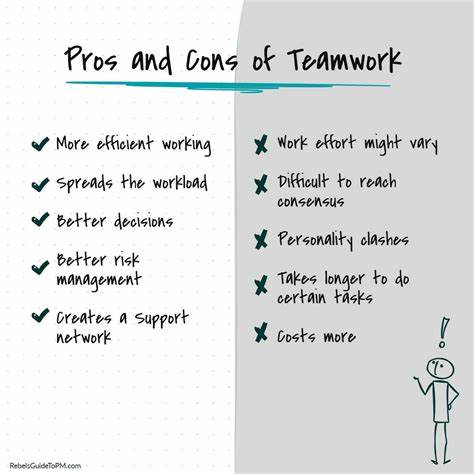

为此,学术背景的研究者应重点培养编写高质量代码的能力,熟悉团队协作代码库,掌握测试、类型检查和持续集成/持续部署(CI/CD)的相关知识。通过参与开源项目,提交代码贡献,实践代码设计和优化,能够加速融入工业界的研发环境。同时,研究人员应关注机械解释学的最新进展,积极进行实验分享和论文解读,通过博客和社交媒体提升自己的学术影响力。无论工程师还是研究员,打下良好的跨学科基础都至关重要。了解Transformer结构,尤其是其关键组件如注意力机制、多层感知机以及残差连接,是理解其“生物学”的第一步。将复杂的算法转化为可视化形态,借助工具呈现梯度流、特征激活等信息,有助于深入洞察模型如何处理输入并生成输出。

在学习过程中,选择适合自己的开源工具和平台也是必不可少的支持。TransformerLens、NNSight、Neuronpedia和Transluce都是业内认可的解读工具,配合这些库,可以设计并运行小规模的解释实验。此外,社区交流为成才提供了宝贵资源。加入机械解释学相关的Discord服务器、论坛如Alignment Forum和LessWrong,以及参与ML Collective等组织,能与同行互助,快速获取前沿信息和合作机会。面对机械解释学中固有的诸多未知和挑战,拥抱不确定性和探索精神尤为重要。许多核心问题仍未有明确答案,这正为充满好奇心和创新能力的人才提供了广阔的研究天地。

良好的科研素养、批判性思维和严谨态度,使得从业者能够在试错中不断修正假设,推动领域持续前进。培养通用技能同样不可忽视。数据可视化与展示能力,有助于将复杂观点转化为直观内容,便于沟通与交流。跨团队协作能力更是提升项目效率和质量的关键环节。同时,反复实践,积极分享阶段性成果,助力打造个人品牌,提升在机械解释学界的认可度。为帮助有志者系统规划发展路径,建议将学习划分为基础知识、实践技能、社区参与和持续进阶四个阶段。

基础知识包括机器学习基础、Transformer结构和编程语言掌握。实践技能强调通过小项目和开源工具完成完整解释实验的能力。社区参与涵盖积极参与讨论、开源贡献及社交媒体内容创作。持续进阶则鼓励关注最新研究动态,探索交叉学科问题,逐步形成独立见解。安托洛匹克(Anthropic)作为机械解释学领域的领头羊,除了提供丰富的资源,也开放了面向优秀人才的招聘机会。投身其中,既能体验科学发现的乐趣,又能参与塑造未来人工智能的安全框架。

面向未来,机械解释学将持续拓展其应用领域,从提升模型透明度到保障AI安全,再到推动算法优化,皆扮演举足轻重的角色。对技术爱好者而言,紧跟时代脉搏,深入探索这一领域,不仅能开拓职业前景,更有机会在人工智能革命中留下深刻印记。总之,机械解释学以其独特的交叉学科视角和挑战性任务,吸引着全球众多志士。无论是工程师还是研究人员,只有通过不断学习、实践与交流,才能真正把握其精髓与前景,成为推动人类理解智能本质的关键力量。迈入机械解释学的大门,需要热情、耐心和求知若渴的精神,也需要理性分析与严谨验证的科研态度。选择这条道路,是选择了一场关于语言模型内部世界的探索之旅,也是投身于塑造更加安全、可靠和智能未来的使命。

。