无人机技术的迅猛发展正在彻底改变现代战争的形态,而致命的无人驾驶杀手机器人更是成为新一代军事力量的焦点。在目前俄乌冲突中,这些杀手机器人的使用频率和规模达到了前所未有的高度,显示出其低成本、高效能和高度自主的特点,成为双方军事战略的重要组成部分。尽管技术的进步带来了战场效率的显著提升,但也引发了深刻的伦理、法律及安全问题,促使国际社会重新审视无人武器系统的未来与监管。 首先,不得不提的是无人机系统的技术革新。以乌克兰军方近期投入使用的Gogol-M“母舰”型无人机为例,这种固定翼无人机拥有约6米的翼展,能够携带若干自主攻击无人机,深入敌方200公里甚至更远的距离执行任务。攻击无人机配备人工智能,可以根据预设目标类型自主搜索并锁定目标,完成自爆式攻击,无需地面操作员的实时操控。

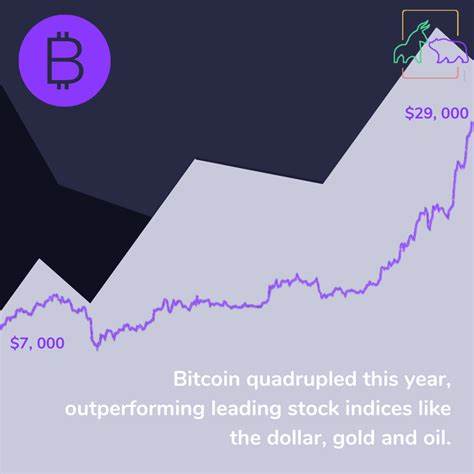

这种超级“母舰-子机”组合使命成本仅约一万美元,相比传统导弹系统数千万美元的价格优势显著,实现了大规模生产和部署的可能。 这类高自主性的无人机不仅能应对俄方强大的电子干扰,利用终端制导技术在最终进攻时脱离被干扰状态,实现目标精确打击,还极大地节省了人力资源。在6月初的“蛛网行动”中,乌军共发射了超过百架无人机深入俄境,对俄军关键空军基地实施了精准打击,重创多架核动力长程轰炸机。这一战例震惊全球,无人机群体协同作战及智能化控制成为未来战争的新标杆。 俄罗斯也紧随其后,研发并大量生产了被称为V2U的自主攻击机型,每日发射量达数十架。俄罗斯无人机同样具备视觉导航、目标自主选择与攻击能力,即便与操作员失联,仍能高效执行战术任务。

这些无人机不仅攻击军用目标,还涉及前线小股步兵作战单位,标志着作战模型正在由传统装备打击转向针对人员的精细化攻击。 疫情、缺乏导弹补给以及训练有素的无人机飞手数量有限等因素,促使交战双方加速无人机自主系统的研发和部署。大国如美国和中国也加快了相关技术研发步伐,美国五角大楼的Replicator 1计划将于2025年夏季完成一批跨域自主无人系统,旨在实现数量成千上万的小型智能无人机集群作战。中国的巨大“九天”无人机母舰,能够携带数百架自主无人机,执行数千公里范围内的侦察及打击任务,显示出全球无人武器技术竞赛的残酷竞争态势。 技术之外,道德与法律问题日益凸显。无人杀手机器赋予机器以杀人决策权,摆脱了传统的人工控制范畴,导致责任认定陷入困境。

从国际法视角来看,谁应为机器人造成的战争罪行承担责任?如何确保机器人的选择不会出错、避免攻击非战斗人员?这些问题在联合国层面进行了多年的探讨,但迄今为止尚未达成一致。虽然一些国家呼吁全面禁止或严格限制致命自主武器系统,但另一方面,军事大国则普遍主张现有法制足以应对,并强调技术优势不可放弃。 当前无人机武器技术的扩散速度极快,其成本低廉和易用性使得非国家武装组织甚至恐怖分子也有可能获得此类致命武器,大大提升了小规模冲突的破坏力和不确定性。来自多个国际组织的警告声四起,他们担忧无人机攻击的精准化和自主性可能催生新的大规模平民伤亡,同时为网络攻击和黑客入侵提供了全新攻击面,一旦敌方能够远程干扰或控制无人系统,其潜在危害将难以想象。 在机场、城市等重要目标防护方面,现有的安检及电子干扰措施正逐渐失效。专业人士指出,无人机可以在没有携带爆炸物的情况下,仅利用自身搭载的智能系统等待目标出现后发动攻击,对于传统安全系统而言极具挑战。

用无人武器群进行高密度攻击,成本低廉又难以被完全拦截,令城市防护预算骤然上涨。某些开发公司负责人建议,应结合人工智能和大规模监控技术,实时分析各类线索和异常行为模式,提升预警能力和城市整体防御水平。 对未来而言,俄乌战争为全世界敲响了警钟。类似武器系统的规模化应用将改变战争方式,但其带来的伦理和监管盲区要求国际社会加快制定相关法律框架。联合国秘书长安东尼奥·古特雷斯已呼吁通过具备法律约束力的国际条约来规范和限制致命自主武器的发展。尽管谈判面临重重阻力,军事和技术的快速迭代迫使人们更加关注无人杀手机器人的双刃剑特性。

综合来看,致命无人机及自主武器的快速崛起是科技进步与现代战争交织的产物。其在战场上的高效和成本优势不可否认,但同时也为全球安全稳定引入了无法预测的新风险。如何在享受技术红利的同时,确保人类社会不被无情的机器杀戮机器所吞噬?这不仅是军事技术领域的挑战,更是人类文明面临的重大道德考验。国际合作、法律规制和技术防范需并重,唯有如此,才能在瞬息万变的未来战争图景中,守护人类的尊严和和平的希望。