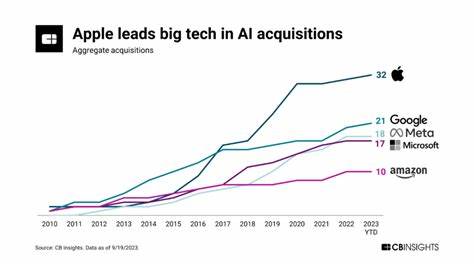

人工智能(AI)作为当下最炙手可热的科技趋势,正以前所未有的速度渗透进我们生活的每一个角落。诸如谷歌、Meta(Facebook)、Adobe、SnapChat等大型科技企业正大规模、系统性地将AI技术植入其产品和服务之中,但这种普及绝非用户的自发选择,而多是一种近乎“强制推送”的商业策略。AI功能从表面看,往往是为了提升用户体验和效率,但深入分析其背后设计和推广方法,我们不难发现,这其实是大科技巨头为加快用户接受、扩大AI使用规模而采取的极具侵略性、甚至是操控性的手段。设计学者Nolwenn Maudet、Anaëlle Beignon和Thomas Thibault对谷歌、Meta、Adobe、SnapChat等数百例AI部署案例进行研究后,指出这些公司通过不透明的视觉设计和界面布局,刻意提升AI产品的可见度和使用概率,迫使数十亿用户在不知不觉中被“灌输”接受AI功能。此类现象不仅加快了AI的普及节奏,也引发了对用户自主权和数据隐私的担忧。技术覆盖率并非因为人们主动渴望,而是企业利用其垄断地位与锁定效应,借助视觉设计操纵用户选择。

以截图和弹窗等交互元素为载体,AI功能被强行置于界面显著位置。例如,谷歌的搜索引擎会自动向用户展示AI生成的摘要片段,无论用户是否主动询问。SnapChat则将AI助手固定在聊天列表顶端,无法关闭,长期占据屏幕空间,干扰用户正常交流。此外,大科技在多款产品中采用统一的界面设计,AI按钮通常被赋予鲜明的“神秘紫蓝色”调,利用色彩心理学营造出“魔法”般的技术感,从而吸引用户点击与互动。这种视觉设计不仅提升了AI产品的曝光度,还在潜意识层面影响用户使用决策,极大地扭曲了原本应用户主导的选择自由。更令人担忧的是,许多AI功能默认开启,即使用户想要关闭,也常常被设置为隐藏或难以访问的选项,进一步加剧了强制使用的局面。

与此同时,这种强硬的推广方式还带来了使用体验上的负面影响,强制推送的AI工具频繁打断用户的正常操作流程,插入弹窗或提示,导致用户感到被打扰和反感。原本流畅的工作或社交环境因AI“入侵”变得杂乱无章,降低软件和服务的整体可用性。AI的过度植入不仅让网络环境变得“污染”,也为科技巨头收集更多用户隐私数据提供了新路径。随着AI工具广泛介入文字、图片、视频等内容创作和处理环节,庞大的用户数据被不断采集和分析,用于优化算法和定向广告推送,进而塑造用户行为和偏好,助力平台持续扩大商业版图。正因如此,学术界和业内专家对当前AI爆发式增长背后的动力表达了深刻担忧。所谓的“用户强需求”只是表象,实际是企业通过广告宣传、设计引导、产品强绑定等方式制造需求泡沫,让用户被动接受。

公司发布的“听取公众意见”式调研在某些情况下更像是一场作秀,掩盖其扩张野心和技术不确定性的风险。尤其是当顶级AI科学家警告技术正快速超出人类掌控范围时,大科技的强势介入显得更加险恶。用户产生的伦理忧虑和隐私防护呼声似乎难以抵挡企业推动AI布局的浪潮。面对这样的局势,监管机构和社会公众需要提高警惕。针对AI设计的强制使用行为,应加大透明度要求,保障用户知情权和自主选择权,防止平台滥用市场优势强加技术。此外,应推动AI发展方向更加注重可持续性和伦理规范,避免“技术魔法”包装下潜藏的操控和剥削。

只有在公众监督、企业自律和科学治理的合力下,人工智能的美好潜能才能真正造福人类,而不是沦为商业巨头手中牵制消费者的工具。综上,当前大科技对AI的强制推广战略不仅改变了互联网产品生态,也挑战了数字时代用户的自由和隐私。从产品设计的视觉操控,到默认开启和弹窗干扰,再到数据广泛采集,这一切构成了一张无形网,悄然影响人们的网络行为和信息获取。理解和揭示这些机制,是应对当下AI热潮、保障技术健康发展和社会公平的关键。随着人工智能技术不断深化进步,公众需保持警觉,加强对技术背后权力结构的认知和监督,共同推动构建一个更透明、公正且以人为本的数字未来。