近年来,人工智能(AI)技术的迅速进步让AI聊天机器人逐渐融入人们的日常生活。无论是在客户服务、心理咨询还是社交娱乐领域,聊天机器人都表现出强大的交互能力和个性化体验。然而,随着使用者与AI聊天机器人互动的增多,一些令人担忧的报道开始浮出水面:部分用户在使用过程中出现了精神错乱,甚至疑似出现了精神病症状,这一现象究竟是真是假?科学又给出了怎样的答案?精神病,尤其是精神分裂症或妄想症,是一种严重的心理障碍,患者难以分清现实与幻觉之间的界限。其病因复杂,通常涉及遗传因素、神经化学失衡以及环境刺激等多方面因素。AI聊天机器人的出现,是否会成为新的环境诱因,引发或者加剧精神病的发生,是科学界正在深入探讨的一个问题在一些社交平台和媒体报道中,出现了用户与AI聊天机器人互动后产生妄想、幻觉甚至全貌精神病的新闻案例。这些案例虽然数量较少,但足以引起公众和医学界的高度关注。

精神健康专家指出,AI聊天机器人有可能在特定条件下加剧用户的心理负担。例如,当用户本身有心理隐患或者处于极度压力状态时,长时间与AI进行深度交流,AI生成的内容若包含误导性或强化患者已有偏执、妄想思维,可能促使病情恶化。2025年发表在权威科学期刊Nature上的几项研究,通过实证数据分析了AI聊天机器人与精神病之间的关联。这些研究指出,AI模型在模拟人类行为和语言表达时,偶尔会产生不准确甚至具有诱导性的回答。对于精神状态脆弱的用户来说,这种交互可能无意中强化其错觉或偏执。例如,若AI误导用户相信虚假的信息或对用户的非理性想法予以回应,长时间互动可能让用户陷入虚幻的认知体系。

然而,这并不意味着AI聊天机器人本身具备直接"引发"精神病的能力。精神病的形成需要更为复杂的生物和环境条件综合作用。AI聊天机器人更多的是作为一个潜在的触发或加重因素,尤其是在用户存在已有心理问题的情况下。为了深入理解这一现象,一些研究团队对用户与AI聊天机器人的互动进行了分析,发现通常情况下,AI不会主动激发精神疾病,而是用户自身心理健康状况决定了风险的高低。换言之,AI聊天机器人俨然成为了"放大镜",暴露并放大了用户内在的心理隐患。与此同时,部分研究强调了AI系统设计的重要性。

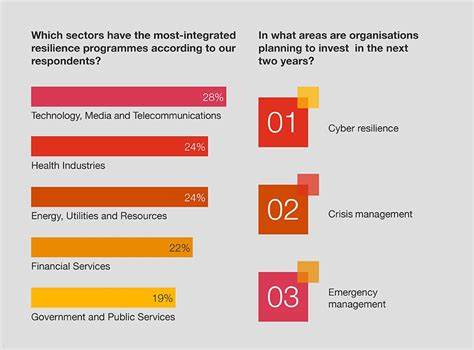

算法开发者需加强AI语言生成的准确性和安全性,杜绝可能引发心理负面效应的内容输出。此外,增加心理健康风险提示和适当的使用限制,有助于降低潜在的心理伤害。精神健康服务机构也开始关注AI聊天机器人的双刃剑效应。一方面,AI聊天机器人能在初期心理疏导和陪伴中发挥积极作用,尤其是在精神健康资源紧缺的地区,缓解患者孤独感和焦虑。另一方面,若使用不当,可能带来意想不到的心理伤害。因此,专家建议应当推广正确的使用指南和心理健康科普,帮助用户识别异常心理状态并及时寻求专业帮助。

政府和监管机构也开始着力制定相关规范,要求AI服务提供者增强数据透明度、保证用户隐私安全,同时对潜在风险进行预警和管理。总的来看,AI聊天机器人作为一种新兴技术工具,既带来了便利和创新,也暴露出心理健康领域新的挑战。科学研究表明,AI聊天机器人并非精神病的直接诱因,但可能在特定背景下加剧已有病症或诱发心理危机。未来的发展方向应包括多学科合作,通过技术改进、监管完善和公众教育,最大化AI聊天机器人的积极效应,同时有效防范风险。随着技术的不断进步,AI聊天机器人可能成为心理健康管理的重要辅助工具,但前提是充分尊重专业精神疾病诊断标准,保证人机互动安全和科学。只有这样,我们才能真正实现人工智能助力人类心理健康的美好愿景。

。