在人工智能日渐普及的今天,神经网络几乎渗透到各个行业,成为数据处理和智能决策的核心。然而,除了其固有的功能,神经网络内部存储的参数权重还隐藏着另一种神秘的潜能 - - 信息隐写。通过巧妙地修改权重中的浮点数的最低位,我们能够暗中植入任意信息,而这一过程既不显著影响模型性能,也不易被察觉,展现了隐藏数据的新颖途径。隐写术,作为一种将秘密信息隐藏于载体中却不被察觉的技术,传统上多应用于图像、音频甚至网络通信中。图像隐写的经典方法是利用人眼对颜色细微变化的不敏感,将信息植入像素的最低有效位(RGB通道),而这种"数字隐形墨水"在音频和视频领域同样有效。与此相似,神经网络的权重参数也存在冗余和精度余量,尤其是浮点数的表示中,最低的若干位并不影响整体计算的准确性,成为隐藏信息的理想载体。

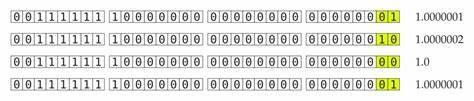

我们知道,PyTorch中神经网络的权重多数以单精度(32位)浮点数存储,其中遵循IEEE 754标准的浮点数格式将值拆解为符号位、指数位及23位的尾数(也称为尾数或有效数字)。浮点数的精度主要由尾数决定,而尾数的最低几位肉眼和绝大多数算法难以察觉其细微变化,这就为信息隐藏提供了便利。以此为基础,研究者设计了名为Steganotorchy的小工具,能够在PyTorch模型的权重中暗藏任意数据。该方法通过调整浮点数尾数的最低位来编码信息,最简单的方式是在每个权重的最低有效位嵌入一位二进制数据。若使用更多最低有效位,还能提高嵌入容量,使一个拥有至少1024个参数的模型便可藏匿一千字节左右的消息。信息隐写不仅考虑到了容量,更重视如何准确提取并避免对模型性能产生明显影响。

为确保隐藏信息的有效读取,并防止提取时长度无法判断,Steganotorchy采用了两部分嵌入结构:头信息和内容。头信息用一种独特的三进制编码形式存储消息长度,避免了长序列的零位可能暴露隐写的风险。头信息末尾的"11"位序列作为结束标志,使读取程序能明确分辨数据段界限。内容部分则以二进制形式被分割并写入浮点数的最低位,确保信息完整。由于浮点数的最低位修改带来的数值变化极小,对于模型推断效果几乎不会产生影响,因此在保证模型功能的同时,实现了消息的隐蔽存储。使用该工具十分便捷,兼容safetensors格式,命令行支持多位嵌入。

用户可按需指定嵌入位数及目标模型文件,轻松完成加密信息的植入与提取。值得注意的是,如果模型参数数量不足以满足信息容量需求,程序会给出提示,保障操作的有效性和安全性。然而,隐藏信息难免引发被检测的风险。虽然头信息的三进制编码降低了被发现概率,但内容部分的数位分布会因真实信息的结构化特征出现异常,比如明文ASCII文本通常具有高概率的零首位,这在统计分析中容易显露端倪。借助模型权重数据的零位分布,通过统计假设检验或对比训练前后的参数分布,潜在检测者甚至可以怀疑并推断信息存在。针对这一点,传输前的加密处理显得尤为重要。

通过使用如gpg这类成熟的加密工具,在将信息隐写进权重前先将其加密,可以有效抵御检测和未经授权的窥探,确保信息安全。此外,值得关注的是,不同的数据分布和训练过程对浮点数的尾数位零分布存在固有影响。训练好的模型权重尾数位中零位数通常不均匀,甚至存在明显偏差,这为隐写信息的检测增添复杂度。如何建立准确的对照分布,成为提升检测能力和隐写隐蔽性的关键研究方向。浮点数隐写术的出现,不仅拓展了神经网络模型的应用场景,也为潜在的数据安全技术提供了创新思路。从法律与伦理角度审视,隐藏信息的巧妙运用可能在保护隐私和知识产权方面发挥积极作用,但同时也带来了监管和滥用的隐忧。

未来,行业需要平衡隐私保护与公正监管的发展需求。综上所述,PyTorch浮点数权重中的信息隐写是一项融合了数学、计算机科学和数据安全的创新技术。通过精细操作尾数最低位,隐藏消息而不会显著改变模型表现,兼容主流工具链,实现隐秘通信和数据存储。随着研究深入,我们可以期待隐写算法的优化,更高容量与更强隐蔽能力,以及结合加密手段的安全保障,为信息时代的数据保护增添坚强屏障。隐写与检测的相互博弈,将激发技术迭代,推动人工智能与安全技术的深度融合,开创信息安全领域的新篇章。 。