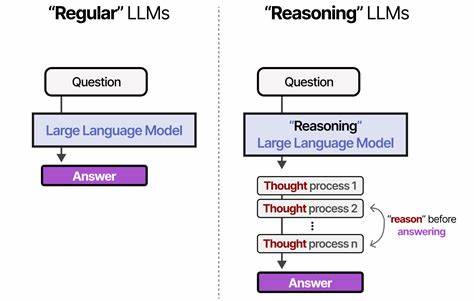

近年来,大型语言模型(LLMs)在人工智能领域取得了重大进展,尤其是具备推理能力的推理型大型语言模型(Reasoning LLMs),为开发者构建复杂智能系统提供了强大支持。推理型LLMs不仅具备处理自然语言的基础能力,还能够执行复杂的链式思考和多步骤推理,适合应用于科学计算、代码调试、多模态分析等领域。本文将围绕推理型LLMs展开,深入剖析其概念、主流模型、设计模式、使用技巧以及未来潜力,助力开发者理解并高效利用这一先进技术。推理型大型语言模型,顾名思义,是专门训练以进行推理过程的模型,它们能够在回答问题或执行任务时模拟连贯的思考链条。与传统的语言模型相比,推理型LLMs能够通过逐步分析和逻辑推导来完成复杂任务,提升输出的准确性和可靠性。值得关注的顶级推理模型包括谷歌AI的Gemini 2.5 Pro、Anthropic的Claude 3.7 Sonnet以及OpenAI的o3模型。

这些模型不仅在自然语言处理任务中表现卓越,而且在代码生成、科学计算、视觉推理等多个领域展现了强大的推理能力。构建推理型LLMs的设计模式多样,涵盖了链式思考(Chain-of-Thought)、元提示(Meta Prompting)、层次规划和多工具调用等。链式思考通过模拟人类的逐步推理过程,帮助模型分解复杂任务,提升理解和推断效果。元提示则允许模型根据上下文动态调整自身策略,增强灵活性和适应能力。在构建智能代理系统时,推理型LLMs的规划能力尤为重要。通过任务分解、分步执行,代理系统可有效管理复杂流程,显著提升性能和效率。

Agentic RAG(检索增强生成)是近年兴起的一种应用模式,它将强推理模型与信息检索深度结合,使系统能够针对庞大知识库中的信息进行智能筛选和推断,满足高复杂度查询需求。此外,推理型模型在自动评估和判决系统中的应用日益广泛。利用“LLM-as-a-Judge”架构,模型能够基于理解和综合大量信息,做出准确、公正的评价反馈,推动自动化测试、内容审核等领域发展。视觉推理作为多模态AI的重要分支,也正借助推理型LLMs实现跨界突破。以o3为代表的模型通过内嵌多工具调用能力,对图像内容进行复杂推理、编辑和增强,推动视觉语言模型迈向更高层次的智能。推理型LLMs的使用技巧直接决定了其在实际项目中的表现。

开发者在设计提示时,应避免冗长的链式思考指导,采用简洁明了的高层指令,确保模型专注于主要目标。同时,有效采用结构化输入输出格式(如XML)能够提升系统交互的稳定性与可控性。当模型遇到复杂输出要求时,结合少样本提示(Few-shot prompting)能引导其生成更符合预期的结果。启用推理模式时,合理控制“思考时间”非常关键,低算力模式适合快速响应,复杂任务则可通过增加推理深度获得更准确答案。虽然推理型LLMs拥有强大优势,但也面临一些挑战。输出内容偶尔会出现重复、混杂或格式不统一的问题,要求开发者通过优化提示和引导策略进行调整。

链式思考虽然提升了推理能力,但若使用不当反而可能影响模型对指令的遵循度,需结合少样本教学、自我反思等技术方法进行权衡。此外,推理模型在成本和响应速度方面相对较高,面对实时性要求严格的场景时,应平衡准确率和性能。当前模型的工具调用和决策能力仍有提升空间,尤其是处理多任务并行和复杂环境感知时,尚需进一步强化多模态融合及动态决策能力。展望未来,推理型大型语言模型在智能代理、多模态理解、科学研究辅助等多领域潜力巨大。随着模型架构创新和训练技术进步,推理模型将更好地支持自动规划、动态知识整合及跨领域推理。开发者掌握系统性的推理应用与调优技巧,有助于打造更具创新力和实用性的智能解决方案。

伴随着推理模型生态的不断成熟,相关课程培训和社区支持亦日益完善,推荐开发者积极参与专业学习和交流,快速提升实践水平。推理型大型语言模型代表了AI发展的前沿方向,其集成先进的推理机制和高度灵活的应用潜力,为构建下一代智能系统奠定坚实基础。深入理解推理LLMs的本质与应用场景,有助于开发者在竞争激烈的AI领域抢占先机,实现复杂任务的智能处理和创造性突破。