大型语言模型(LLM)作为人工智能领域的重磅技术,正逐渐改变我们与信息互动的方式。然而,许多人对于LLM在生成全新思想方面的能力仍存质疑与迷惑。部分AI怀疑论者认为,这些模型仅仅是在重复和拼凑训练数据中的信息,不具备真正的创新能力;而AI支持者则好奇:如果机器拥有几乎无限的知识储备,为什么它们不能像人类那样结合知识、提前洞察、创造前所未有的想法?这一疑问成为促进LLM进一步发展的重要驱动力之一。 从根本上说,LLM的训练模式是基于大量文本数据学习概率分布,使模型在给定上下文时预测下一个最可能的词汇序列。这样的过程促使模型生成内容时依赖已有的模式与表达,难以直接提出完全独立、从未出现过的概念。更具体地说,模型训练的目标是复现已有文本,而非积极地创造“新知识”,这从某种角度上限制了其原创力的发挥。

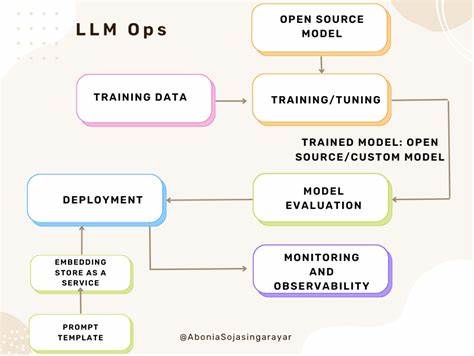

然而,创新不仅仅是简单地把已有知识复制粘贴,它更强调在知识之间建立深刻的联系和构架。由此,研究者们发现,单独依靠模型自身潜力往往不够,必须设计“支架”(scaffolding)机制,即通过程序或环境的辅助,提供模型更结构化的输入、反复反馈和迭代机会。这样的支架可以引导模型在更具体、明确的框架内产生想法,从而有效地激发创造力。 举例来说,ChatGPT的会话记忆功能就是一种支架,它让模型能够长期“记住”对话背景并基于对方提供的信息做出个性化回应。GitHub Copilot则是另一类支架,通过将模型嵌入代码编辑器,帮助用户自动生成代码片段,并允许从代码库进行实时反馈和调整,极大提升了编程过程中的创造效率。实际上,人工智能工程的许多创新就是通过发现和优化这种支架方式得以实现的。

对于如何具体让LLM生成真正创新的想法,有一条值得借鉴的思路被称为“白日梦循环”(day-dreaming loop)。这种方法最初由知名AI研究者提出,核心在于让模型随机抽取两个看似不相关的事实,然后思考二者之间可能存在的联系,如果发现潜在关联,再保存下来作为新的“知识点”。这样的反复循环模拟了人类大脑联想与启发式思考的过程,有望挖掘出意想不到的创新灵感。 尽管这一方法具有很强的吸引力,但实际操作却面临不少困难。简单让模型直接连接两个随机想法,往往会陷入“空洞连接”的陷阱,比如提出表面上的相关性却缺乏具体实操方案或深度逻辑,这种笼统而含糊的联想往往难以支撑后续创新实践。因此,在具体应用中,需要对输入想法进行类型限定,例如专注于“机制”类型的知识,同时为模型设定明确的目标问题,让其在探索过程中拥有具体方向和评价标准,以减少无效泛化与空洞观点的生成。

这也引出了一个关键点:作为用户,我们需要具备对生成结果进行有效判断的能力。在项目早期,作者尝试让模型自由发挥,经常出现大量碎片化、偶尔闪现的灵感,但难以分辨这些思路是否切实可行,也难以判断哪些值得深入挖掘。这说明,在熟悉领域的背景知识加持下,能够帮助更精准地将模型的输出转化为实际价值,避免盲目拥护或轻易否定创新点。 在尝试用“创意丰富”的文本来启发模型方面,也曾进行多次尝试,比如在输入里融合诗歌、散文甚至随机事实,期望模拟人类思维中多线索并行的状态,让模型迸发出更多新颖想法。然而,实际结果显示,现代LLM经过“助理模式”(assistant mode)的微调后,倾向于忽略这类无关前言,专注回答核心问题。这一点可能反映了模型对输入的高度智能筛选机制,也揭示了潜在的调教瓶颈,即期望通过语言环境引导创造的途径尚未完全奏效,需要结合更富层次的交互与奖励机制才能打开更大创新空间。

此外,要实现真正高质量且多样的随机知识生成也不简单。研究发现利用简单指令让模型持续输出随机有趣的事实极具挑战,因为出现重复内容或陈词滥调的几率较高。为此,作者采用了手动分批生成、筛选和归档多个知识片段的方法,以YAML格式管理,有效扩充了知识库存,支持后续自动抽样和联接操作。这种半自动化的过程虽不完美,且效率有限,但已经显现出产出若干新颖且有潜力的创意的良好迹象,表明改进空间巨大。 实现大约三成的效果提升,就足够令此类工具具有商业吸引力和实际应用价值。基于此,作者公开了相关项目代码,鼓励社区参与开发和优化,共同探索更有效的支架设计策略。

总结来看,虽然目前LLM在生成彻底全新的原创想法方面尚存在局限,但结合智能支架、明确目标和反馈机制,可以显著提升它们的创新能力。未来,随着模型基础架构的改进和工程架构创新,将极有可能使得AI不仅仅模仿和组合过去的知识,而是真正启发人类思维,催生前沿变革。 理解到各方观点都各有合理。据怀疑论者视角,任何看似新颖的输出,实则是将训练数据条目重新编排,缺乏真正“原创”的成分,从而质疑AI创新。而拥护者则认为,AI通过复杂概率分布及多层逻辑推演,实际上构建了内在的世界模型和认知框架,其输出体现了某种形式的独创性和洞察力,这是一种更宽泛且实用的“创新”定义。 推进这一领域需要跨学科、多层次合作,AI开发者、领域专家及最终用户共同参与,聚焦如何设计更精细的互动流程、更有效的反馈循环,以及更深层次的知识表达方法。

在这一过程中,我们正见证AI作为工具,如何逐渐成为人类思维的助推器和共创者,而非单纯的内容复制机。 总之,要激发大型语言模型的创新潜力,关键在于为其搭建合理且富有引导性的“支架”。结合明确的问题定位、知识类型限定、多轮循环思考以及人类专业判断,这些做法不仅提升了创意质量,也为未来AI辅助创作注入无限可能。通过持续试验和优化,相信有朝一日,AI将在创造力领域与人类实现真正的融合与互补,催生充满价值与前瞻性的突破性想法。