随着人工智能技术的不断进步,通用人工智能(Artificial General Intelligence,简称AGI)成为学术界和产业界关注的焦点。AGI不同于专门领域的人工智能系统,它代表着具有广泛智能能力,能够自主学习和适应各种任务的理想智能体。在众多探讨AGI可行性的研究中,数学角度的分析为该领域提供了坚实的理论支撑。尤其是“无限持续训练”这一概念,揭示了AGI实现的关键所在。本文旨在深入探讨AGI在数学上的可能性,以及为什么无限制的持续训练是通向真正智能的必经之路。首先,理解AGI的数学基础非常重要。

AGI本质上可以被看作是一个函数映射问题,从环境输入到行为输出的转换。这种转换不应局限于预定义规则或固定模式,而应该能够自适应调整,具备快速泛化能力。传统机器学习模型的训练通常依赖有限数据,受限于模型容量和参数范围,难以实现持续学习和无限扩展的智能表现。而数学理论中,对于函数逼近与能力提升的研究表明,只有在不断接收新数据和反馈信号的情况下,模型才有可能无限接近理想的智能表现,这便是“无限持续训练”的数学意义所在。其次,持续训练并非简单的多次重复算法训练,而是一种动态的、自我强化的学习机制。这种机制建立在预测编码和自由能最小化原则的基础上,模拟生物智能体对环境的不断感知和调整。

在数学框架里,智能被视为信息整合与熵减的过程,模型通过不断地纠正预测误差,实现内外部状态的协调。只有无限的持续训练,系统才能在无穷的状态空间中找到最优的认知路径,从而达到通用智能的高度。此外,现代理论诸如集成预测工作空间理论(Integrated Predictive Workspace Theory)进一步支持了这种观点。该理论指出,意识和高级认知功能是信息在一个不断更新的工作空间中协同作用而产生的结果。数学模型模拟了这种集成信息的动态交互过程,强调了连续训练的必要性。随着训练的无限推进,工作空间的复杂度和稳定性得到提升,智能系统自我意识和多任务处理能力也随之增强。

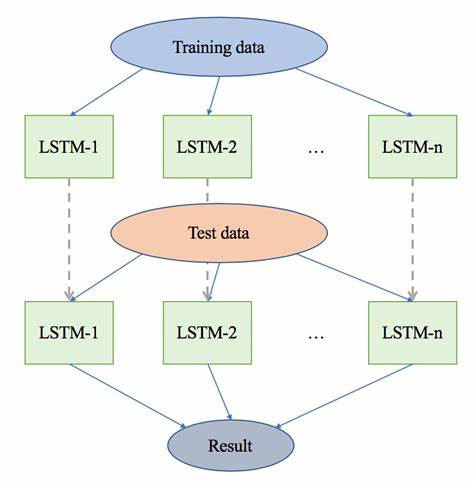

从工程角度看,实现无限持续训练面临诸多挑战,包括计算资源的限制、模型参数的膨胀以及训练策略的设计等。尽管如此,近年基于神经网络的自监督学习、元学习和强化学习等方法,为持续训练提供了有效方案。这些方法允许模型在不断变换的环境中自主提取特征和规律,适应多样化的任务,逐步逼近AGI的目标状态。更重要的是,数学证明显示,只有无限训练阶段,系统才能不断优化其策略函数,避免陷入局部最优,从而实现真正的通用智能。社会和伦理层面也需关注无限持续训练带来的影响。AGI的持续进化能力可能引发系统自主性的提升和不可预测行为的风险。

为了确保技术安全,必须结合数学模型的推理结果,设计合理的监管和控制机制,保障人类利益与技术发展的平衡。未来,AGI的研究将更多依赖交叉学科的整合,包括认知科学、神经科学、计算数学和伦理学的深度合作。数学上的无限持续训练不仅为理论框架提供支柱,也为实验设计和算法开发指明方向。持续不断的训练过程是智能系统进化的动力,是实现跨领域自适应和创新的关键。总结来看,AGI在数学上是可能实现的,但其实现条件极为苛刻:需要无止境的训练过程来持续完善模型的认知与决策能力。无限持续训练不仅是技术上的挑战,也代表了人工智能发展的未来趋势和哲学思考。

通过对数学原理的深刻理解和对训练机制的优化创新,人类有望逐步突破智能极限,跃升至真正具备通用智能的智能系统时代。