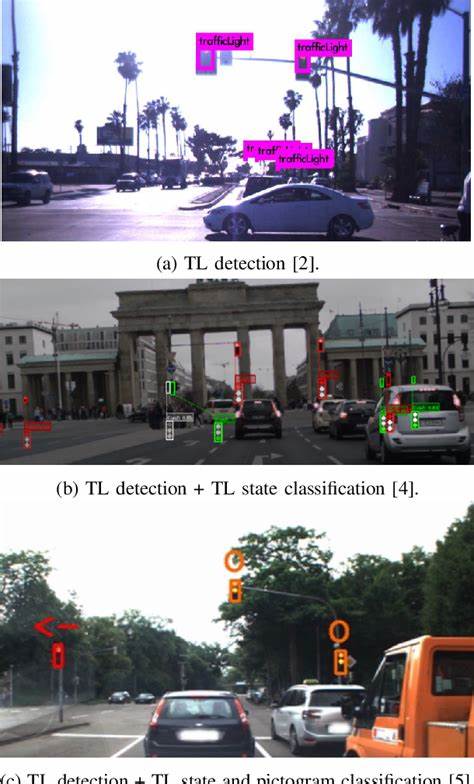

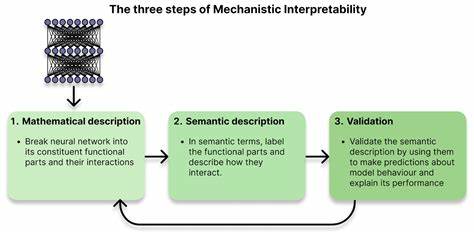

随着城市化进程的不断加快和交通工具的日益增多,交通信号灯作为交通管理的重要组成部分,其识别准确性与实时性对于确保车辆行驶安全和提高交通效率具有决定性意义。传统的交通信号识别方法往往依赖于颜色阈值分割、模板匹配等技术,无法适应复杂的道路环境和多变的光照条件。近年来,深度学习技术的兴起,特别是卷积神经网络在计算机视觉领域的突破,为实时精准识别交通灯状态提供了新的解决方案。实时交通灯颜色识别系统不仅需要在保证高准确率的前提下,还要实现低延迟的处理速度,这对于自动驾驶系统和智能交通监控尤为重要。 卷积神经网络作为一种能够自动学习特征表达的深度学习模型,通过多层的卷积与池化操作,能够有效提取图像中多层次的空间特征,实现对图像中微小对象的精准检测。YOLO(You Only Look Once)系列模型因其高效的单阶段检测架构,在目标检测领域逐步成为主流。

最新版本YOLOv8在传统架构基础上进行了多项创新,包括无锚点检测头、增强的特征融合路径以及多任务统一损失函数,显著提升了小尺寸目标和复杂场景下的检测性能,为交通信号灯识别任务带来了极大便利。 为了进一步提升模型的轻量化和计算效率,同时保持甚至超越标准卷积的检测精度,在YOLOv8架构中引入了深度可分离卷积(Depth-Wise Separable Convolution,DWSC)。DWSC将传统卷积拆分为对每个通道独立的深度卷积和随后通过1×1卷积实现的跨通道融合,这种设计大幅降低了模型参数和计算复杂度。通过在模型的骨干网络与检测头部全面应用DWSC,不仅提升了模型处理速度,也在交通灯颜色识别的准确率上取得了显著突破,尤其是在复杂光照和环境干扰下对红色与黄色灯识别的性能表现尤为突出。 为了确保模型具备强大的泛化能力,训练过程中综合运用了转移学习和小样本学习策略。模型首先在公开的交通灯图像数据集上进行预训练,获取基础的视觉特征提取能力。

随后,在自行采集的多角度、多光照、多天气条件的真实交通灯视频帧中进行微调,增强模型在实际应用中的稳定表现。通过视频数据增强技术,模型能够学习到运动模糊、遮挡、不同摄像机视角下的变化,有效提升了对动态场景的适应性和识别鲁棒性。 在性能评估方面,模型展现了极高的识别精度,红灯与黄灯的精确度分别接近99%,绿灯识别亦保持85%以上的较高水平。利用平均准确率(mAP)指标来衡量,模型在IoU阈值0.5上达到94.7%,并在长达80个训练周期中训练损失持续下降,无过拟合现象,证明了模型的收敛性和现实场景的适用性。同时,模型在运行时延与计算资源占用上也达到了嵌入式系统可接受范围,适合部署于车载摄像系统或交通监控设备。 光照反差大、逆光眩光、天气变化等因素往往是交通灯检测中的难点。

针对这些问题,该模型利用空间金字塔池化融合模块(SPPF)加强上下文信息捕捉,提升复杂背景下对交通灯微小特征的辨识力度。此外,结合多层级特征融合机制,将浅层位置精确特征与深度语义特征融合,为小目标识别提供有效支持,从而保证了在遮挡和部分失真情况下依然能够稳定准确地识别信号状态。 绿色信号的相对低识别率主要源于其与周围绿植和环境色彩的相似性,未来通过结合多模态传感器融合,如激光雷达与雷达信息、车型动态信息等,能进一步辅助视觉模块做出更准确的判断。此外,基于先进的状态估计方法如无迹卡尔曼滤波器(UKF)和同步定位与地图构建(SLAM)技术的融合,有望强化传感器数据的时空关联,提高对信号灯状态的连续识别和预测能力,为自动驾驶系统提供更加稳健的决策依据。 进一步讲,生成式人工智能技术已开始在交通灯识别领域展现巨大潜力。利用生成对抗网络(GANs)或扩散模型生成逼真的合成训练样本,不仅能缓解训练数据稀缺问题,还可模拟极端天气、异常光照等罕见情形,提升模型鲁棒性。

此外,数字孪生仿真平台结合生成模型,能够为交通信号识别系统提供丰富、可控的虚拟测试环境,加快算法迭代与优化周期。 当前的研究成果标志着在交通信号灯颜色识别技术迈入了一个集轻量化、高效性与精准度于一体的新阶段。模型不仅满足了对实时性的苛刻需求,还在多变环境下保持了极强的识别稳定性,为智能交通系统、自动驾驶车辆的安全运行提供了坚实基础。未来,随着数据集的多样化和跨地域验证的开展,模型的通用性和适应性将进一步提升。同时,通过智能边缘计算的普及,该类模型有望实现更广泛的商业部署与应用。 综上,基于深度卷积神经网络的实时交通灯颜色识别技术,以其优异的检测能力和灵活的结构优势,正逐步打破传统交通管理的局限。

随着技术进步与多学科融合的发展,未来的智能交通系统将更加智能化、精准化,为构建安全畅通的智慧出行环境提供强有力的技术支撑。 。