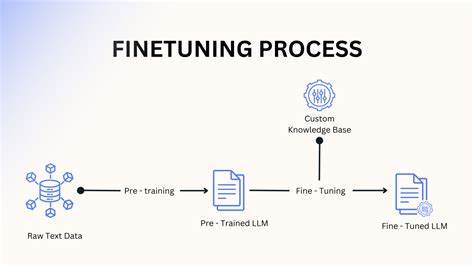

随着人工智能技术的不断进步,机器学习在各行各业的应用愈加广泛,而微调(Fine-Tuning)作为一种高效利用预训练模型的方法,正在2025年成为机器学习工程师不可或缺的技术秘诀。微调不仅能够显著提高模型在特定任务上的表现,还极大地缩短了模型训练时间和成本,使得工程师能够更灵活地应对不同应用场景的需求。 微调的核心概念其实相对简单:与其从零开始训练一个模型,不如在已有的大型预训练模型基础上,利用少量高质量的数据对模型进行针对性调整,从而使其更好地适配具体任务。近年来,随着大规模预训练语言模型(LLMs)如GPT系列、BERT等的兴起,这些模型已经具备了强大的语言理解和生成能力。通过微调技术,工程师可以快速将通用模型转化为满足客户需求的专业版,使其在医疗、金融、法律、教育等领域发挥巨大作用。 微调的优势在于节省大量资源和时间。

传统的模型训练往往需要庞大的数据集和强大的计算能力,而微调只需相对较小的标注数据便能取得显著效果。这让许多企业和开发者能够在预算有限的情况下,依然拥有尖端的人工智能解决方案。更重要的是,微调过程还能避免从零训练带来的不确定性和风险,使得模型表现更加稳定和可控。 随着技术的不断演进,微调方法也在不断创新。2025年尤为值得关注的是基于人类反馈的强化学习技术(Reinforcement Learning from Human Feedback,简称RLHF),它为模型调整提供了更自然和精准的路径。RLHF通过引入人类评价机制,使得微调过程能够考虑用户的实际体验和偏好,而不单纯依赖传统的数值损失函数。

这种方法极大地提升了模型生成内容的相关性和质量,尤其是在对话系统和内容生成领域展现出强大的潜力。 不仅如此,随着开源库如Hugging Face的TRL(Transformer Reinforcement Learning)逐渐普及,复杂的微调技术变得更加易于实践和上手。TRL库将强化学习和微调相结合,极大地降低了门槛,推动了更多开发者和企业拥抱先进的AI技术。通过利用这些工具,机器学习工程师能够更快速地设计、训练并部署符合业务需求的智能模型。 微调在应用层面体现出广泛的适用性。无论是智能客服、个性化推荐,还是自动文档分析和内容创作,微调带来的定制化模型都显著提升了用户体验和服务效率。

例如,在金融行业,经过微调的模型可以精准识别欺诈行为,辅助风险控制;在医疗领域,则能辅助诊断和健康管理;在教育领域,则提供个性化学习建议和智能辅导。这些应用证明了微调作为连接通用AI与行业实际需求的桥梁,其战略价值无可替代。 针对机器学习工程师来说,理解和掌握微调技术已成为职业发展的必备技能。未来,无论是初学者还是资深专家,都需要关注微调背后的理论基础和实践技巧,深入了解算法的创新和优化方向。与此同时,数据标注质量的提升、多模态微调(结合文本、图像、音频等多种数据形式),以及自动化微调流程的构建也将成为研究和工程的热点领域。 2025年的机器学习生态系统正向着更加开放、多样和高效的方向发展。

微调技术作为连接预训练模型与具体任务需求的纽带,极大地降低了AI应用的准入门槛,让更多企业和开发者能够真正享受到人工智能带来的变革红利。可预见,未来微调将不仅仅局限于语言模型,还将广泛应用于计算机视觉、语音识别、推荐系统等多个领域,推动人工智能的跨界融合和深度创新。 综上所述,微调技术是2025年机器学习工程师不可忽视的秘密武器。它不仅提升了模型性能,节约了资源,更促进了AI技术与行业需求的深度结合。掌握微调技术,意味着在这个飞速发展的时代里拥抱前沿、掌握未来,也意味着为职业生涯注入强大动力。那些积极拥抱微调创新的工程师和企业,必将在激烈的市场竞争中脱颖而出,赢得更多机遇和成功。

随着技术的持续进步,我们有理由相信,微调将持续定义人工智能的未来面貌,成为推动智能科技迈向新高度的关键力量。